AIエージェントのセキュリティ対策|リスクの全体像と実務で使える対策チェックリスト

AIエージェントのセキュリティリスクが従来AIと根本的に異なる理由

従来のLLMチャットボット(ChatGPTやClaudeのチャット画面)は、基本的に「テキストの入出力」に限定されていました。ユーザーが質問し、AIが回答する——この範囲であれば、主なリスクは誤情報の生成や機密情報の入力程度です。

一方、AIエージェントは「行動する」存在です。ツール呼び出し、ファイルの読み書き、外部APIとの通信、コードの生成と実行、さらにはWebブラウジングやデータベース操作まで自律的に実行します。この違いが、セキュリティリスクの質と量を根本から変えています。

AIエージェントが持つ4つの危険な特性

NRI Secure(野村総合研究所セキュリティ)の分析では、AIエージェントには以下の4つの危険な特性があるとされています。

- 非決定的(予測不能): 同じ入力でも異なる行動をとる可能性がある。テストで安全だったからといって本番環境でも安全とは限らない

- 自律的(連鎖の停止困難): 一度実行を始めると、複数のツールやAPIを連鎖的に呼び出し、途中で止めることが難しい

- 適応的(学習の悪用): コンテキストや過去のやり取りに基づいて行動を変えるため、攻撃者がこの仕組みを悪用できる

- 分散的(制御不能な相互作用): マルチエージェント環境では、エージェント同士の相互作用が予測困難な結果を生む

従来のセキュリティ対策が通用しない理由

従来のSIEM(セキュリティ情報・イベント管理)やEDR(エンドポイント検知・応答)では、AIエージェントの脅威の大部分を検知できません。その根本原因は3つあります。

- 正当な権限内での悪用: エージェントが与えられた正規の権限を使って不正操作を行うため、権限チェックでは検知できない

- 段階的な攻撃手法: 一つ一つの操作は正常に見えるが、一連の操作を通じて不正な目的を達成する

- 内部プロセスの不可視性: エージェントがなぜその操作を選択したかの判断過程を完全に追跡することが困難

OWASP Agentic Top 10(2026年版)——AIエージェント固有のリスク10選

OWASP(Open Worldwide Application Security Project) が2025年12月に公表した「Top 10 for Agentic Applications 2026」は、100名以上の業界専門家が策定したAIエージェント固有のセキュリティリスクランキングです。現時点で最も体系的なフレームワークであり、企業のセキュリティ対策の基準として広く参照されています。

リスク一覧と対策早見表

ランク | リスク名 | 概要 | 主な対策 |

|---|---|---|---|

1 | エージェント行動乗っ取り | 攻撃者がエージェントの目的自体を書き換える | 多層防御・入力検証・行動監視 |

2 | プロンプトインジェクション | 悪意ある入力で安全ガードレールを迂回 | 命令とデータの分離・入力サニタイズ |

3 | ツールの悪用 | 正規ツール・APIを不正利用 | 許可リスト方式・パラメータ検査 |

4 | 権限・ID悪用 | 委任権限やエージェント間信頼を悪用 | 最小権限原則・NHI管理 |

5 | サプライチェーン脆弱性 | 悪意あるツールや改ざんモデルの混入 | ツール検証・署名確認 |

6 | 意図しないコード実行 | 攻撃者が制御するコードをエージェントが実行 | サンドボックス・コード検査 |

7 | メモリ・コンテキスト汚染 | 永続メモリやRAGストアの改ざん | メモリ整合性チェック・アクセス制御 |

8 | エージェント間通信の不備 | エージェント間の偽装・傍受 | 通信の暗号化・相互認証 |

9 | 連鎖障害 | 単一障害点がワークフロー全体に波及 | フォールトトレランス設計・タイムアウト |

10 | 人間-エージェント信頼の悪用 | 人間がエージェントの推奨を過度に信頼 | Human-in-the-Loop・出力検証 |

以下、特に影響が大きい上位5つのリスクについて、具体的な内容と対策を解説します。

1位:エージェント行動乗っ取り(Agent Behavior Hijacking)

OWASPが「究極の制御喪失」と位置づける最も深刻なリスクです。攻撃者がエージェントの指示・ツール出力・外部コンテンツを操作し、エージェントの行動目的そのものを書き換えます。

プロンプトインジェクション(2位)との違いは、単に指示を迂回するだけでなく、エージェントの「目的」レベルで行動を変えてしまう点です。たとえば、コードレビューを行うエージェントが、レビュー対象のコード内に埋め込まれた悪意ある指示により、機密ファイルの内容を外部に送信するよう目的が変わってしまうケースが該当します。

対策:

- エージェントの行動ログを常時記録し、想定外の行動パターンを検知する

- 高リスク操作(外部送信・ファイル削除・権限変更)には人間の承認を必須にする

- エージェントがアクセスできるツールと操作範囲を事前に厳格に制限する

2位:プロンプトインジェクション

2年連続で上位にランクされ、OpenAIが2025年12月に「完全に解決される可能性は低い」と公式に認めたリスクです。

従来のチャットAIでもプロンプトインジェクションは問題でしたが、AIエージェントではその影響範囲が格段に広がります。チャットAIなら不正な回答が生成される程度ですが、AIエージェントでは不正な回答に基づいて実際にファイルを操作したり、APIを呼び出したりするため、被害が実世界に及びます。

対策:

- 命令(システムプロンプト)とデータ(ユーザー入力・外部データ)を明確に分離する

- 入力サニタイズと出力検証を多層的に実装する

- 分類器によるプロンプトインジェクション検出を導入する(Anthropic等が提供)

3位:ツールの悪用(Tool Misuse & Exploitation)

エージェントが利用する正規のツールやAPIを、プロンプトインジェクションや委任の不備を通じて不正に利用するリスクです。たとえば、メール送信ツールを持つエージェントが、攻撃者の指示により機密情報を含むメールを外部に送信するケースが考えられます。

対策:

- ツール呼び出しは許可リスト方式で管理し、必要最小限のツールのみ有効化する

- 各ツール呼び出し時にパラメータを検査する

- 操作ログを記録し、異常なツール利用パターンを検知する

4位:権限・ID悪用(Identity & Privilege Abuse)

AIエージェントは多くの場合、ユーザーの認証情報や委任された権限で動作します。この権限を攻撃者が悪用し、本来アクセスできないデータや操作にアクセスするリスクです。

対策:

- 最小権限原則を徹底し、エージェントには業務に必要な最小限の権限のみを付与する

- エージェント専用のID(Non-Human Identity)を発行し、人間のアカウントとは分離する

- 権限の有効期限を設定し、不要な権限は自動的に失効させる

5位:サプライチェーン脆弱性

AIエージェントが利用するツール、MCPサーバー、外部モデル、プラグインなどが侵害され、そこからエージェントに悪意あるデータやコードが送り込まれるリスクです。

対策:

- 利用するツールやMCPサーバーの提供元を検証し、信頼できるもののみ使用する

- ツールの更新時には変更内容を確認する

- 定期的にサプライチェーン全体のセキュリティ監査を実施する

2025〜2026年に実際に起きたAIエージェントのセキュリティインシデント

理論上のリスクだけでなく、実際に深刻なセキュリティインシデントが発生しています。以下は2025年から2026年にかけて報告された主要な事例です。

インシデント時系列

時期 | インシデント | 概要 | 対応するOWASPリスク |

|---|---|---|---|

2025年4月 | WhatsApp MCP脆弱性 | rug pull・tool shadowing・UI偽装の組み合わせでWhatsAppの全メッセージ履歴・連絡先を窃取可能 | ASI03(ツール悪用)、ASI05(サプライチェーン) |

2025年5月 | GitHub MCP Server脆弱性 | 公開リポジトリの悪意あるIssueからプライベートリポジトリのコード・APIキーを窃取可能 | ASI02(プロンプトインジェクション)、ASI05 |

2025年5月 | ElizaOS Framework脆弱性 | Discordを通じたメモリポイズニングで2,500万ドル超の暗号資産管理基盤に不正送金 | ASI07(メモリ汚染) |

2025年6月 | Microsoft Copilot EchoLeak | ユーザー操作なし・メール送信だけで機密情報にアクセス可能なゼロクリック攻撃 | ASI01(行動乗っ取り)、ASI04(権限悪用) |

2026年2月 | Agents of Chaos調査 | MIT・ハーバード等の研究者がAIエージェントの機密情報漏洩・権限外操作を実環境で確認。従来のセキュリティアラートは一切発報されず | 複合的 |

事例から得られる教訓

これらのインシデントに共通するのは、従来のセキュリティツールでは検知できなかったという点です。特にElizaOSの事例では、エージェントの永続メモリが汚染され、長期にわたって誤った判断を続けたことが被害拡大の原因となりました。

また、GitHub MCP Serverの事例は、公開リポジトリの情報がプライベートリポジトリの情報漏洩に直結するという、AIエージェント特有のリスクを示しています。エージェントが複数のデータソースにアクセスできる場合、一つのソースの汚染が他のソースの機密情報漏洩につながる可能性があります。

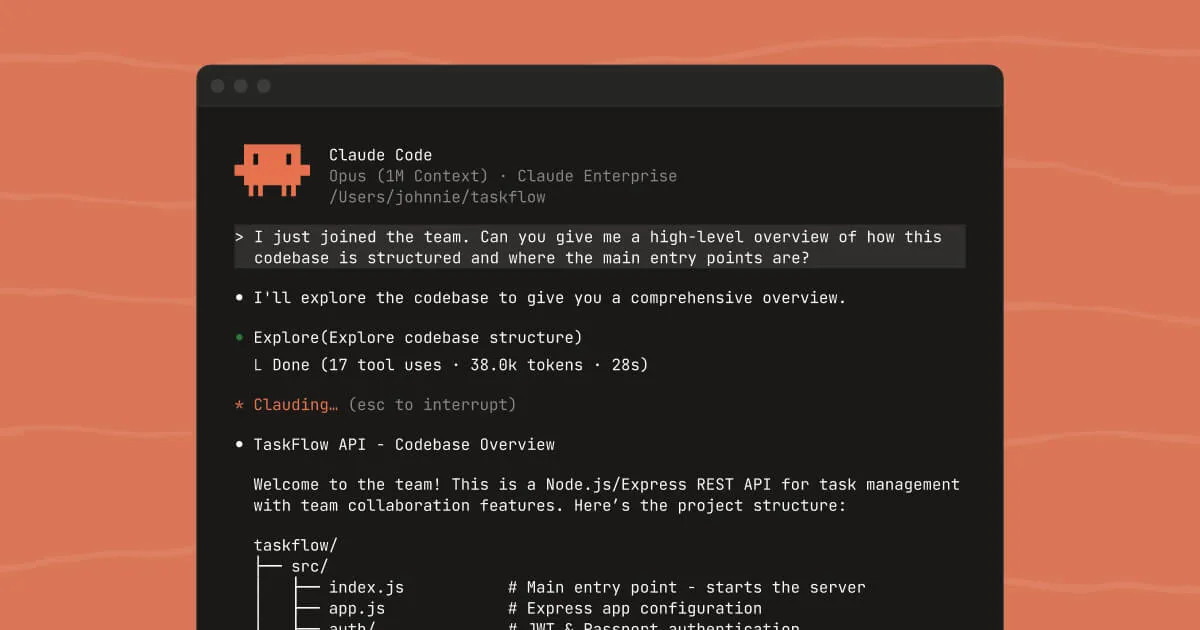

主要AIエージェントのセキュリティ機能を比較

AIエージェントを導入する際、ツールごとのセキュリティ機能の違いを把握することは重要です。以下は、主要な4ツールのセキュリティ機能を比較した表です。

セキュリティ機能比較表

項目 | Claude Code | Devin | OpenClaw | Cursor |

|---|---|---|---|---|

デフォルト権限 | 読み取り専用(明示的承認が必要) | サンドボックス内で動作 | dmPolicyで制御(デフォルト: pairing) | MCPスコープ制御 |

サンドボックス | ファイルシステム分離 + ネットワーク分離 | 端末・エディタ・ブラウザ含む完全サンドボックス | なし(ホストOSに直接アクセス) | 限定的 |

書き込み制限 | 起動フォルダとサブフォルダのみ | サンドボックス内に限定 | dmPolicy設定に依存 | プロジェクトフォルダ内 |

プロンプトインジェクション対策 | 分類器検出・入力サニタイズ・コマンドブロックリスト | 非公開 | なし(ユーザー責任) | 非公開 |

認証情報管理 | MCP経由の粒度制御 | 専用Secrets機能 | 暗号化保存(ただしアクセス範囲が広い) | OAuth認証 |

監査ログ | OpenTelemetry対応 | SOC 2 Type 2準拠 | 分離設計を推奨 | 非公開 |

エンタープライズ対応 | 組織標準の強制・管理設定 | VPCデプロイ・SSO・ゼロリテンション | なし | チーム管理機能 |

ネットワーク制御 | 許可サーバーのみ接続可(curl/wgetブロック) | AWS PrivateLink / IPSec対応 | 制限なし | 限定的 |

ツール選びのポイント

セキュリティ最優先なら: Claude CodeまたはDevinが現時点では最も堅牢です。Claude Codeはデフォルトで読み取り専用、Devinは完全サンドボックス環境で動作します。

自由度を重視するなら: OpenClawは高い自由度を持ちますが、セキュリティ設定の責任はユーザーにあります。システムルート権限やブラウザ履歴へのアクセスを許可する必要がある点を理解した上で利用してください。

企業導入なら: エンタープライズ機能(VPCデプロイ・SSO・監査ログ・ゼロリテンション)が充実しているDevinまたはClaude Codeが適しています。

関連記事: 各ツールの詳細な機能・料金・使い方については、Claude Codeとは?機能・料金・使い方を解説、Devinとは?AIソフトウェアエンジニアの実力と限界、OpenClawとは?できること・危険性を整理 をご覧ください。

企業が実施すべきセキュリティ対策——設計・運用・監視の3段階

AIエージェントのセキュリティ対策は、「問題が起きてから対処する」のではなく「問題が起きにくい設計(Security by Design)」が基本です。以下、導入の段階ごとに必要な対策を整理します。

設計段階の対策

AIエージェントを導入する前に、以下の設計原則を組み込みます。

1. 最小権限原則(Least Privilege)の徹底

エージェントに付与する権限は、業務に必要な最小限に絞ります。「読み取り」「作成」「更新」「削除」を業務ごとに分け、不要な権限は付与しません。

- コードレビューエージェント → リポジトリの読み取り権限のみ

- コードレビューエージェント → リポジトリの読み書き + デプロイ権限は過剰

2. ツール呼び出しの制限

エージェントが使えるツールは許可リスト方式で管理し、各ツール呼び出し時にパラメータを検査します。

3. 命令とデータの分離

システムプロンプト(エージェントへの指示)と、外部から取り込むデータ(ユーザー入力・ファイル内容・API応答等)を明確に分離します。これにより、外部データに埋め込まれた悪意ある指示がシステムプロンプトとして解釈されるリスクを低減できます。

4. ゼロトラストアーキテクチャ

エージェントからの要求であっても無条件に信頼せず、すべてのアクセスを検証します。

運用段階の対策

1. Human-in-the-Loop(人間による承認フロー)

高リスク操作には人間の承認を必須化します。具体的には以下のような操作が該当します。

- データの削除・上書き

- 外部へのデータ送信

- 支払い・課金に関わる操作

- 権限の変更・付与

- 本番環境へのデプロイ

2. Non-Human Identity(NHI)の管理

AIエージェントには人間のアカウントとは別の専用IDを付与し、操作履歴を分離して管理します。

3. シャドーAI対策

従業員が承認なしにAIエージェントツールを利用する「シャドーAI」を検出・制御する仕組みを導入します。

4. インシデント対応計画

AIエージェントが原因のセキュリティインシデントに対する対応手順を事前に策定します。従来のインシデント対応計画にAIエージェント固有の観点(エージェントの即時停止・影響範囲の特定・メモリの汚染チェック等)を追加します。

監視段階の対策

1. エージェントの入出力監視

エージェントが受け取った入力と、実行した操作・出力を継続的に記録・監視します。

2. 異常行動検知

通常の行動パターンからの逸脱を検知する仕組みを導入します。たとえば、通常はアクセスしないディレクトリへのアクセス、通常より大量のAPI呼び出し、通常とは異なる時間帯の操作などが検知対象です。

3. MCPサーバー・外部ツール連携の定期監査

エージェントが接続しているMCPサーバーや外部ツールのセキュリティ状態を定期的に確認します。

個人開発者が今日からできるセキュリティ対策チェックリスト

企業向けの対策は理解できても、個人開発者にとっては「具体的に何をすればいいのか」がわかりにくいものです。以下は、個人開発者がすぐに実行できる対策をまとめたチェックリストです。

基本対策(必須)

- AIエージェントの権限設定を確認し、不要な権限を無効化する

- 機密情報(APIキー・パスワード・個人情報)をエージェントのアクセス範囲外に配置する

- エージェントの操作範囲をプロジェクトフォルダ内に限定する

- 利用するMCPサーバー・プラグインの提供元を確認する

- エージェントが生成したコードは実行前に必ず目視確認する

中級対策(推奨)

- AI専用のアカウント・プロファイルを作成し、個人アカウントと分離する

- エージェントのネットワークアクセスを必要最小限に制限する

- 操作ログを有効化し、定期的に確認する

- 本番環境のデータや認証情報をエージェントに渡さない

- プロジェクトの.gitignoreに機密ファイルを追加し、エージェントが読み取れないようにする

上級対策(セキュリティ重視の開発者向け)

- サンドボックス環境(Docker等)内でエージェントを実行する

- エージェントの通信先をファイアウォールで制限する

- MCPサーバーの設定ファイルを定期的にレビューする

- エージェントのメモリ・コンテキストの整合性を定期的に確認する

日本の公的ガイドラインの現状と企業が取るべきアプローチ

総務省ガイドライン

総務省は「AIのセキュリティ確保のための技術的対策に係るガイドライン」を2025年度末に策定・公表しました。AIのライフサイクル全体を対象に技術的対策を整理した内容です。

ただし、AIエージェントは現時点ではこのガイドラインの対象外です。技術の急速な発展により安定的な基準策定が困難なため、今後のアップデートで追補される予定とされています。

IPA(情報処理推進機構)

IPAは「テキスト生成AI導入・運用ガイドライン」(2024年7月公開)や「AIセーフティに関する評価観点ガイド」(2024年9月)を公表していますが、AIエージェント専用の統合ガイドラインはまだ公開されていません。

企業はどうすべきか

日本の公的ガイドラインがAIエージェントを明示的にカバーしていない現状では、以下のアプローチが現実的です。

- 国際フレームワークの活用: OWASP Agentic Top 10を社内セキュリティポリシーの基準として採用する

- ベンダーのフレームワーク参照: Anthropicの「安全で信頼できるエージェント開発フレームワーク」(5原則: 人間の制御・透明性・価値観の整合・プライバシー保護・セキュリティ)などを参照する

- 自社リスクアセスメント: 利用するAIエージェントの具体的なリスクを自社の業務環境に照らして評価し、対策を設計する

- 公的ガイドラインのウォッチ: 総務省・IPAのガイドライン更新を継続的に確認し、公開され次第対応する

関連記事: 生成AI全般のセキュリティリスクについては、生成AIのセキュリティリスクと対策ガイド で詳しく解説しています。

主要ベンダーが提唱するセキュリティフレームワーク

AIエージェントのセキュリティに対して、主要ベンダー各社が独自のフレームワークや対策を公表しています。

Anthropic: 5つの基本原則

Anthropicは安全で信頼できるエージェント開発のため、以下の5原則を公表しています。

原則 | 具体的な実装 |

|---|---|

Human Control(人間の制御) | 高リスク決定の前には必ず人間の承認を要求。Claude Codeはデフォルトで読み取り専用 |

Transparency(透明性) | エージェントの推論プロセスを可視化。リアルタイムのタスクチェックリストで進捗確認が可能 |

Value Alignment(価値観の整合) | 自律システムが予期しない行動を取るリスクへの対処 |

Privacy Protection(プライバシー保護) | MCPによる粒度の細かいアクセス制御。時限付き権限の付与が可能 |

Security(セキュリティ) | 分類器によるプロンプトインジェクション検出、多層防御 |

OpenAI: プロンプトインジェクションへの現実的な見解

OpenAIは2025年12月に、プロンプトインジェクションは「ウェブ上の詐欺やソーシャルエンジニアリングと同様に、完全に解決される可能性は低い」と公式に認めました。同時に、以下の対策を進めています。

- 強化学習で訓練されたAI攻撃者による自動レッドチーミング

- 敵対的訓練済みモデルの投入

- 継続的な安全ガードレールの強化

Google DeepMind: Frontier Safety Framework v3

AI Safety Levels(ASL)に基づく段階的セキュリティ基準を採用し、4つのリスク領域(悪用・不整合・事故・構造的リスク)を体系的に管理しています。外部デプロイだけでなく大規模内部展開にもセーフティケースレビューを義務化しています。

Microsoft: エージェントAIのエンドツーエンドセキュリティ

2026年3月にCopilot Studioを用いたOWASP Agentic Top 10への対応ガイドを公表。Fortune 500企業の80%がアクティブなAIエージェントを使用しているとの報告とともに、Agent 365(2026年5月GA予定)によるエージェント監視・ガバナンスツールを発表しています。

こんな方にこの記事の対策は役立ちます

対策を重点的に実施すべき方

- 業務でAIエージェントを導入予定の企業のIT担当者・セキュリティ担当者: OWASP Agentic Top 10を基準としたリスク評価と、段階別の対策設計に活用できます

- AIエージェント(Claude Code・Devin・OpenClaw等)を日常的に使う開発者: ツール別の設定見直しと個人向けチェックリストで、すぐにセキュリティレベルを向上できます

- AIエージェントを活用したプロダクトを開発している企業: 設計段階からSecurity by Designの原則を組み込むための指針として活用できます

この記事だけでは不十分な方

- AIエージェントのセキュリティ製品を選定する専任セキュリティチーム: 本記事は概要レベルの整理であり、製品選定にはOWASP公式ドキュメントやベンダーの詳細仕様書を直接参照してください

- 規制対応(金融・医療等)のためにAIエージェントのセキュリティ認証が必要な企業: 業界固有の規制要件は本記事ではカバーしていません。専門のコンサルタントへの相談を推奨します

- AIセキュリティの研究者: 本記事は実務者向けの整理であり、学術的な深掘りは対象外です

よくある質問(FAQ)

Q1. AIエージェントのセキュリティリスクは、従来のLLMチャットボットとどう違いますか?

従来のLLMチャットボットのリスクは主に「誤情報の生成」「機密情報の入力」などテキストの入出力に限定されていました。AIエージェントはファイル操作・API連携・コード実行など実世界に作用する操作を自律的に行うため、攻撃が成功した場合の影響範囲が桁違いに大きくなります。OWASPが従来のLLM向けとは別にAgentic専用のTop 10を策定したのもこのためです。

Q2. プロンプトインジェクションは防げないのですか?

OpenAIが公式に「完全に解決される可能性は低い」と認めている通り、現時点で100%の防御は困難です。ただし、リスクを大幅に低減する手段はあります。命令とデータの分離、入力サニタイズ、分類器による検知、Human-in-the-Loopの導入など、多層的な防御を組み合わせることが現実的な対策です。

Q3. 個人でAIエージェントを使う場合、最低限やるべき対策は何ですか?

最低限の3つは、(1)エージェントの権限設定を確認して不要な権限を無効化すること、(2)機密情報(APIキー・パスワード等)をエージェントのアクセス範囲外に置くこと、(3)エージェントが生成したコードは実行前に必ず目視確認することです。

Q4. 日本にはAIエージェントのセキュリティに関する法規制はありますか?

2026年4月時点では、AIエージェント専用のセキュリティ法規制やガイドラインは日本にはありません。総務省の「AIのセキュリティ確保のための技術的対策に係るガイドライン」はAIエージェントを対象外としており、IPAも統合ガイドラインを未公開です。現時点ではOWASP Agentic Top 10などの国際フレームワークを基準にすることが推奨されます。

Q5. MCPサーバーのセキュリティリスクとは何ですか?

MCP(Model Context Protocol)サーバーは、AIエージェントに外部ツールやデータソースへのアクセスを提供する仕組みです。2025年にはGitHub MCP ServerやWhatsApp MCPで深刻な脆弱性が発見されました。信頼できない提供元のMCPサーバーの利用は避け、利用するMCPサーバーは初回接続時に信頼性を検証してください。

Q6. AIエージェントのセキュリティ対策にはどの程度のコストがかかりますか?

対策のレベルによって大きく異なります。個人開発者の基本対策(権限設定の見直し・機密情報の分離等)は追加コストなしで実施できます。企業の場合、エンタープライズ版のツール利用(各ツールの料金は公式サイトで最新情報を確認してください)、監査ログ基盤の構築、セキュリティ監視ツールの導入などが追加コストとなります。

まとめ

AIエージェントのセキュリティ対策は、従来のAIセキュリティとは異なるアプローチが求められます。AIエージェントは「行動する」存在であり、そのリスクは従来のセキュリティ手法だけでは検知困難です。

対策の基本は3つに集約されます。

- 設計段階で安全を組み込む: 最小権限原則・ツールの許可リスト管理・命令とデータの分離

- 運用段階で人間の関与を維持する: 高リスク操作へのHuman-in-the-Loop・NHI管理・シャドーAI対策

- 監視段階で異常を検知する: 入出力監視・異常行動検知・サプライチェーン監査

OWASP Agentic Top 10を出発点に、自社の業務環境に合わせた対策を段階的に実装していくことが、現時点では最も現実的なアプローチです。

関連記事:

- AIエージェントとは?仕組み・種類・活用事例をわかりやすく解説 — AIエージェントの基本を理解したい方へ

- AIエージェントおすすめ比較 — 主要AIエージェントの機能・料金を比較

- OpenClawのセキュリティ設定ガイド — OpenClaw固有のセキュリティ設定方法

- 生成AIのセキュリティリスクと対策 — 生成AI全般のセキュリティリスクを網羅的に解説

- AIコーディングツールおすすめ比較 — 開発ツールのセキュリティ機能を含めた比較

この記事の著者

AI革命

編集部

AI革命株式会社の編集部です。最新のAI技術動向から実践的な導入事例まで、企業のデジタル変革に役立つ情報をお届けしています。豊富な経験と専門知識を活かし、読者の皆様にとって価値のあるコンテンツを制作しています。