Arcee AI Trinity Large とは?400B Apache 2.0 OSSフロンティアモデルの性能・料金・使い方を徹底解説

この記事のポイント

Arcee AIが開発した400B(4,000億)パラメータのオープンソースAIモデル「Trinity Large」を解説。Claude Opus比96%安価な$0.90/M、Apache 2.0ライセンスで商用・セルフホスティング完全自由、エージェント特化の推論機能まで導入判断に必要な情報を網羅。

Arcee AI Trinity Largeは、米スタートアップArcee AIが2026年1月にリリースした約400B(4,000億)パラメータのスパースMoEオープンソースAIモデルです。Apache 2.0ライセンスで商用利用・改変・セルフホスティングが完全に自由で、最新版「Trinity-Large-Thinking」の出力トークン単価は$0.90/M——Claude Opus 4.6($25/M)比で約96%安価に相当します。

モデルの仕組み・ベンチマーク性能・料金・API利用方法・競合モデルとの比較まで、開発者・AIコスト削減担当・セルフホスティング検討中のエンジニアが導入を判断するのに必要な情報を網羅しています。

出典: Arcee AI 公式ブログ

Arcee AI Trinity Large とは

Arcee AI Trinity Largeは、Apache 2.0ライセンスで公開された約400Bパラメータのスパースなオープンソース大規模言語モデル(LLM)です。開発元は2023年設立・サンフランシスコ拠点の米国スタートアップArcee AI(従業員数30〜39人規模)。CEOはMark McQuadeで、Series A(2025年7月、$24M)にはMicrosoft VenturesのM12、Hitachi Ventures、Samsung Nextらが参画しています。

Trinity Largeは「30人規模のスタートアップがMetaのLlamaを上回る400BオープンソースLLMを構築した」(TechCrunch、2026年1月)と報道され、DeepSeekなど中国製モデルの台頭に対する米国製OSSフロンティアモデルとして注目を集めました。

なぜ「フロンティア」なのか

現時点(2026年4月)で公開されているオープンソースLLMとしては最大級のパラメータ数を持ち、かつ下記の条件を同時に満たすモデルは珍しい組み合わせです。

- Apache 2.0ライセンス(MetaのLlamaライセンスとは異なり、ユーザー数制限・派生物制限なし)

- 米国製(政府・防衛・規制業界で中国製モデルが制限される環境に対応可能)

- エージェント特化(マルチターンツール使用・長期エージェントループへの最適化)

- 商用コスト(OpenRouter経由で$0.22/$0.85 入力/出力 per 1M token)

Arcee AIはこの1モデルの開発に総調達額の約半分(約$20M)を投入しており、訓練はPrime Intellectが提供するNVIDIA B300 Blackwell GPU 2,048基で実施されました。

モデルラインナップ:Nano / Mini / Large と4つのバリアント

Trinityシリーズはエッジ・クラウド・フロンティアの3層をカバーする3モデル構成です。

モデル名 | 総パラメータ | 活性パラメータ/token | 学習トークン | 用途 |

|---|---|---|---|---|

Trinity Nano | 6B | 1B | 10T | エッジデバイス・組み込み |

Trinity Mini | 26B | 3B | 10T | クラウド・オンプレ本番環境 |

Trinity Large | 約400B | 13B | 17T | クラウド展開・複雑なワークフロー |

Trinity Largeには4つのバリアントが存在します。

バリアント | リリース日 | 特徴 |

|---|---|---|

Trinity-Large-Preview | 2026年1月27日 | 軽量ポストトレーニング済み・チャット対応 |

Trinity-Large-Base | 2026年1月27日 | 完全事前学習チェックポイント(カスタム基盤として利用) |

TrueBase | 2026年1月27日 | 10Tトークン時点の純粋ベース(ファインチューニング実験向け) |

Trinity-Large-Thinking | 2026年4月1日 | 推論最適化版・エージェント/ツール使用特化(最新・推奨) |

現時点でエージェントタスクや本番API利用を想定するならTrinity-Large-Thinkingが基本的な選択です。Preview/Baseは研究・ファインチューニング用途向けと捉えてください。

なぜ400Bなのに速いのか:スパースMoEの仕組み

400Bパラメータという数字だけ見ると「膨大な計算コストがかかるのでは」と思いがちですが、Trinity LargeはスパースMoE(Mixture of Experts)アーキテクチャを採用しているため、実際の推論で使うパラメータは約13B(アクティブパラメータ率1.56%)に過ぎません。

MoEを直感的に理解する

256人の専門家が在籍する会社をイメージしてください。すべての専門家が毎回全員で会議するのではなく、各タスクに最適な4人だけが参加します。会社全体の知識量は膨大でも、毎回動員するリソースは最小限——これがMoEの本質です。Trinity Largeは「4-of-256ルーティング」で、トークンごとに256のエキスパートモジュールから4つだけを活性化します。

この設計により以下が実現します。

- 推論速度:同等サイズの密集モデル比で約2〜3倍高速

- コンテキストウィンドウ:ネイティブ512K、API提供版128K〜262K

- 計算効率:フルパラメータを動かさないためGPUメモリ消費が大幅に削減

Trinity Large固有の技術的革新

- SMEBU(Soft-clamped Momentum Expert Bias Updates):独自の負荷分散戦略で特定エキスパートへの過集中を防ぐ

- ハイブリッド・アテンション機構:ローカル+グローバルのアテンションを組み合わせ

- Muonオルゴリズム採用:17Tトークン学習中にロス・スパイクゼロを達成

- 深度スケール・サンドイッチ・ノルム+シグモイド・ルーティング:学習安定性の向上

出典: Arcee AI 公式ブログ

ベンチマーク性能:得意なこととそうでないこと

Trinity-Large-Thinkingの主要スコア

ベンチマーク | Trinity-Large-Thinking | Claude Opus 4.6 | 評価 |

|---|---|---|---|

PinchBench(エージェント) | 91.9 | 93.3 | ◎ 僅差・高水準 |

τ²-bench Airline | 88.0 | — | ◎ 実用レベル |

τ²-bench Telecom | 94.7 | — | ◎ 実用レベル |

AIME 2025(数学) | 96.3 | — | ◎ 数学強い |

MMLU-Pro(一般知識) | 83.4 | 89.1 | △ やや劣る |

SWE-bench Verified(コーディング) | 63.2 | 75.6 | △ 弱い |

GPQA-Diamond(科学推論) | 76.3 | 89.2 | △ 大きく劣る |

IFBench(命令遵守) | 52.3 | 53.1 | △ 僅差でやや劣る |

※ ベンチマークスコアはArcee AI自社測定。2026年4月時点で第三者独立検証は限定的。

得意な領域はエージェントワークフロー(マルチターンツール使用・長期計画)と数学推論です。PinchBenchとτ²-benchは実際のエージェントタスクを模したベンチマークで、Claude Opus 4.6に匹敵するスコアを出しています。

苦手な領域はコーディング(SWE-bench 63.2 vs 75.6)と科学推論(GPQA 76.3 vs 89.2)。専門的なコード生成・デバッグやPhD水準の科学問題では、Claude Opus 4.6に明確に劣ります。

出典: Arcee AI 公式ブログ

料金体系:$0.90/M、96%安価という数値の根拠

「96%安価」の計算式

Claude Opus 4.6の出力トークン料金は$25.00/Mです。Trinity-Large-Thinkingの出力料金は$0.90/M(公式ブログ記載)。

($25.00 - $0.90) / $25.00 ≒ 96.4%「28倍安価」という表現も同じ数値から来ています($25 / $0.90 ≒ 27.8倍)。

プラットフォーム別料金(2026年4月時点)

プラットフォーム | 入力 (per 1M token) | 出力 (per 1M token) | 備考 |

|---|---|---|---|

OpenRouter | $0.22 | $0.85 | 商用利用可・即時利用可能 |

Arcee 公式 API | — | $0.90 | 公式ブログ記載値、入力料金は要確認 |

Trinity-Large-Preview(OpenRouter) | 無料 | 無料 | プレビュー期間中 |

Trinity Mini(参考) | $0.045/M | $0.15/M | より小型・低コスト |

Claude Opus 4.6(比較参考) | $15.00/M | $25.00/M | クローズドモデル |

※ Arcee公式APIの入力トークン料金は2026年4月時点で公式ドキュメントに詳細記載なし。最新料金はArcee AI公式ドキュメントを確認してください。

Trinity Builders Program(無料クレジット)

開発者・研究者・OSSビルダー向けに無料APIクレジットを付与する制度。

- 申請ベース(審査あり)、承認後90日間有効

- 付与枠:50M〜1B以上のトークンから選択可能

- 申請ページから応募

PoC段階のコスト評価や研究目的での評価に向いています。

使い方:API・Hugging Face・セルフホスティング

1. OpenRouter経由(最もシンプル)

OpenRouterはTrinity-Large-Thinkingに対応しており、OpenAI互換APIとして利用できます。既存のChatGPT・Claude向けコードのエンドポイントを変更するだけで移行できます。

from openai import OpenAI

client = OpenAI(

base_url="https://openrouter.ai/api/v1",

api_key="YOUR_OPENROUTER_API_KEY",

)

response = client.chat.completions.create(

model="arcee-ai/trinity-large-thinking",

messages=[

{"role": "user", "content": "エージェントタスクの計画を立ててください"}

]

)

print(response.choices[0].message.content)2. Arcee公式APIの利用

docs.arcee.aiにOpenAI互換APIのエンドポイント情報があります。アカウント登録後、APIキーを発行して利用します。

3. Hugging Face(オープンウェイト)

- Trinity-Large-Preview: huggingface.co/arcee-ai/Trinity-Large-Preview

- Trinity-Large-Base: Hugging Face上で公開

- Trinity-Large-Thinking: Hugging Face上で公開

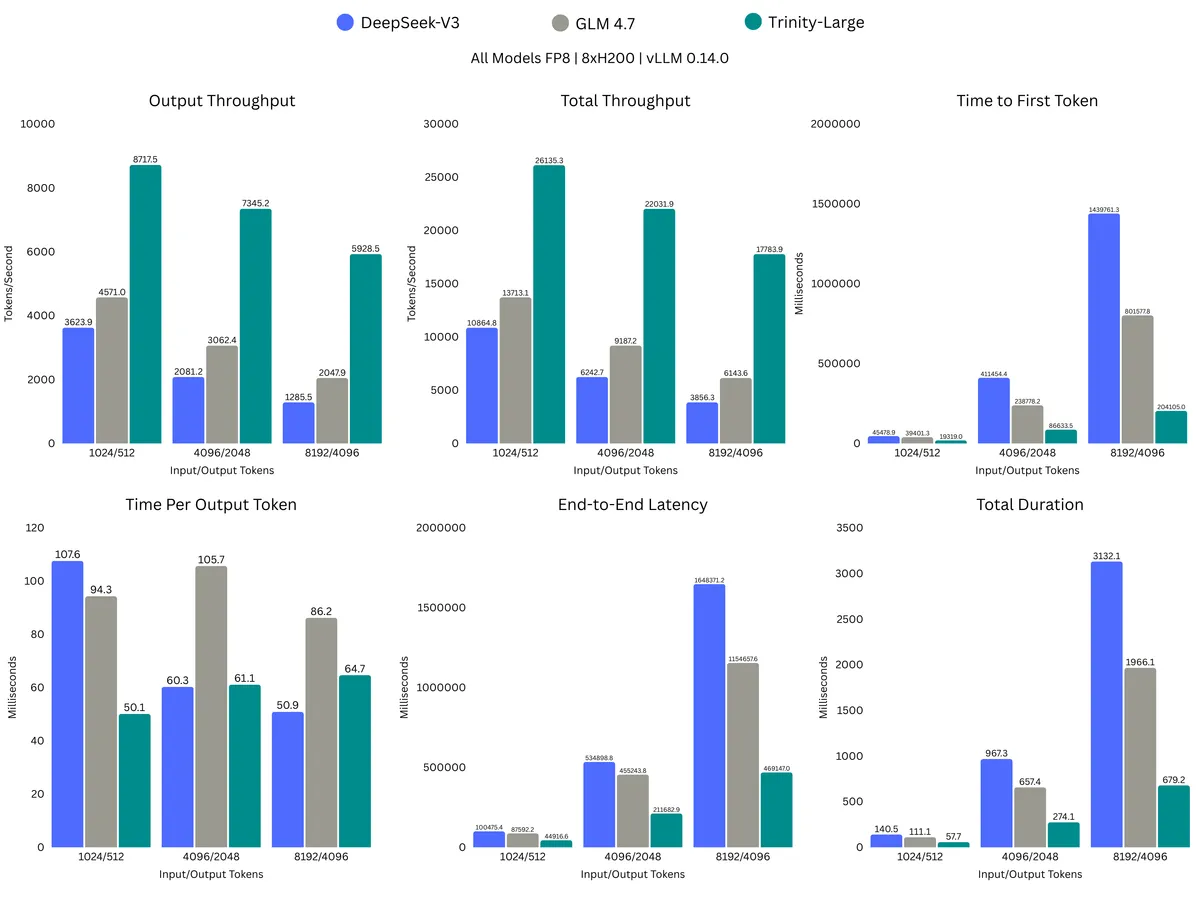

vLLMを使う場合はv0.11.1以降を使用することが公式推奨です。

4. セルフホスティングの現実的なハードウェア要件

量子化方式 | 必要RAMの目安 | 推奨GPU構成 |

|---|---|---|

FP8(フル精度) | 約400GB以上 | 8×H100 80GB または 8×B200 |

4bit量子化 | 224〜336GB | 4×H100 80GB以上 |

8bit量子化 | 約400GB | 8×A100 80GB |

個人・中小規模のオンプレミス環境での運用は現実的ではありません。クラウドGPUインスタンス(AWS p4d, p5, または Lambdaなど)のレンタルか、API経由の利用が実用的です。セルフホスティングが本当に必要なのは、データ主権上の厳格な要件(金融・医療・防衛等)がある組織に限られます。

セルフホスティング時の設定注意点

- 推奨温度パラメータ:

temperature=0.3 - マルチターン会話では、アシスタントの応答全体(

<think>...</think>ブロック含む)を会話履歴に含める - エージェントループでは各ステップ間で思考トークンを保持することが必須

Apache 2.0ライセンスが意味すること

OSSモデルのライセンスは「開発者向けの話」に見えますが、企業のAI導入判断において重要な差が出るポイントです。

主要OSSライセンスの比較

ライセンス | 商用利用 | 改変 | 再配布 | 競合製品開発 | 派生物への制限 |

|---|---|---|---|---|---|

Apache 2.0(Trinity) | ✅ 無制限 | ✅ 自由 | ✅ 自由 | ✅ 可 | なし |

Meta Llama(独自) | △ ユーザー数制限あり | △ 制限あり | △ 制限あり | 要確認 | 派生物にLlamaライセンス適用 |

MIT(DeepSeek等) | ✅ 無制限 | ✅ 自由 | ✅ 自由 | ✅ 可 | なし |

クローズド(Claude等) | ✅(利用規約範囲内) | ❌ | ❌ | ❌ | — |

Apache 2.0のポイントは特許権の明示的許諾が含まれる点です。MIT同様に商用・改変・再配布が自由ですが、Apache 2.0は貢献者の特許についても利用者に許諾を与えるため、エンタープライズの法務部門が対応しやすいライセンスとされています。

MetaのLlamaライセンスは月間アクティブユーザーが7億人を超える場合に使用許諾が必要になる等の制限があります。Trinity LargeのApache 2.0はそういった制限が一切ありません。

また、Arcee AIは著作権保護材料をトレーニングデータから意図的に排除しているため、知的財産リスクの観点でもエンタープライズが導入しやすい設計です。

主要モデルとの比較

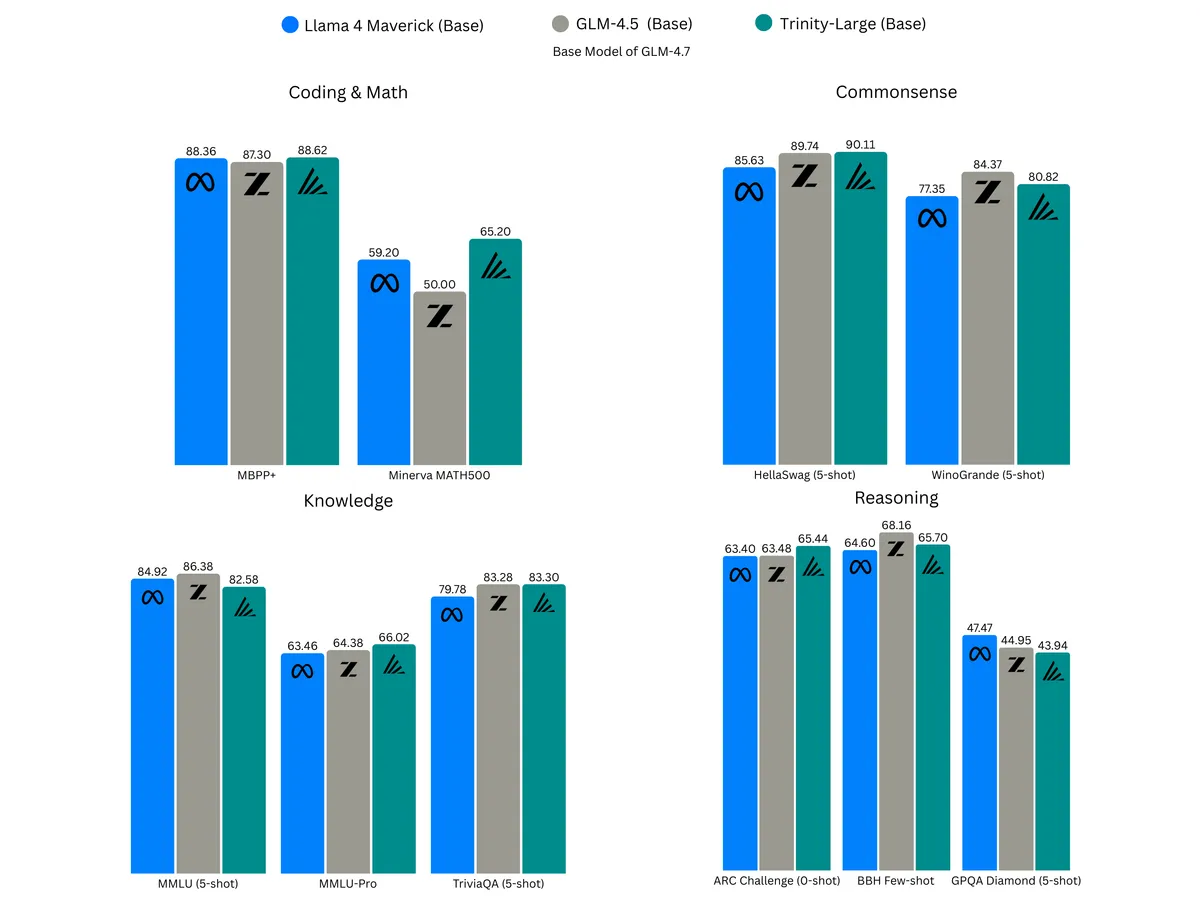

出典: Arcee AI 公式ブログ

項目 | Trinity-Large-Thinking | DeepSeek R1 | Llama 4 Maverick | Claude Opus 4.6 |

|---|---|---|---|---|

総パラメータ | 約400B(13B active) | 671B(37B active) | 400B | 非公開 |

ライセンス | Apache 2.0 | MIT | Meta独自(制限あり) | クローズド |

出力料金/1M | $0.85〜0.90 | 低価格 | 低価格 | $25.00 |

製造国 | 米国 | 中国 | 米国 | 米国 |

マルチモーダル | ❌(開発中) | ❌ | ✅ | ✅ |

エージェント特化 | ✅ | △ | △ | ✅ |

自社ホスティング | ✅(制限なし) | ✅ | △(制限あり) | ❌ |

PinchBench | 91.9 | — | — | 93.3 |

SWE-bench | 63.2 | — | — | 75.6 |

AIME 2025 | 96.3 | — | — | — |

各モデルの向き不向きを一言で整理

Trinity-Large vs DeepSeek R1:ライセンス・国籍を重視するならTrinity Large。MITライセンスで中国製が許容できるなら価格・性能でDeepSeek R1も候補。ただし地政学リスク(制裁・調達規制)を考慮する組織にはTrinity Largeが適切。

Trinity-Large vs Llama 4 Maverick:マルチモーダルが不要でエージェント特化なら Trinity Large。Apache 2.0の完全自由ライセンスが必要ならTrinity Large一択。画像・音声入力が必要ならLlama 4 Maverick。

Trinity-Large vs Claude Opus 4.6:コストが最優先かつエージェントタスク中心なら Trinity Large。コーディング・科学推論の精度や命令遵守の安定性を優先するなら Claude Opus 4.6。APIの安定性・サポートを重視するなら Claude Opus 4.6。

できないこと・制限・注意点

現時点の制約

制約 | 詳細 |

|---|---|

マルチモーダル非対応 | テキストのみ。ビジョン機能は開発中、音声はロードマップ段階 |

セルフホスティングの高いハードル | 4bit量子化でも224〜336GB RAM必要。個人・SMBには非現実的 |

コーディング精度の劣位 | SWE-bench 63.2 vs Claude Opus 4.6の75.6。本格的なコードエージェントには向かない |

科学推論の劣位 | GPQA-Diamond 76.3 vs 89.2。専門的な科学・工学計算は苦手 |

日本語性能は未評価 | 公式に日本語特化ベンチマーク未公開。日本語品質の客観的評価が困難 |

第三者検証が限定的 | ベンチマークスコアはArcee AI自社測定。独立検証はまだ少ない |

小規模チームのサポート | 約30人規模のため、ドキュメント・サポートが限定的 |

ポストトレーニングが浅め | GPUクラスター計算時間の制約から計画より短縮されたと公式が認めている |

企業導入時の注意点

ベンチマークの自社測定問題:スコアはArcee AI自身が測定したものが多く、独立した第三者による再現検証はまだ限定的(2026年4月時点)。PoC段階で自社ユースケースによる実測を行うことを強く推奨します。

合成データの影響:訓練データの8兆トークン以上が合成データ。特定ドメインで精度にばらつきが生じる可能性があります。

APIの安定性:2026年1月リリースと比較的新しいモデルで、本番APIの安定性・アップタイムは長期実績がありません。ミッションクリティカルな用途ではフォールバック設計を検討してください。

こんな人に向いている

以下に当てはまる場合、Trinity-Large-Thinkingは有力な選択肢になります。

コスト削減を最優先にしたい企業

Claude OpusやGPT-4系のAPIコストが課題で、エージェントタスク中心のワークフローを持つ場合。月間トークン消費量が多いほど96%のコスト差は決定的です。

データ主権・セルフホスティングが必要な組織

金融・医療・公共・防衛など、データをクラウドベンダーに送れないコンプライアンス要件がある場合。Apache 2.0ライセンスにより自社サーバー内での完全クローズド運用が可能です。

米国製OSSモデルが必要な組織

中国製モデル(DeepSeek等)の調達が難しい環境(政府系・防衛サプライチェーン)で、かつオープンソースを必要とするケース。現時点で「米国製・Apache 2.0・400B以上」を満たすモデルはTrinity Largeのみです。

エージェントAIのカスタム基盤を構築したい開発者

Apache 2.0ライセンスによりベースモデル・TrueBaseを使ったフルファインチューニングが制限なく可能。自社ドメイン特化モデルの開発起点として有力です。

OpenRouter/APIでコスト評価をしたい開発者

Trinity-Large-Previewは現在OpenRouterで無料提供中。リスクゼロで本番前の性能評価が可能です。

こんな人には向いていない

以下の用途・条件には現時点で他のモデルの方が適しています。

本格的なコードエージェントが必要な場合

SWE-bench 63.2は実用水準ですが、Claude Opus 4.6(75.6)やGitHub Copilotに比べてコーディング精度は明確に劣ります。コード生成・デバッグ・リファクタリングが主用途ならClaude CodeとはやGitHub Copilotとはを参照してください。

画像・音声入力が必要な場合

マルチモーダル機能はロードマップ段階で、現時点ではテキスト専用です。

日本語での安定した精度が必須の場合

公式に日本語ベンチマークが存在せず、品質を客観的に評価できません。日本語のビジネス文書作成・要約・翻訳が中心なら、日本語チューニング実績のあるモデルを選ぶ方が安全です。

個人または小規模チームでのセルフホスティングを想定している場合

4bit量子化でも224〜336GB RAMが必要であり、一般的なオンプレ環境やクラウド個人プランでは動作しません。APIを使わずローカル実行したい場合はTrinity Mini(26B)や他の小型モデルを検討してください。

長期的な信頼性・サポートを重視する場合

30人規模のスタートアップであり、Anthropic・OpenAI・Googleに比べてサポート体制・長期的なモデル提供の安定性は劣ります。エンタープライズ本番採用では継続性リスクを評価してください。

よくある質問

Q. Trinity-Large-ThinkingとTrinity-Large-Previewの違いは?

Trinity-Large-Thinkingは2026年4月1日にリリースされた最新版で、強化学習(エージェンティックRL)で推論能力を強化し、ツール呼び出し・マルチターンエージェントタスクに特化しています。Trinity-Large-Previewは2026年1月の初期リリース版で、基本的なチャット対応の軽量ポストトレーニングモデルです。本番API利用ならThinkingを選んでください。

Q. 日本語での品質はどの程度ですか?

公式に日本語特化ベンチマークは公開されていません。英語中心の訓練データで作られており、日本語品質は自社ユースケースで実測するしかない状況です(2026年4月時点)。

Q. OpenClawやHermes Agentと連携できますか?

公式ドキュメントによれば、Trinity-Large-ThinkingはHermesツール形式と連携可能で、OpenClawなどのエージェントフレームワークとの互換性があります。OpenAI互換APIのため、OpenClaw等からの移行も比較的容易です。

Q. Arcee AIは継続して開発されるのか?

MicrosoftのM12、Hitachi Ventures、Samsung Nextなどが参画するSeries Aを2025年7月に$24M調達しています。ロードマップにはビジョンモデル開発・Trinity LargeからMini/Nanoへの知識蒸留が含まれています。ただし30人規模のスタートアップであり、長期的な安定性の評価は各組織が判断してください。

Q. DeepSeek R1と比べてどちらが良いですか?

ライセンス・国籍を重視しないなら、DeepSeek R1(MIT、671B、37B active)は性能・コスト面で競合候補です。ただし中国製モデルの調達制限がある環境、またはApache 2.0の特許条項が必要な場合はTrinity Largeが適切です。詳しくはDeepSeekとはも参照してください。

Q. 無料で試す方法はありますか?

OpenRouterでTrinity-Large-Previewが無料提供中(プレビュー期間中)です。また、Trinity Builders Programに申請承認されると50M〜1B以上の無料APIクレジットが付与されます。

まとめ:Trinity Largeを選ぶべきか

Arcee AI Trinity Largeは「米国製・Apache 2.0・約400B・エージェント特化・$0.90/M」という組み合わせで、現時点でほぼ唯一の存在です。

Claude Opus 4.6比96%安価というコスト優位性は、エージェントワークフロー中心の大量API利用で特に有効です。同時に、コーディング精度・科学推論・日本語品質・APIの長期安定性ではクローズドフロンティアモデルに劣ります。

選ぶべきケース:エージェントタスク重視 × コスト削減 × OSSライセンス必要 × データ主権要件あり

他を選ぶべきケース:コーディング重視 × 日本語品質重視 × 長期サポート必須 × マルチモーダル必要

生成AIツール全体の比較は生成AIツールおすすめ比較、AIエージェント向けのフレームワーク選びはAIエージェントとはも参照してください。

この記事の著者

AI革命

編集部

AI革命株式会社の編集部です。最新のAI技術動向から実践的な導入事例まで、企業のデジタル変革に役立つ情報をお届けしています。豊富な経験と専門知識を活かし、読者の皆様にとって価値のあるコンテンツを制作しています。

最新記事

Claude Code HERMES.md 課金バグ まとめ|意図しない従量課金・$200超被害・対処法

2026/04/30

Claude Code Skills vs Hooks 使い分けガイド|SKILL.md・PreToolUse・PostToolUse 完全解説

2026/04/30

Anthropic 評価額$9,000億・$500億調達検討を徹底解説|OpenAI超え・ARR$300億・IPO 2026年10月

2026/04/30

Claude for Creative Work とは|Adobe・Blender・Autodesk・Ableton Live 9種クリエイティブコネクタ完全ガイド

2026/04/30

Microsoft Agent 365とは?5月1日GA・$15/user・AIエージェント統制プレーンを徹底解説

2026/04/29

Microsoft 365 Copilot エージェントとは?Word/Excel/PowerPointの自律実行機能・料金・制限を解説

2026/04/29