Hugging Face ml-internとは?オープンソースAI MLエンジニアがClaude Codeを超えた理由・使い方・料金を徹底解説

この記事のポイント

Hugging Faceが2026年4月公開のオープンソースMLエンジニアエージェント「ml-intern」を徹底解説。Apache-2.0ライセンス確定・Claude Codeとのベンチマーク比較・料金・使い方・2026年5月最新アップデート(/resume・/clear・Slack統合等)を完全網羅。

ml-internは、Hugging Faceが2026年4月21日に公開したオープンソースのAI MLエンジニアエージェントです。論文調査・データセット発見・学習スクリプト生成・GPUジョブ実行・評価・再学習までをエンドツーエンドで自律的に完結させる点が特徴で、GPQAベンチマークでQwen3-1.7Bを約10%から32%まで引き上げ、同条件のClaude Code(約22〜23%)を上回ったことで、LLMポストトレーニング(事後学習)領域で注目を集めています。ライセンスはApache-2.0で確定済み(2026年5月時点)であり、商用利用が可能です。

この記事でわかること:

- ml-internの正体と開発元・提供形態

- できること・できないこと

- Claude Code・OpenAI Codexとのベンチマーク比較と使い分け

- 料金・コスト構造(本体は無料/API・GPUのみ課金)

- 2026年5月の最新アップデート(新コマンド・Slack統合・データセット自動アップロード等)

- 実務者向けセットアップ手順と注意点

- 商用利用・ライセンス・セキュリティの論点

この記事は、LLMのファインチューニングを担当するMLエンジニア・研究者、Claude Code等の汎用エージェントで限界を感じている開発者、自社モデルのポストトレーニングを検討中の企業の技術選定者を対象にしています。

出典: Hugging Face公式ブログ「ML Intern Takehome」

ml-internとは

出典: huggingface/ml-intern GitHub公式リポジトリ

ml-internは、Hugging Faceが提供するオープンソースのML研究エージェントです。Hugging Face内のMLリサーチャーが実際に行っている研究ワークフロー(論文を読む → データを探す → モデルを学習する → 評価する → 再学習する)を、そのままエージェント化したものと位置付けられています。

汎用コーディングエージェントではなく、LLMのポストトレーニング(SFT・DPO・GRPOなどの事後学習)に特化している点が最大の特徴です。

基本情報

項目 | 内容 |

|---|---|

開発元 | Hugging Face |

リリース日 | 2026年4月21日 |

提供形態 | CLI(ローカル実行)+ Webアプリ(Hugging Face Spaces) |

基盤フレームワーク | smolagents(Hugging Face製の軽量エージェントライブラリ) |

実験管理 | Trackio(W&Bのオープンソース代替) |

クラウド実行 | Hugging Face Jobs 統合(H100等のGPUジョブ投入に対応) |

ライセンス | Apache-2.0(2026年5月確定済み) |

GitHub Stars | 約10,000(2026年5月時点) |

リポジトリ | |

公式タグライン | "an open-source ML engineer that reads papers, trains models, and ships ML models" |

誰が何のために作ったか

Hugging Faceは、Transformers・datasets・Hubといった機械学習エコシステムの中核を担う企業です。ml-internはそのHugging Faceが、「MLリサーチの現場でAIエージェントがどこまで自律できるか」を検証するために公開した実装公開型の研究成果でもあります。そのため、ツール単体で完結するのではなく、Hugging Face Papers・Hub・Jobs・Trackio・smolagentsといった既存エコシステムと深く連動する設計になっています。

2026年5月の最新アップデート

リリース(2026年4月21日)以降、急速に機能が拡張されています。現時点(2026年5月27日)での主要変更点を整理します。

項目 | リリース時(2026-04-21) | 現在(2026-05-27) |

|---|---|---|

ライセンス | 未確定(Issue #41確認中) | Apache-2.0 確定 |

デフォルト推奨モデル |

|

|

セッション管理コマンド | なし | /clear・/new・/resume 追加 |

データセット自動アップロード | 未対応 | HF Hubへの自動アップロード対応 |

CLIサンドボックス | なし | --sandbox-tools オプション追加 |

ローカルLLM対応 | 「差し替え可」のみ記載 | Ollama・vLLM・LM Studio・LlamaCPP明示 |

Slack統合 | なし | SLACK_BOT_TOKEN・SLACK_CHANNEL_IDで設定可 |

GitHub Stars | 約6,300 | 約10,000 |

新コマンドの詳細

2026年5月に追加された主なコマンドは以下の通りです。

/clear— 現在のセッションのコンテキストをリセット(新しい研究タスクに切り替えるときに使用)/new— 新規セッションとして再スタート(/clearより完全な初期化)/resume— 中断したセッションを再開(長時間タスクの途中停止・再開に対応)/share-traces— セッショントレース(実行ログ)の公開・非公開を切り替え

セッション追跡機能(新機能)

2026年5月以降、すべてのセッションが自動的に {username}/ml-intern-sessions という HFデータセットにアップロードされるようになりました。研究プロセスの再現性・共有・学習データ収集に使える一方、機密データを扱う場合はリポジトリをプライベート設定にすることが前提になります。

physics-intern:関連スピンオフ

2026年5月12日、Hugging Faceはml-internの設計を踏襲した理論物理学向け自律エージェント「physics-intern」をHugging Face Spacesで公開しました。数学・理論物理学の研究問題に特化した複数の専門エージェントが連携する構成で、ml-internがドメイン特化エージェント展開のためのベース基盤となっていることを示す動きです。

ml-internでできること

出典: smolagents/ml-intern — Hugging Face Spaces公式

ml-internは、MLリサーチャーが行う一連の研究ループをエージェント化しています。

1. 論文リサーチと引用グラフ追跡

- arXiv と Hugging Face Papers(hf.co/papers)を横断検索

- 論文の手法セクションを読み込み、引用グラフをたどって関連研究を芋づる式に収集

- 研究トレンドや手法の系譜を自律的に整理

2. データセット発見・品質評価・合成データ生成

- Hugging Face Hub の20万件以上のデータセットを検索

- 学習用にデータを精査・リフォーマット

- 既存データが不十分と判断した場合、合成データ生成スクリプトを自作する

- ローンチデモのHealthBenchタスクでは、1,100件の合成データを自動生成し50倍アップサンプリングして学習

- 2026年5月以降、作成したデータセットをHugging Face Hubへ自動アップロードする機能が追加

3. 学習スクリプトの生成と実行

- SFT(教師ありファインチューニング)

- DPO(Direct Preference Optimization)

- GRPO(Group Relative Policy Optimization) ※DeepSeek-R1等で採用された手法

これらのポストトレーニング手法を目的に応じて選び、スクリプト化・実行します。ローカルGPUに加え、Hugging Face Jobs経由でクラウドGPU(H100など)にジョブを投入できます。

4. 評価と自律デバッグ

- 学習後にベンチマーク評価を実行し、結果を自己解析

- reward collapse などRLHFでよくある失敗を自己診断

- ベンチマーク性能が目標に達するまで再学習を繰り返す

5. 長期コンテキスト管理とDoom Loop Detector

- 最大300イテレーションのエージェントループ

- 170kトークンで自動コンパクション(ContextManager)し、セッションをHugging Faceにアップロード

- ツール呼び出しパターンの繰り返し(行き詰まり)を検出するDoom loop detectorを搭載し、修正プロンプトを自動注入

6. 承認フロー

破壊的操作・クラウドジョブ投入・課金が発生する操作には、ユーザー承認が必須の設計になっています。Headlessモード(自動実行モード)でも、コストが発生する処理は必ずユーザー確認を挟みます。

利用モード(2026年5月時点)

モード | コマンド例 | 想定ユースケース |

|---|---|---|

Interactive |

| 対話型で1タスクずつ進める研究利用 |

Headless |

| CI/CDや自動パイプラインから呼び出す |

カスタム |

| モデルや上限を細かく制御する場合 |

Web(UI) | Hugging Face Spaces 上で操作 | CLI環境がない場合の簡易試用 |

ml-internの仕組み:3フェーズワークフロー

出典: Hugging Face公式ブログ「ML Intern Takehome」

ml-internは、以下の3フェーズで1つのタスクを処理します。

- Research — 関連論文・ドキュメント・コード例を探索し、手法を理解する

- Plan & Validate — タスクを分解し、必要リソース(GPU・データ・時間)を見積もる

- Implement — Pythonスクリプトを生成し、ローカルまたはクラウド(Docker / ephemeral HF Spaces)で実行する

主要コンポーネント

コンポーネント | 役割 |

|---|---|

Agent Core | LLMループを統括し、行き詰まりを検出する中核 |

Context Manager | 会話履歴とシステムプロンプトを管理(170kトークンで自動コンパクション) |

Tool System(ToolRouter) | API・MCPサーバー・サンドボックスへのルーティング |

Submission Queue | producer-consumerパターンでユーザー入力を処理 |

Doom Loop Detector | ツール呼び出しパターンの繰り返し検出・修正プロンプト注入 |

インターフェイスはCLIとWebの2系統です。WebアプリはFastAPI(バックエンド)+ React(フロントエンド)で構築されており、リアルタイムSSEストリーミングでエージェントの思考過程を確認できます。

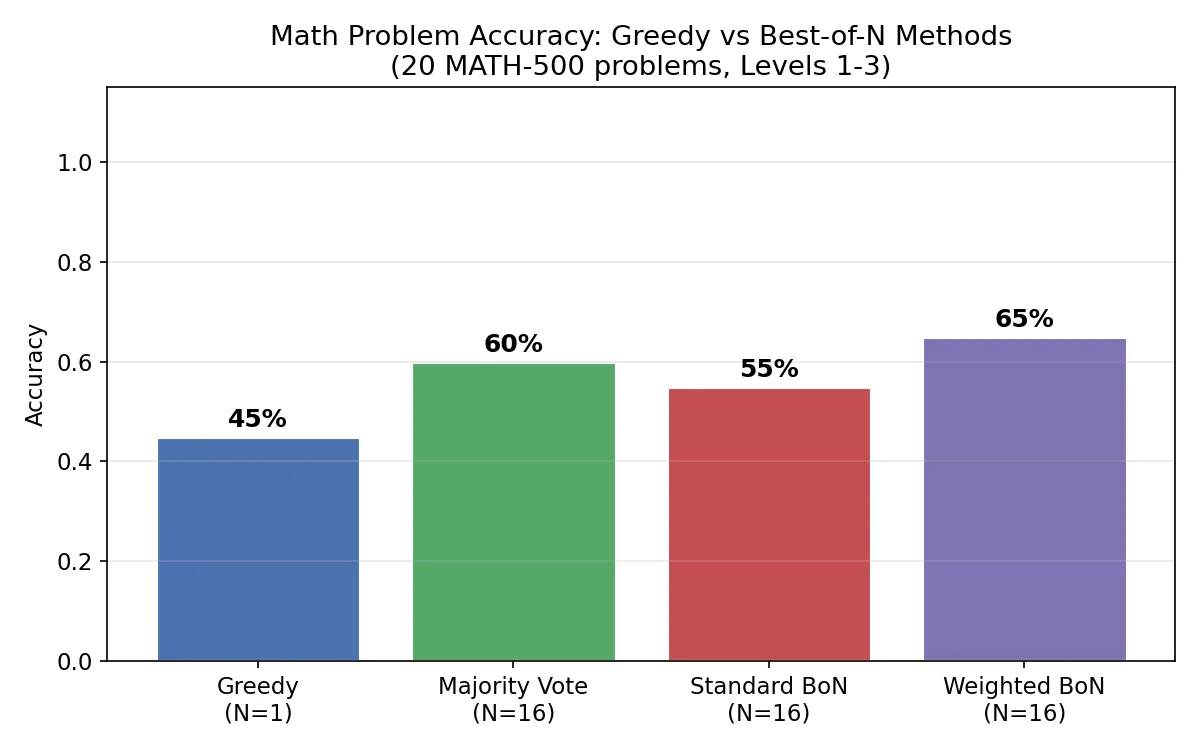

ベンチマーク:Claude Code・Codexを超えた根拠

出典: ML Intern Takehome — Hugging Face公式ブログ

ml-internが注目を集めている最大の理由は、同条件のClaude CodeやOpenAI Codexを上回るベンチマーク結果が公開された点です。公式ブログおよびMarkTechPost・byteiotaなどのテック系メディアが、以下の数値を報じています。

GPQA(大学院レベル科学推論ベンチマーク)

エージェント | スコア | 条件 |

|---|---|---|

Qwen3-1.7B ベースライン | 約10%(MarkTechPostでは8.5%との報告もあり) | ファインチューニング前 |

ml-intern(Qwen3-1.7B 事後学習後) | 32% | H100 × 1枚、10時間以内 |

Claude Code(同タスク) | 約22〜23%(PostTrainBench公式値: 23.2%) | 同条件 |

ml-internは学習開始から3時間強の時点で27.5%に到達するなど、学習効率も高いと報告されています。

HealthBench(医療ベンチマーク)

- ml-intern は OpenAI Codex を約60%上回るスコアを記録(byteiota報告)

- 既存データセットの品質が不十分と判定したml-internが、緊急対応・ヘッジ・多言語対応を含む1,100件の合成データを自動生成

- この合成データを50倍アップサンプリングして学習に使用

PostTrainBench(評価規格)

University of Tübingen と Max Planck Institute が提案したベンチマーク規格で、「単一H100 GPU × 10時間」の制約内で、ベースモデルをどこまで改善できるかを計測します。ml-internはこのPostTrainBenchの環境で、Claude CodeやCodexと比較されています。なお、人間チームのスコアは51.1%(PostTrainBench公式値)であり、現時点でのAIエージェントの限界も正直に見えます。

「Claude Code超え」を正しく理解するポイント

現時点では、Claude Code超えはあくまで「特定の制約下(単一H100 × 10時間 × LLMポストトレーニングタスク)での結果」です。汎用コーディングベンチマーク(SWE-bench等)ではClaude Codeが依然として優勢(80.8%前後)であり、評価タスクが違えば強みも変わることに注意してください。

ml-intern vs Claude Code vs OpenAI Codex:使い分け表

AIエージェントはすでに「汎用1強」の時代ではなく、用途に応じて使い分けるフェーズに入っています。

項目 | ml-intern | Claude Code | OpenAI Codex |

|---|---|---|---|

得意領域 | LLMポストトレーニング(SFT/DPO/GRPO) | 汎用コーディング・マルチファイル編集 | コード補完・自律的コード生成 |

ベンチマーク強み | GPQA、HealthBench、PostTrainBench | SWE-bench 80.8% 級 | 一般コード生成・補完 |

提供形態 | OSS(CLI + Web Space) | CLIツール(Anthropic公式) | IDE拡張/CLI/クラウド |

ライセンス | Apache-2.0(確定済み) | 商用ライセンス(Anthropic) | 商用ライセンス(OpenAI) |

デフォルトLLM | Anthropic Claude(差し替え可) | Anthropic Claude | OpenAIモデル |

GPU実行 | HF Jobs でクラウド実行可 | 非対応(コードのみ) | 非対応 |

論文/データ検索 | arXiv・HF Papers・HF Hubに統合 | 汎用Web検索 | 汎用Web検索 |

合成データ生成 | 自動生成が可能(自律判断) | 指示次第で可能 | 指示次第で可能 |

ローカルLLM対応 | Ollama・vLLM・LM Studio等に対応 | 非対応 | 非対応 |

こんな方に | MLリサーチャー、ポストトレーニング担当 | 汎用ソフトウェア開発者 | 一般的なコーディング全般 |

選び方の目安

- GitHub Copilot:IDE上のオートコンプリートで十分な場合

- Claude Code:コードベース全体の読解・リファクタ・マルチファイル編集

- ml-intern:LLMの事後学習、論文再現、データセット構築の自動化

この3つは競合ではなく補完関係と捉えるのが現実的です。Claude CodeやGitHub Copilotの比較については、Claude Code vs GitHub Copilot 比較やCursor vs Claude Code 比較も参照してください。

ml-internの料金とコスト構造

本体は無料のオープンソース(Apache-2.0)

ml-intern本体(CLI・Webアプリ・コード)は無料で利用できます。ライセンスはApache-2.0で確定しており、商用利用が可能です。ただし、実行時には以下の従量課金が発生する点に注意が必要です。

コスト要素 | 発生条件 | 備考 |

|---|---|---|

LLM API(Anthropic等) | 推論の都度 | デフォルトは |

Hugging Face Jobs GPU | クラウド学習ジョブ投入時 | H100等を従量課金で利用。ジョブ投入には承認フロー必須 |

Hugging Face アカウント | Hub・Jobs利用 | 無料枠あり。Pro/Enterpriseは追加機能 |

Claude Opus 4.7の料金(2026年5月時点)

デフォルト推奨モデルであるClaude Opus 4.7の料金は以下の通りです(Anthropic公式、2026年5月27日確認)。

モデル | 入力 | 出力 |

|---|---|---|

Claude Opus 4.7(現行デフォルト推奨) | $5 / 1M tokens | $25 / 1M tokens |

長時間のエージェントループでは推論コストが積み上がりやすいため、事前に月次予算と1回あたりの上限を設定することが前提になります。

ローンチキャンペーン

リリース時、Hugging Faceは早期採用者向けに $1,000分のGPUクレジット+Anthropicクレジットを提供するキャンペーンを実施しました。枠に限りがあるため、現在も提供中かどうかは公式ページの最新情報で確認してください。

実務上のコスト感

1回のポストトレーニングセッションでは次のコストが一般的な目安となります。

- LLM API:数ドル〜数十ドル(タスク規模・モデル・イテレーション数に依存)

- HF Jobs GPU:H100が1時間あたり数ドル〜。10時間で数十ドル

ローカルGPUを持つ研究室ではHF Jobsのコストを抑えられますが、API推論コストは常に発生します。Claude Opus 4.7等の高性能モデルをデフォルトで使う構成のため、長時間のイテレーションでは想定以上にAPI課金が積み上がる可能性があり、事前に上限設定と承認フローを確認することが重要です。

ml-internの使い方・セットアップ

出典: Hugging Face ml-intern GitHub公式リポジトリ

公式README(2026年5月時点)をもとに、セットアップ手順を説明します。

事前準備:APIキーの発行(最小権限で)

ml-internは複数のAPIキーを必要とします。それぞれ最小権限スコープで発行することが推奨されます。

キー | 用途 | 推奨スコープ |

|---|---|---|

| LLM推論(デフォルト経路) | 推論のみ |

| Hugging Face Hub 書き込み/Jobs 実行 | Write(必要最小限のリポジトリ) |

| コード検索 | public_repo のみ(書き込み不要) |

| ローカルLLM利用時 | — |

| Slack通知(任意) | — |

インストール

公式READMEに従い、uvを使ったインストールが推奨されています。

# リポジトリをクローン

git clone git@github.com:huggingface/ml-intern.git

cd ml-intern

# 依存パッケージをインストール

uv sync

uv tool install -e .

# APIキーを環境変数にセット

export ANTHROPIC_API_KEY=sk-ant-...

export HF_TOKEN=hf_...

export GITHUB_TOKEN=ghp_...実行

# 対話型セッション

ml-intern

# ワンショット実行

ml-intern "Qwen3-1.7BをGPQAで改善して"

# モデルや最大イテレーションを指定

ml-intern --model anthropic/claude-opus-4-7 --max-iterations 100 "..."

# サンドボックスモードで実行(2026年5月追加)

ml-intern --sandbox-tools "..."セッション管理コマンド(2026年5月追加)

# セッション中に使えるコマンド

/clear # 現在のコンテキストをリセット

/new # 新規セッションとして再スタート

/resume # 中断したセッションを再開

/share-traces # セッショントレースの公開/非公開を切り替えローカルLLMへの差し替え

完全にローカルで完結させたい場合は、ローカルLLMサーバーを推論エンドポイントとして設定できます。対応ツールは以下の通りです(2026年5月時点)。

ツール | 用途 |

|---|---|

Ollama | 手軽なローカルLLMサーバー(macOS/Linux/Windows対応) |

vLLM | 高スループットなOpenAI互換サーバー |

LM Studio | GUIでモデル管理・ローカルサーバー起動 |

LlamaCPP | C++ベースの高速LLM推論 |

# ローカルLLMを使う場合(例:Ollamaの場合)

export LOCAL_LLM_BASE_URL=http://localhost:11434/v1

ml-intern --model ollama/llama3 "..."Slack統合の設定(任意)

承認要求・エラー・処理完了時にSlack通知を受け取りたい場合は以下の設定が必要です。

export SLACK_BOT_TOKEN=xoxb-...

export SLACK_CHANNEL_ID=C...長時間タスクを非同期で走らせるCI/CDパイプライン用途に特に有用です。

Webアプリでの試用

CLI環境が用意できない場合は、Hugging Face Spaces上で公開されている smolagents/ml-intern にアクセスし、ブラウザで同等の操作を試せます。最新の正確なコマンド・依存パッケージは、公式リポジトリのREADME を参照してください。

ml-internの強み

1. MLリサーチの現場ワークフローをそのままエージェント化

論文読解 → データ整備 → 学習 → 評価 → 再学習、というMLリサーチの一連の流れを自律的に回せます。合成データ生成を自発的に行う点は、他の汎用エージェントにはほぼ見られない特徴です。

2. Hugging Faceエコシステムへの深い統合

Hugging Face Hub・Papers・Jobs・Trackio・smolagentsと密に連携しており、「ドキュメントを読む/データを探す/学習する/実験を追跡する」が1つのエージェントで完結します。

3. コスト暴走を防ぐ承認フロー

GPUジョブ投入など課金が発生する操作には必ず承認が入るため、エージェントの暴走による想定外の請求を抑制しやすい設計です。

4. オープンソース(Apache-2.0)で商用利用可

コードが公開されているため、カスタマイズや社内フォーク、挙動の可視化、セキュリティ監査がやりやすいという利点があります。ライセンスはApache-2.0で確定済みであり、企業の商用利用も可能です。

5. ローカルLLMへの差し替えでオンプレ完結が可能

Ollama・vLLM・LM Studio・LlamaCPPなど複数のローカルLLMに対応しており、推論経路を完全にオンプレミスにできます。機密データを扱う組織でも、外部API通信なしの構成が実現できます。

6. ベンチマーク上の客観的な性能

GPQA・HealthBench・PostTrainBenchといった評価軸で、同条件のClaude CodeやCodexを上回る結果が出ている点は、技術的な裏付けとして無視できません。

ml-internの弱み・制約

一方で、次の制約を理解せずに導入すると、期待外れになりやすい点があります。

1. 汎用ソフトウェア開発には向かない

ml-internはあくまでMLポストトレーニング特化です。一般的なWebアプリ開発、マルチファイル編集、リファクタリングはClaude CodeやCursorのほうが適しています。

2. 事前学習(pre-training)はスコープ外

ベースモデルの新規事前学習はサポートしません。SFT・DPO・GRPOなどの事後学習が中心です。巨大な事前学習ジョブを回したい場合は別の基盤が必要です。

3. デフォルトがAnthropic API依存

ANTHROPIC_API_KEYがデフォルトの推論経路になっています。ローカルLLMへの差し替えは可能ですが、初期設定で調整が必要です。完全ローカル完結にはLOCAL_LLM_BASE_URLの設定が前提です。

4. 日本語タスクの実績は未公開

公式ベンチマーク(GPQA・HealthBench)は英語タスク中心で、日本語LLMのポストトレーニングにおける性能は現時点で確認できません。

5. GPUコストの完全自動管理はできない

承認フローはあるものの、長時間の再学習ループでLLM API料金とGPUコストが積み上がる可能性があります。事前に上限を決めて運用することが前提です。

6. セッション自動アップロードへの注意

すべてのセッションが自動的にHFデータセットにアップロードされます。機密データを扱う場合は必ずリポジトリを private に設定し、アップロード範囲を事前確認してください。

Hugging Faceエコシステムとの関係

ml-internを理解するうえで、Hugging Faceが公開している関連コンポーネントの位置関係を押さえておくと便利です。

コンポーネント | 役割 | ml-internとの関係 |

|---|---|---|

smolagents | 軽量なエージェントフレームワーク | ml-internの基盤ライブラリ |

Trackio | オープンソース実験追跡(W&B代替) | 学習セッションと評価の記録 |

Hugging Face Jobs | クラウドGPUジョブ実行基盤 | ml-internが学習ジョブを投入 |

Hugging Face Papers | 論文検索・AIメタデータ管理 | ml-internの論文リサーチ経路 |

Hugging Face Hub | モデル・データセット・Spacesの中央リポジトリ | データ検索・モデル公開・セッション追跡 |

Hugging Face Spaces | アプリ/サンドボックス実行環境 | ml-internのWebアプリ稼働場所 |

この「smolagents × Trackio × Jobs × Hub」の組み合わせが、Hugging Face版AIエージェントインフラのコアになる構想が見えます。

ml-internが向いている人・向いていない人

こんな方におすすめ

- LLMのファインチューニングを担当するMLエンジニア・研究者

- 論文を再現したいが、データ整備〜学習〜評価の手間が大きいと感じている方

- Hugging Face Hub・Jobs を既に使っている研究チーム

- 合成データ生成を自動化したい医療・法務・カスタマーサポート系の企業

- オープンソースのエージェント基盤を自社で拡張・カスタマイズしたい開発者

- ローカルLLMで推論経路を完全内部化したいセキュリティ重視の組織

おすすめしない方

- 汎用的なソフトウェア開発(Webアプリ・業務システム)を主な用途とする方 — Claude CodeやCursorの方が適しています

- 機密データを扱い、クラウドへのデータ送信を一切避けたい企業 — ローカルLLM差し替え+プライベートリポジトリ設定が必須。設定コストを要確認

- 日本語LLMのポストトレーニングで即戦力を期待している方 — 現時点では英語タスクベースの実績しか公開されていないため、検証前提で使う必要があります

- コードを一切書かない非エンジニアユーザー — MLパイプラインの基礎知識がないと設定・運用のハードルが高いです

- ベースモデルの事前学習(pre-training)を主目的とする方 — スコープ外です

商用利用・セキュリティ上の注意点

企業導入を検討する際は、以下の観点を事前に確認してください。

1. ライセンス:Apache-2.0で商用利用OK

2026年5月時点でApache-2.0ライセンスが正式確定しています。商用利用・再配布・改変が可能です(ただし著作権表示と免責事項の維持が条件)。最終確認は公式リポジトリの LICENSE ファイル を参照してください。

2. Hugging Face Hubへの自動アップロード

ml-internは、セッションログ・学習済みモデル・データセット等のアーティファクトをHugging Face Hubにアップロードする場合があります。機密データを扱う場合は、リポジトリを必ず private に設定し、どの成果物がアップロードされるか事前に確認してください。

3. APIキーの権限スコープ

ANTHROPIC_API_KEY・HF_TOKEN・GITHUB_TOKEN の各キーをエージェントに渡す構造のため、それぞれ必要最小限のスコープで発行し、定期的にローテーションすることが推奨されます。

4. クラウドジョブのコスト暴走

Hugging Face Jobs のGPUジョブは従量課金です。承認フローはあるものの、長時間の再学習ループでAPI料金・GPUコストが積み上がる可能性があります。月次予算と1回あたりの上限を決めて運用する前提が必要です。

5. プロンプトインジェクション耐性

論文や外部ドキュメントを自律的に読み込む構造のため、悪意ある指示が混入した外部コンテンツをエージェントが参照するリスクはゼロではありません。サンドボックス実行(--sandbox-toolsオプション)と承認フローを厳守することが前提になります。

6. Headlessモードの自動承認に注意

ヘッドレスモードはプロンプトに対して自動承認モードで動作します。コスト発生する処理は必ずユーザー確認が入る設計ですが、CI/CDパイプラインに組み込む前に動作を手動で確認しておくことを推奨します。

AIエージェント全般のセキュリティ論点はAIエージェント セキュリティ 対策ガイドも参考にしてください。

よくある質問

Q1. ml-internはClaude Codeの代わりになりますか?

なりません。ml-internはLLMポストトレーニング特化、Claude Codeは汎用コーディングと役割が異なります。日常のコード編集やバグ修正はClaude Code、モデル学習の自動化はml-intern、という棲み分けが現実的です。詳しくはClaude Codeとは|できること・使い方・料金を整理を参照してください。

Q2. 無料で使えますか?

本体はApache-2.0の無料オープンソースです。ただし、実行時にLLM API課金(デフォルトはAnthropic Claude Opus 4.7:入力$5/MTok・出力$25/MTok)と、クラウド学習を使う場合はHugging Face Jobs のGPU課金が発生します。

Q3. 日本語のデータセット・タスクで使えますか?

技術的には可能ですが、公式ベンチマーク(GPQA・HealthBench)は英語中心です。日本語LLMのポストトレーニングにおける実績は未公開のため、検証前提で使う必要があります。

Q4. ローカルのGPUだけで完結できますか?

ローカル実行は可能ですが、デフォルト構成ではLLM推論をAnthropic API経由で行うため、推論コストは発生します。完全にローカル完結したい場合は、Ollama・vLLM・LM Studio・LlamaCPPなどのローカルLLMサーバーを LOCAL_LLM_BASE_URL 環境変数で設定して推論エンドポイントを差し替える必要があります。

Q5. ライセンスはどうなっていますか?

Apache-2.0で確定済み(2026年5月時点)です。商用利用・改変・再配布が可能です。公式リポジトリの LICENSEファイル で最新状態を確認してください。

Q6. Hugging Faceアカウントは必要ですか?

Hugging Face Hub・Jobs・Spacesの利用にはHugging Faceアカウント(無料枠あり)が必要です。HF_TOKENの発行にもアカウントが必要になります。

Q7. セキュリティ監査は可能ですか?

オープンソースなので、コードレベルでの監査は可能です。ただし、推論経路(Anthropic API)とHF Jobs の外部通信は発生するため、オンプレ完結が必要な場合はローカルLLMへの差し替えと、HF Jobs の代わりにローカルGPUサーバーを使う構成を検討してください。

Q8. --sandbox-toolsオプションとは何ですか?

2026年5月に追加されたCLIサンドボックスランタイムオプションです。コード実行を隔離された環境に閉じ込めることで、エージェントによる意図しないシステム操作を防ぐことができます。企業環境での本番利用では積極的に使用することを推奨します。

まとめ:ml-internはどんな立ち位置のツールか

- ml-internは、Hugging Faceが公開したLLMポストトレーニング特化のオープンソースAI MLエンジニアエージェント

- ライセンスはApache-2.0で確定済み(2026年5月)。商用利用・改変・再配布が可能

- GPQA・HealthBench・PostTrainBenchの結果では、同条件のClaude Code・Codexを上回るケースが公式に示されている

- ただし「Claude Code超え」は特定条件での話であり、汎用コーディングはClaude Codeなどに軍配が上がる

- 本体は無料のオープンソース。課金は LLM API(Claude Opus 4.7:入力$5/MTok・出力$25/MTok)と Hugging Face Jobs GPU のみ

- 2026年5月のアップデートで /resume・/clear・/new コマンド追加、データセット自動アップロード、Slack統合、ローカルLLM(Ollama/vLLM等)明示対応が加わり、実用性が大幅に向上

- セッション自動アップロード・コスト暴走・プロンプトインジェクションが企業導入時の主要検討ポイント

- MLエンジニア/研究者にとっては、研究ループの自動化ツールとして極めて強力

MLリサーチの自律化という観点で見ると、ml-internは「汎用AIエージェント時代」から「ドメイン特化型AIエージェント時代」への潮流を象徴するツールです。Claude Code等の汎用エージェントと競合ではなく補完関係で導入するのが、現実的な落としどころと言えるでしょう。physics-internのような専門分野特化エージェントへの展開も始まっており、今後さらに種類が増えていく可能性があります。

次に読むべきページ

- AIエージェントとは|仕組み・種類・代表ツールを解説

- AIエージェント おすすめ 比較

- AIエージェント フレームワーク 比較

- Claude Codeとは|できること・使い方・料金を整理

- Claude Code vs GitHub Copilot 比較

- AIエージェント セキュリティ 対策ガイド

- 生成AIとは|仕組み・種類・代表ツール

主要出典

- huggingface/ml-intern(GitHub公式リポジトリ)

- GitHub LICENSE(Apache-2.0確認)

- smolagents/ml-intern(Hugging Face Spaces)

- ML Intern Takehome — Hugging Face公式ブログ

- MarkTechPost: Hugging Face Releases ml-intern

- byteiota: ml-intern Beats Claude Code

- Analytics Vidhya: ML Intern from Prompt to Shipped HF Model(2026年5月)

- DeepWiki: huggingface/ml-intern

- Claude Models Overview — Anthropic公式(2026年5月27日確認)

- physics-intern — Hugging Face Spaces

この記事の著者

AI革命

編集部

AI革命株式会社の編集部です。最新のAI技術動向から実践的な導入事例まで、企業のデジタル変革に役立つ情報をお届けしています。豊富な経験と専門知識を活かし、読者の皆様にとって価値のあるコンテンツを制作しています。

最新記事

Prime Intellect Labとは?セルフ改善AIエージェントを訓練するフルスタックプラットフォームの機能・料金・使い方を完全解説

2026/05/28

ChatGPT料金【日本円換算】2026年最新|全プラン比較・選び方

2026/03/31

AIエージェントフレームワーク比較12選【2026年最新】LangChain・CrewAI・Dify

2026/04/02

Claude料金【日本円】2026年最新|Free/Pro/Max/Team全プラン比較

2026/03/26

税務AI活用【2026年最新】AI-OCR自動仕訳・JDL評判・freee連携

2026/04/23

Grokとは?Agent Mode使い方・料金・ChatGPTとの比較【2026年最新】

2026/04/18