トヨタ Woven AI Vision Engine (WAVE) とは|MVBench世界最高水準73.81%の8Bモデル徹底解説

この記事のポイント

トヨタとWoven by Toyotaが2026年4月に発表した動画理解AI基盤モデル「WAVE」を公式情報ベースで徹底解説。MVBench 73.81%・8Bモデル・階層的圧縮の技術背景から、AWS Marketplaceでの料金、活用事例、他社VLMとの違い、向いている人まで一気通貫で整理します。

Woven AI Vision Engine(WAVE)とは、トヨタ自動車とWoven by Toyotaが2026年4月22日に発表した、カメラ映像を言語として理解する独自のマルチモーダルAI基盤モデル(Vision Language Model / VLM)です。約80億パラメータ(8B)という軽量クラスながら、動画理解ベンチマーク「MVBench」で73.81%という世界最高水準のスコアを記録し、Woven Cityの都市インフラ・モビリティ・安全システムの中核として運用が始まっています。

この記事でわかること

- WAVEの定義と位置付け(何者で、誰が、何のために作ったか)

- 技術的な強み:8Bモデル×階層的圧縮という設計思想の意義

- MVBench 73.81%という数値の実務的な意味

- AWS Marketplace経由で今すぐ試せる料金・APIパラメータ

- Woven City Integrated ANZEN System(Behavior AI/Drive Sync Assist)との連携

- 他社VLM(Gemini 3.1 Pro/Qwen 3.5-Omni/GPT-image-2等)との使い分け

- 向いている企業・向いていない企業の判断基準

誰向けの記事か

- 動画理解AI・VLMの最新動向を追う技術マネージャー/R&D担当

- 監視カメラ・産業用カメラ映像の業務活用を検討する製造・小売・交通事業者

- 国産AI基盤モデル・モビリティAIに関心のある経営企画/DX担当

- 自動車・モビリティ領域のアナリスト/メディア関係者

WAVE(Woven AI Vision Engine)とは何か

WAVEは、街・車・人の動きを「映像→言語」で理解することに特化したマルチモーダル基盤モデルです。開発したのはトヨタ自動車の100%子会社であるWoven by Toyota, Inc.(WbyT)で、2026年4月22日に静岡・Woven City内の「Inventor Garage」で正式発表されました。

公式プレスリリースでは、WAVEを「街がリアルタイムに現実世界の状況を理解し応答するための大規模AI基盤モデル」と位置付けています。つまり単なる画像認識ではなく、監視カメラや車載カメラの映像をテキストに変換し、次に起こる事象を予測してモビリティ・インフラ側に指示を出す、都市OSの目の役割を担います。

開発・提供元の基本情報

項目 | 内容 |

|---|---|

正式名称 | Woven City AI Vision Engine(通称 WAVE) |

開発元 | Woven by Toyota, Inc.(トヨタ自動車100%子会社) |

発表日 | 2026年4月22日 |

発表場所 | 静岡・Woven City内「Inventor Garage」 |

カテゴリ | 動画理解特化のマルチモーダルLLM(VLM) |

現行バージョン | v1.0.5-alpha(AWS Marketplace公開時点) |

提供形態 | Woven City内実証/AWS Marketplace(Amazon SageMaker)で一般提供 |

現時点ではv1.0.5-alphaというアルファ版の位置付けであり、本番投入にあたっては自社で精度・安定性を評価することが推奨されます。

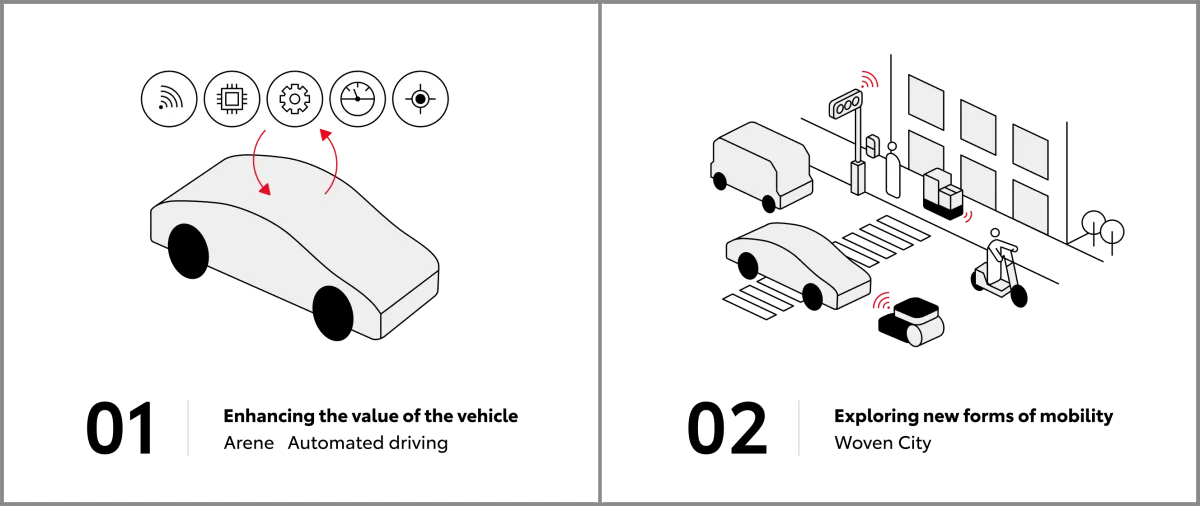

なぜトヨタが独自VLMを作るのか

自動運転や高度運転支援(ADAS)は、従来「物体検出→経路予測→制御」という個別モデルの積み重ねで構築されてきました。一方でWAVEは、映像を言語化して「何が起きているか」「次に何が起こりそうか」を一気通貫で理解するVLMベースのアプローチです。

Woven by Toyotaは「Kakezan(カケザン=掛け算)」をキーワードに、街・車・人の情報をAIで横断的に掛け合わせる思想を掲げており、その中心技術がWAVEです。既存の産業向け汎用VLMでは都市内イベント(飛び出し・信号認識・注意散漫)の解釈精度やレイテンシが足りないため、自社設計に踏み切った、というのが公式の位置付けです。

WAVEでできること

WAVEは動画理解に強みを持つVLMとして、以下のようなタスクに対応しています。

主な機能一覧

- Visual Question Answering(VQA):画像・動画に対する自然言語での質問応答

- 長尺動画理解:独自の階層的圧縮により、長時間動画でも計算コストと品質劣化を抑制

- リアルタイム映像→言語変換:街頭カメラ・車載カメラの映像を自然文に変換

- 時空間推論:死角の歩行者・対向車の動き検知、次に起こる事象の予測

- 画像/動画キャプション生成

- マルチターン対話:履歴を考慮した連続会話

- Woven City Integrated ANZEN System(後述)の中核エンジン

入力できるメディア

入力タイプ | 対応形式 |

|---|---|

テキスト | プロンプト/質問文 |

画像 | JPG、PNG |

動画 | MP4(推奨)、AVI。H.264/MPEG-4コーデック推奨 |

動画はフレームレート・最大フレーム数をAPIパラメータで指定でき、リアルタイム用途と長時間動画の一括解析のどちらにも調整可能です。

実際の活用シーン(公式+実証段階)

- 交差点の安全監視:歩行者の急な飛び出しを事前検知し、車両側に減速指示

- ドライバーの注意散漫検知:スマホ注視・視線逸脱をリアルタイムで言語化

- 店舗内の来客行動解析:天井カメラ映像から体の揺れや表情変化まで解析(UCC Japan実証)

- モビリティインフラの異常検知:道路・設備の変化を映像から自然言語レポート化

- 長尺動画の要約・検索:会議録画やサーベイランス映像を時系列で要約

WAVEの技術的強み|8Bで73.81%が意味すること

WAVEを語る上で最重要なのが、「8B(80億パラメータ)という軽量モデルで、MVBench 73.81%を叩き出した」という事実です。

MVBenchとは

MVBench(Multi-modal Video Benchmark)は、OpenGVLabが提供する動画理解AIのための総合ベンチマークです。動作認識・物体追跡・時空間推論など20種類のタスクをまとめて評価し、現時点で動画VLMの性能を横比較する標準的な指標として広く参照されています。

73.81%というスコアの位置付け

公式プレスリリースでは「動画理解の世界トップレベル」と表現されています。一般的に、このレベルのスコアを狙うモデルは30B〜70B級の大型VLMが主流で、8Bクラスでこのスコアを達成したケースは希少です。

※他社モデルの具体スコアは、MVBench公式リーダーボード(OpenGVLab)で常に変動します。本記事で他社の特定スコアを列挙することは避け、最新値は公式リーダーボードを確認してください。

独自の2段階階層的圧縮(Hierarchical Compression)

WAVEが軽量モデルで高精度を出せる最大の理由が、2段階の階層的圧縮という独自アーキテクチャです。

- 微細粒度(fine-grained):重要フレームを細かく解析して情報量を保持

- 粗粒度(coarse-grained):冗長なシーンをまとめて圧縮し、計算コストを削減

このハイブリッド設計により、「長時間動画でも高精度」と「小さいモデルサイズで高速推論」を両立しています。エッジ展開・低レイテンシが求められる車載・街頭カメラ用途にフィットする設計です。

8B軽量モデルが実務で強い理由

観点 | 大型VLM(30B〜70B) | WAVE(8B) |

|---|---|---|

推論コスト | 高い(GPUメモリ・電力) | 低い |

レイテンシ | 遅め | 速い |

エッジ展開 | 困難 | 現実的 |

長尺動画対応 | コストが跳ね上がりやすい | 階層的圧縮で抑制 |

本番運用の総コスト | 高 | 中〜低 |

モビリティ・都市インフラ用途では常時稼働+低レイテンシ+多拠点展開が必須で、モデルサイズが運用コストに直結します。WAVEの設計思想は、「精度は高いが重いVLMを街中に並べられない」という現実的な制約への解答と言えます。

WAVEの料金・プラン(AWS Marketplace版)

WAVEは2026年4月時点で、AWS Marketplace経由でAmazon SageMakerから一般利用が可能です。オンプレミス版やモデルウェイトのダウンロード提供は、現時点では公式から確認できていません。

ソフトウェア料金表

インスタンスタイプ | WAVEソフトウェア料金(USD/時間・ホスト単位) | 利用モード |

|---|---|---|

ml.g5.8xlarge | $5.00 | バッチ・リアルタイム |

ml.g5.12xlarge(推奨) | $6.00 | バッチ・リアルタイム |

ml.g5.24xlarge | $7.00 | バッチ・リアルタイム |

ml.g5.48xlarge | $8.00 | バッチ・リアルタイム |

上記はあくまでWAVEのソフトウェア利用料のみで、別途Amazon SageMakerのインフラ料金(インスタンス・ストレージ・データ転送等)が発生します。AWS Marketplaceの機械学習プロダクトにおけるハイブリッド課金モデルの典型例です。

現時点では法人契約・ボリュームディスカウントの有無や、エンタープライズ向けSLAの条件は公開されていません。本番導入を検討する場合はWoven by Toyota/AWSへの個別相談が必要です。

提供形態

- リアルタイムエンドポイント:APIによる同期推論

- バッチ推論:Amazon S3入出力でのオフライン解析(ジョブ実行中のみ課金)

- ドキュメント:サンプルノートブック・API仕様が付属

APIパラメータ

パラメータ | 範囲 | デフォルト |

|---|---|---|

max_new_tokens | 1〜2048 | 80 |

temperature | 0.1〜2.0 | 0.6 |

fps | 0.1〜10.0 | 1.0 |

max_num_frames | 1〜1024 | 8 |

fpsとmax_num_framesは動画解析の粒度と計算コストを直接左右するため、用途別に最適値のチューニングが必要です。リアルタイム用途ではfpsを低めに、長尺の詳細解析ではmax_num_framesを大きめに設定するのが基本です。

Woven City Integrated ANZEN Systemとの統合

WAVEは単独のAIではなく、Woven City Integrated ANZEN System(交通事故ゼロを目指す統合安全システム)の中核エンジンとして設計されています。ANZEN Systemは以下3つの独自AIを組み合わせた仕組みです。

技術 | 役割 |

|---|---|

WAVE(AI Vision Engine) | カメラ映像→言語化・イベント予測。中核エンジン |

Woven City Behavior AI | 個人の行動特性を予測・解釈(歩行者・ドライバー個別の癖を学習) |

Woven City Drive Sync Assist | ドライバー状況・周辺環境に応じた運転支援の最適化 |

この統合により、車両・信号機・街頭カメラのデータを横串で読み取り、「歩行者の急な飛び出し」「スマホ注視による注意散漫」などを事前検知し、同期的な減速・警告・操舵補正を行います。

Woven by Toyotaの思想は「AIは人の代替ではなく、人の力を引き出すもの」です。完全自動運転そのものを目的にするのではなく、事故予防・ヒューマンエラーの補完にフォーカスしている点がポイントで、他社の自動運転特化AIとは立ち位置が異なります。

実証事例|UCC Japan×Woven Cityのコーヒー行動解析

WAVEは自動車・モビリティ以外の用途でも活用が始まっています。象徴的なのがUCC Japanとの連携です。

Woven City内の「上島珈琲店 Woven City店」に設置された天井カメラ映像をWAVEが解析し、以下をデータ化しています。

- コーヒーを飲むタイミング

- スマホ操作の頻度

- 会話・集中時の体の微細な揺れ

- 姿勢や表情の変化

これらの情報を、コーヒーが創造性・生産性に与える影響の検証に活用する、という実証プロジェクトです。「監視」ではなく「行動の意味を解釈する」用途として、小売・飲食・オフィス・教育など広範な応用可能性を示唆しています。

WAVEの弱み・注意点

どんな基盤モデルにも制約があります。WAVEを検討する際に確認すべきポイントを整理します。

現時点で確認できている制約

- v1.0.5-alphaというアルファ版の位置付け。仕様・価格・API変更の可能性が高い

- 日本語応答の性能は公式から未明示。MVBenchは英語中心のベンチマークのため、日本語UIや日本語プロンプトでの精度は個別検証が必要

- オンプレ版・モデルウェイトのダウンロード提供は現時点で未確認。AWS SageMaker経由のマネージド提供が基本

- 法人契約の詳細やボリュームディスカウントは未公開

- Behavior AI/Drive Sync Assistの外部提供可否は未発表

プライバシー・法令対応の実務観点

WAVEは監視カメラ映像を扱う性質上、個人情報保護法・各自治体のカメラ条例への対応が前提です。公式プレスは「人中心・倫理重視」を強調していますが、導入側が次の論点を自前で整理する必要があります。

- 映像データの保管期間・保管場所(国内/海外)

- 顔・ナンバープレート等の特定個人情報の扱い

- 店舗・施設内での事前告知・オプトアウト設計

- ログ・推論結果のアクセス制御と監査証跡

他社VLMとの違い・使い分け

動画・画像理解の分野では、GPT系・Gemini系・国産オープンモデルなど選択肢が増えています。用途別の選び分けを整理します。

主要VLMとのポジショニング比較

モデル | 提供元 | 強み | WAVEと比べた位置付け |

|---|---|---|---|

WAVE | Woven by Toyota | 動画理解・都市/モビリティ特化・8B軽量 | 都市カメラ・車載映像・長尺動画の実運用 |

GPT-image-2 系 | OpenAI | 画像生成・画像理解の汎用性 | 汎用コンテンツ生成が中心 |

Gemini 3.1 Pro | ロングコンテキスト・Googleエコシステム統合 | ドキュメント×動画の汎用マルチモーダル | |

Qwen 3.5-Omni | Alibaba | 多言語・音声/動画統合の汎用オープン | 汎用研究開発・多言語用途 |

Tencent Hunyuan 3.0 | Tencent | 大規模マルチモーダル・中国語圏向け | 中国語圏コンテンツ活用 |

InternVL系 | OpenGVLab | 研究用途のオープンVLM | ベンチマーク比較・研究開発 |

※他社モデルのスペック・ベンチマーク値は各社の発表・MVBench公式リーダーボードで最新値を確認してください。

用途別の選び方

- 都市・交通・工場・店舗など「現場カメラの動画を常時解析する」用途 → WAVEが最有力

- 汎用的な文書×動画×画像のハイブリッド質問応答 → Gemini 3.1 Pro/GPT系

- 研究用途・オープンモデルで自前チューニング → Qwen系/InternVL系

- 中国語圏コンテンツ特化 → Tencent Hunyuan 3.0

WAVEは「街・車・人の挙動を言語化する」というユースケースに最適化されており、汎用チャット用途で使うのは過剰です。逆にこの領域では、汎用VLMでは精度・レイテンシ・コストの三角形を解き切れません。

WAVEが向いている企業/向いていない企業

WAVEは強力ですが、すべての企業に合うわけではありません。2026年4月時点の情報をもとに判断基準を整理します。

こんな企業におすすめ

- モビリティ・自動車・交通インフラ事業者:車両・信号・街頭カメラのデータ統合運用を検討している

- 製造業・物流倉庫:作業者安全・工程異常・設備監視をカメラで自動化したい

- 大規模小売・飲食チェーン:店舗内行動を解析し、体験設計・オペレーション改善に活かしたい

- スマートシティ/自治体PoC:プライバシー配慮と倫理重視の設計を求める実証プロジェクト

- AWSエコシステム内で完結させたい企業:SageMakerでのデプロイ運用に慣れている

- 「長尺動画の自動要約・検索」が業務に直結する企業:監視・会議録画・工程記録

こんな企業にはおすすめしない

- 画像生成やテキストチャットが主目的の企業 → GPT系/Gemini系で十分

- オンプレミスでのモデル運用が必須の企業 → 現時点ではAWS経由のマネージド提供が基本

- 日本語応答品質が最優先で、一切の検証コストを掛けたくない企業 → 個別検証が前提

- 本番SLAが確定していないと導入できない企業 → アルファ版である点を要確認

- 小規模PoCで月数万円以下のコストに抑えたい企業 → インフラ込みで一定の実証予算が必要

よくある質問(FAQ)

Q1. WAVEはいつから使えますか?

2026年4月22日の発表と同時に、AWS Marketplace(Amazon SageMaker)で v1.0.5-alphaとして一般提供が始まっています。Woven City内の実証は同日より本格稼働しています。

Q2. WAVEと自動運転は関係ありますか?

直接の関係はありますが、WAVE単体が自動運転を実現するわけではありません。WAVEは「映像→言語」で状況を解釈する基盤モデルで、Woven City Integrated ANZEN System全体(Behavior AI/Drive Sync Assist)と組み合わせて運転支援・事故予防に使われます。位置付けは「人を補完するAI」であり、完全自動運転の代替ではありません。

Q3. 日本語で使えますか?

現時点では、公式から明確な日本語対応水準の記載はありません。MVBenchは英語中心のベンチマークのため、日本語プロンプトや日本語応答の精度は個別検証が推奨されます。

Q4. なぜ8Bという小さいモデルなのですか?

街中・車両・店舗などに常時稼働で多拠点展開するには、モデルの軽さが運用コスト・レイテンシ・電力消費に直結するためです。独自の2段階階層的圧縮により、8Bでも大型VLMに匹敵する動画理解精度を実現している点がWAVEの最大の強みです。

Q5. オンプレ導入はできますか?

現時点ではAWS Marketplace(SageMaker)経由のマネージド提供が基本で、オンプレ版やモデルウェイトのダウンロード提供は未確認です。今後の展開はWoven by Toyotaの公式情報を継続的に確認してください。

Q6. MVBench 73.81%はどれくらいすごいのですか?

一般論として、このスコア帯を狙う動画VLMは30B〜70Bクラスの大型モデルが主流です。8Bという軽量サイズでトップ層に並ぶのは稀で、「推論コストを抑えながら高精度を出したい」という実務要件に直結する数値です。なお、他社モデルの最新スコアはMVBench公式リーダーボードで変動するため、比較は必ず最新値で行ってください。

Q7. プライバシー面は大丈夫ですか?

Woven by Toyotaは「人中心・倫理重視」を公式方針として打ち出していますが、実際の運用では導入企業側の責任で、個人情報保護法・自治体条例・社内規定に沿った設計(事前告知・保管期間・アクセス制御・監査証跡)を整備する必要があります。

まとめ|WAVEは「街の目」を担う軽量VLMの新標準候補

- Woven AI Vision Engine(WAVE)は、トヨタ×Woven by Toyotaが2026年4月22日に発表したマルチモーダル基盤モデル

- 8BパラメータでMVBench 73.81%という世界最高水準を達成し、軽量×高精度を両立

- 独自の2段階階層的圧縮で、長時間動画理解と低レイテンシを両立

- AWS Marketplace(SageMaker)で $5〜$8/時間のソフトウェア料金で試せる(v1.0.5-alpha)

- Woven City Integrated ANZEN System(Behavior AI/Drive Sync Assist)の中核エンジン

- モビリティ・製造・小売・スマートシティ用途に最適化されており、汎用チャット用途向けではない

- 現時点ではアルファ版+AWSマネージド提供が前提のため、本番投入には自社検証が必要

動画理解AIの競争はグローバルで激化していますが、「都市と現場で常時使える軽量VLM」というポジショニングでWAVEは独自の立ち位置を築こうとしています。今後v1.0系の正式リリース・オンプレ対応・他地域展開がどう進むかは継続ウォッチすべきテーマです。

関連記事

- AIエージェントとは|基本から仕組み・活用事例まで解説

- 生成AIツールおすすめ比較

- AI検索エンジン 比較

- Gemini 3.1 Proとは|機能・料金・使い方

- Qwen 3.5-Omni とは

- Tencent Hunyuan 3.0 とは

- 自動車業界のAI活用事例

- 生成AI セキュリティ リスク

参考ソース

- Woven by Toyota 公式プレスリリース: https://woven.toyota/en/news/20260422/

- トヨタ自動車グローバルニュースルーム: https://global.toyota/jp/newsroom/corporate/44256133.html

- AWS Marketplace(WAVE製品ページ): https://aws.amazon.com/marketplace/pp/prodview-olxu67q4v47ym

- MVBench公式リーダーボード(OpenGVLab): https://huggingface.co/spaces/OpenGVLab/MVBench_Leaderboard

- Automotive World: https://www.automotiveworld.com/news/toyota-unveils-ai-vision-engine-for-woven-city/

- UCC公式(上島珈琲店 Woven City店): https://www.ucc.co.jp/company/news/2025/rel250925.html

この記事の著者

AI革命

編集部

AI革命株式会社の編集部です。最新のAI技術動向から実践的な導入事例まで、企業のデジタル変革に役立つ情報をお届けしています。豊富な経験と専門知識を活かし、読者の皆様にとって価値のあるコンテンツを制作しています。

最新記事

Prime Intellect Labとは?セルフ改善AIエージェントを訓練するフルスタックプラットフォームの機能・料金・使い方を完全解説

2026/05/28

ChatGPT料金【日本円換算】2026年最新|全プラン比較・選び方

2026/03/31

AIエージェントフレームワーク比較12選【2026年最新】LangChain・CrewAI・Dify

2026/04/02

Claude料金【日本円】2026年最新|Free/Pro/Max/Team全プラン比較

2026/03/26

税務AI活用【2026年最新】AI-OCR自動仕訳・JDL評判・freee連携

2026/04/23

Grokとは?Agent Mode使い方・料金・ChatGPTとの比較【2026年最新】

2026/04/18