TPU v8 Sunfish/Zebrafishとは?Broadcom・MediaTek分業のNvidia対抗・第8世代Google TPUを徹底解説

この記事のポイント

GoogleがCloud Next '26で発表した第8世代TPU「Sunfish(TPU 8t)」「Zebrafish(TPU 8i)」を、スペック・Ironwood比較・Nvidia対抗・Broadcom/MediaTek分業の意味まで一次情報ベースで整理。導入判断に必要な情報を1ページで網羅します。

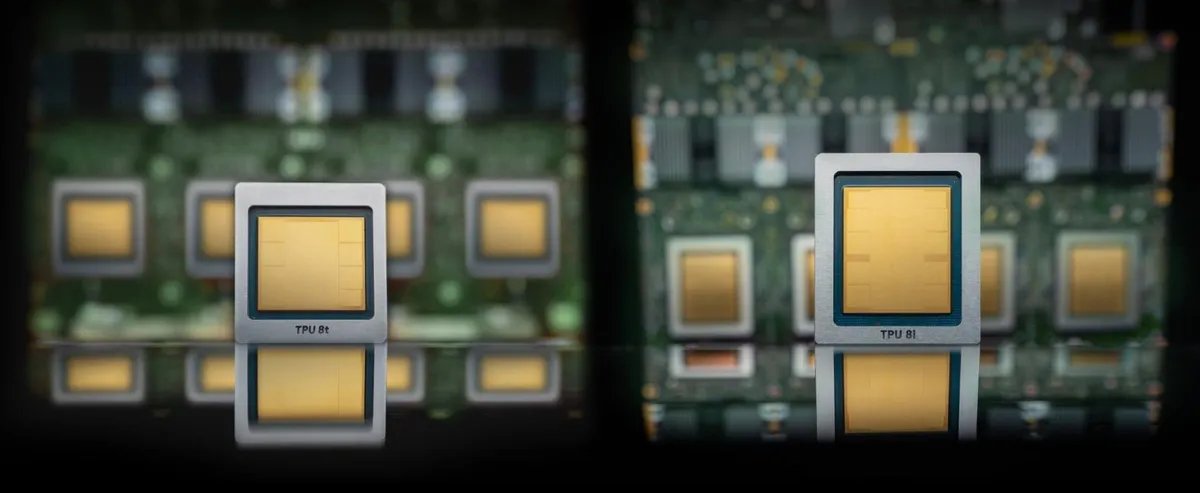

TPU v8(Sunfish/Zebrafish)は、Googleが2026年4月22日のCloud Next '26で発表した第8世代TPUで、TPUの歴史で初めて学習用(TPU 8t = Sunfish)と推論用(TPU 8i = Zebrafish)にチップを分離した独自AIアクセラレータです。 学習向けはBroadcomと、推論向けはMediaTekとの共同設計に踏み込み、ピーク演算性能ではNvidia最新GPUに見劣りするものの、9,600チップ規模のスーパーポッドとAI Hypercomputerによる「総コスト(TCO)と電力効率での勝負」に舵を切ったのが本世代の特徴です。

この記事でわかること:

- TPU 8t(Sunfish)/TPU 8i(Zebrafish)の正体とコードネームの整理

- 第7世代Ironwoodとの違いと、世代ごとに何が改善したか

- Nvidia Vera Rubin/AMD MI455Xとの性能・コスト比較の見方

- BroadcomとMediaTekに分業した理由とサプライチェーンの意図

- 日本企業がGoogle Cloud経由で利用する場合の判断材料

こんな方におすすめの記事です:

- AI基盤の選定担当者・クラウドコスト最適化を進めるエンジニア

- 自社のLLM学習・推論をGPUからTPUへ移行する判断材料を探している方

- 半導体・AIインフラ業界のサプライチェーンや投資動向を整理したい方

TPU v8(第8世代TPU)の結論サマリー

第8世代TPUは「ひとつのチップで全部やる」設計を捨て、学習と推論をそれぞれ専用チップに分離した点が最大の特徴です。読者がまず押さえるべき要点は次の3つです。

- TPU 8t(コードネーム Sunfish) — 大規模モデル学習向け。Broadcomと共同設計。9,600チップで121 ExaFLOPS(FP4)のスーパーポッドを構成。Ironwood比で学習コストパフォーマンスを2.7倍に。

- TPU 8i(コードネーム Zebrafish) — 推論・エージェント向け。MediaTekと共同設計。HBMを288GBまで増量し、Boardflyトポロジで集約通信レイテンシを最大1/5に。Ironwood比で推論コストパフォーマンスを80%向上。

- 共通技術 — ホストCPUは独自Arm「Axion」、第4世代液冷、JAX/PyTorch(プレビュー)/vLLM/SGLangに対応。2026年後半(H2)に一般提供開始予定。

区分 | 公式名 | コードネーム | 用途 | 設計パートナー |

|---|---|---|---|---|

第8世代TPU 学習用 | TPU 8t | Sunfish | LLM学習・大規模事前学習 | Broadcom |

第8世代TPU 推論用 | TPU 8i | Zebrafish | 推論・AIエージェント | MediaTek |

Google公式の呼称は「TPU 8t」「TPU 8i」です。「Sunfish」「Zebrafish」は社内コードネームで、SemiAnalysisなど一部メディアでは「TPU v8AX/TPU v8X」と表記される場合もあります。本記事では公式名を優先しつつ、検索性のためコードネームを併記します。

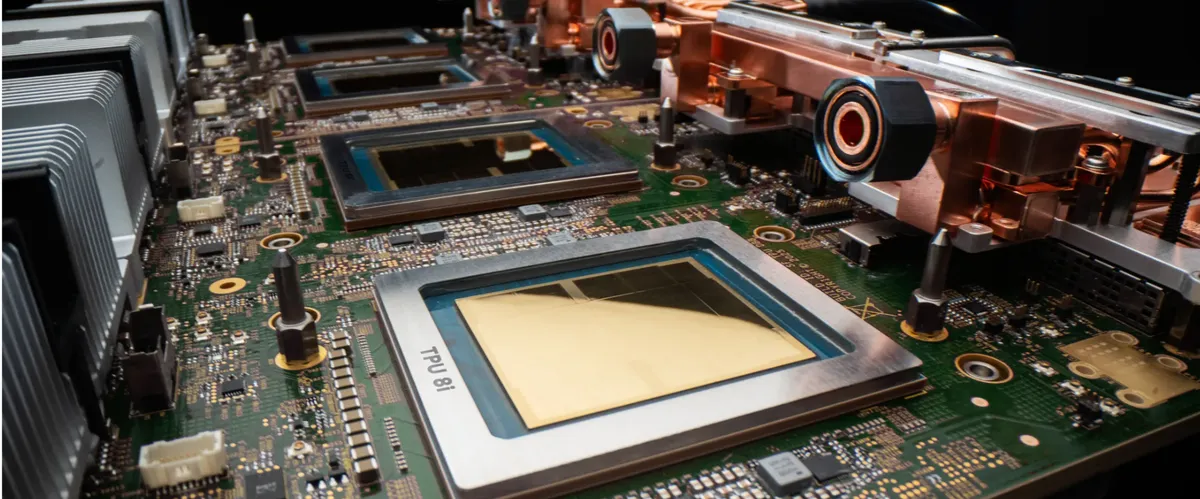

TPU 8t(Sunfish)の特徴と主要スペック

TPU 8tは、大規模言語モデル(LLM)の事前学習・継続学習に最適化された学習専用チップです。Googleが「学習を専用設計のチップで担う」と明言したのは第8世代が初めてで、SparseCoreや新搭載のLLM Decoder Engineにより、Prefill/Decodeのオーバーラップやスパース演算を直接ハードウェアで支援します。

出典: Google Blog

TPU 8t(Sunfish)主要スペック

項目 | 値 |

|---|---|

ピーク演算性能(FP4) | 12.6 PFLOPS/チップ |

HBMメモリ容量 | 216 GB(HBM3e、12-high × 8スタック) |

HBM帯域 | 6,528 GB/s |

オンチップSRAM(Vmem) | 128 MB |

スーパーポッド規模 | 9,600チップ |

ポッド全体FP4性能 | 121 ExaFLOPS |

ポッド共有HBM | 2 PB |

スケールアップ帯域 | 19.2 Tb/s/チップ(Ironwood比2倍) |

スケールアウト(DCN) | 400 Gb/s/チップ(Ironwood比4倍) |

トポロジ | 3D torus |

専用機能 | SparseCore + LLM Decoder Engine |

設計パートナー | Broadcom |

TPU 8tの強み

- Virgo Networkにより、単一データセンター内で134,000チップ、複数サイトでは100万チップ超までほぼリニアにスケールできる。

- TPUDirect Storage + Managed Lustre 10Tで、ストレージアクセスがIronwood比10倍高速。学習ジョブのI/Oボトルネックを大幅に縮小。

- 有効稼働時間(Goodput)は97%超を公式が公表。長期間の事前学習で計算リソースの無駄が出にくい。

公式試算では、Ironwood(TPU v7)と比較して学習のコストパフォーマンスは2.7倍とされています。前世代も既にGB200サーバー比でTCO約44%減と報告されていたため、TPU 8tはコスト面でNvidia系GPUへのプレッシャーをさらに強めるポジションです。

TPU 8i(Zebrafish)の特徴と主要スペック

TPU 8iは、推論・AIエージェントワークロード向けに新規設計された専用チップです。学習向けほどの計算ピークは追わず、その代わりに「メモリ容量・通信レイテンシ・自己回帰デコード性能」を徹底的に最適化しています。

TPU 8i(Zebrafish)主要スペック

項目 | 値 |

|---|---|

ピーク演算性能(FP4) | 10.1 PFLOPS/チップ |

HBMメモリ容量 | 288 GB(HBM3e、6スタック) |

HBM帯域 | 8,601 GB/s(〜8.6 TB/s) |

オンチップSRAM(Vmem) | 384 MB(前世代比3倍) |

ポッド規模 | 1,024 active chips / 最大1,152チップ |

ポッドFP8性能 | 11.6 ExaFLOPS/ポッド |

ポッド総HBM | 331.8 TB |

スケールアップ帯域 | 19.2 Tb/s/チップ |

トポロジ | Boardfly(最大7ホップ) |

専用機能 | Collectives Acceleration Engine(CAE) |

設計パートナー | MediaTek |

TPU 8iの強み

- 288GBのHBM3eと384MBのオンチップSRAMにより、長文コンテキストや大規模KVキャッシュをチップ内に保持しやすく、外部メモリアクセスを大幅に削減できる。

- Boardflyトポロジは3D torus(最大16ホップ)からネットワーク直径を56%削減し、最大7ホップに短縮。All-to-All通信レイテンシは50%改善。

- Collectives Acceleration Engine(CAE)は集約通信の処理をオンチップで実行し、レイテンシを最大1/5に。自己回帰デコードのトークン生成を高速化する。

公式は「同コストでIronwoodの約2倍の推論リクエストを処理できる」と説明しており、推論のコストパフォーマンスはIronwood比80%向上と発表されています。エージェント時代に求められる「低レイテンシ・大量並列・長文コンテキスト」の3要件を、ハードウェア側から押さえに来た設計です。

TPU 8t vs TPU 8i 一目でわかる比較表

「結局どちらをいつ使うか」の判断材料として、TPU 8tとTPU 8iの主要項目を横並びで整理しました。

項目 | TPU 8t(Sunfish) | TPU 8i(Zebrafish) |

|---|---|---|

主用途 | 大規模モデル学習 | 推論・AIエージェント |

ピーク性能(FP4) | 12.6 PFLOPS | 10.1 PFLOPS |

HBM容量 | 216 GB | 288 GB |

HBM帯域 | 6,528 GB/s | 8,601 GB/s |

オンチップSRAM | 128 MB | 384 MB |

ポッド規模 | 9,600チップ | 1,024〜1,152チップ |

ネットワークトポロジ | 3D torus | Boardfly(最大7ホップ) |

専用機能 | SparseCore+LLM Decoder Engine | Collectives Acceleration Engine(CAE) |

設計パートナー | Broadcom | MediaTek |

Ironwood比コスト性能 | 学習で2.7倍 | 推論で1.8倍(80%向上) |

学習ワークロードはチップ数とインターコネクト帯域で殴る設計、推論はメモリ量と集約通信遅延で稼ぐ設計、と役割が明確に分かれています。

Ironwood(TPU v7)との違いと進化ポイント

第8世代の進化を理解するうえで欠かせないのが、第7世代Ironwoodとの差分です。Ironwoodはまだ「学習・推論兼用」の万能型チップであり、TPU 8t/8iはそこから明確に役割分担した設計に変わりました。

観点 | Ironwood(TPU v7) | TPU 8t/8i(第8世代) |

|---|---|---|

設計思想 | 学習・推論兼用 | 学習用と推論用に分離 |

設計パートナー | Broadcom(単独) | Broadcom(学習)+MediaTek(推論) |

1ワットあたり性能 | ベースライン | 2倍 |

スケールアップ帯域 | ベースライン | 2倍 |

スケールアウト帯域 | ベースライン | 4倍(学習用) |

ストレージアクセス | ベースライン | 10倍(TPUDirect Storage + Managed Lustre 10T) |

推論ネットワーク直径 | 3D torus 16ホップ | Boardfly 最大7ホップ(56%削減) |

5年前と比較して単位電力あたりの計算量は6倍になっており、AIインフラの電力制約が世界的な課題になる中で、電力効率の進化幅がIronwood→TPU v8で一段と大きくなった点も特筆すべきです。

なぜBroadcomとMediaTekに分業したのか

第8世代で最も注目されているのが、学習用をBroadcom、推論用をMediaTekに分けた共同設計体制です。これは単なるエンジニアリング上の都合ではなく、サプライチェーン戦略上の意思決定が含まれています。

分業の3つの狙い

- ベンダーロックイン回避 — Broadcom一社依存の状態から脱却し、調達リスクを分散。

- コスト最適化 — Bank of AmericaのVivek Arya氏の試算では、デュアルソーシングによりBroadcom単独調達比でチップ単価を最大30%削減できる可能性。

- 専門性の最適配分 — Broadcomは大規模シリコン・先端パッケージングに、MediaTekはモバイル領域で培った電力効率・量産設計に強い。

サプライチェーン全体像

報道ベースでは、第8世代のサプライチェーンには次のプレイヤーが関与しています。

- Broadcom — TPU 8t(Sunfish)の共同設計、製造プロセス・パッケージングの主要工程

- MediaTek — TPU 8i(Zebrafish)の共同設計、Marvellも将来世代でMediaTekと組む報道あり

- TSMC — チップ製造(プロセスノードはGoogle公式未公表。Tom's HardwareなどはN3ファミリと報じる一方、SemiAnalysisはSunfish/ZebrafishのTSMC 2nm版を2027年後半にターゲットと報道)

- Intel Foundry — 将来TPU向けのEMIBアドバンスドパッケージング供給に関与すると報じられる

プロセスノードの2nm/N3問題は、2026年提供分が現行版(N3ファミリ)で、SemiAnalysisが言及する「2nm late 2027版」は次イテレーションだとする解釈と、現行発表版そのものを指すとする解釈の両方が混在しています。Google公式が明示するまでは「未確認」の扱いが妥当です。

Nvidia Vera Rubin・AMD MI455Xとの比較

「Nvidia対抗チップ」と報道されることの多いTPU v8ですが、個別チップの性能で見ると依然としてGPU勢のほうがピーク値は高い点には注意が必要です。

項目 | TPU 8t(Sunfish) | Nvidia Vera Rubin | AMD MI455X |

|---|---|---|---|

ピーク性能(FP4) | 12.6 PFLOPS | 約35 PFLOPS | 約40 PFLOPS |

HBM容量/チップ | 216 GB | 〜288 GB相当 | 大容量HBM搭載 |

提供形態 | Google Cloudのみ | OEM・各クラウド | OEM・各クラウド |

ポッド/クラスタ規模 | 9,600チップ/ポッド・100万超/マルチサイト | NVL系で数百〜数千 | 数千規模 |

エコシステム | JAX中心、PyTorchはプレビュー | CUDA(最強の互換性) | ROCm |

Googleはこの約3対1のチップ性能差を、ポッド単位での9,600チップ+Virgo Networkによるスケール優位で補う設計思想です。AI News Hubの早期ベンチマーク報道では「推論に限ればTPUがGPU比で2〜3倍のコスト優位」とされ、TPU 8iは同コストでIronwoodの約2倍のリクエストを処理できると公式が明言しています。

つまり「個別チップ性能=GPU優位、ポッド・TCO=TPU優位」という構図であり、ワークロードによって適切な選択肢が変わるのが現実的な見方です。

AI Hypercomputerと周辺技術

TPU v8単体では真価が出ません。Google Cloudの「AI Hypercomputer」というスタック全体で利用するのが前提です。主要構成要素を整理すると次のとおりです。

レイヤ | 技術 | 役割 |

|---|---|---|

ホストCPU | Axion(Arm独自設計) | TPUのホスト側演算・前処理 |

冷却 | 第4世代液冷 | 高密度ポッドの熱処理 |

学習ネットワーク | Virgo Network | 単一DC134,000・マルチサイト100万超チップへのスケール |

推論ネットワーク | Boardfly | All-to-Allレイテンシ50%削減 |

ストレージ | TPUDirect Storage + Managed Lustre 10T | ホストCPUバイパス、Ironwood比10倍 |

通信高速化 | TPUDirect RDMA / CAE | 集約通信を最大1/5に |

ソフトウェア | JAX / PyTorch(プレビュー)/ Keras / vLLM / SGLang | フレームワーク互換性 |

開発ツール | Pallas / Mosaic / XLA / Pathways | カーネル開発・分散学習 |

PyTorch対応はまだプレビュー段階で、CUDAエコシステムの成熟度には及びません。「JAXまたはvLLM/SGLangを軸に組める組織」の方が、TPU v8の恩恵を受けやすいのが実情です。

提供時期・利用方法・料金の現状

第8世代TPUの提供スケジュールと利用方法は、現時点で「2026年後半(H2)に一般提供開始」のみ公式アナウンス済みで、個別チップ単価などは未公表です。

提供形態

- Google Cloud上でのみ利用可能。オンプレミスや第三者クラウド経由での提供は予定されていません(TPUは伝統的にGoogle専用)。

- 利用関心はGoogle Cloud公式の「Submit an interest form for eighth-generation TPUs」から事前登録できます。

料金(現時点で判明している範囲)

項目 | 状況 |

|---|---|

個別チップ時間単価 | 未公表 |

コミット利用ディスカウント(CUD) | 未公表。Ironwoodと同様の枠組みで提供される見込み |

Dynamic Workload Scheduler対応 | 提供される見込み |

東京リージョン提供時期 | 未公表 |

マルチテナント/専有利用 | 未公表 |

前世代Ironwoodは時間課金で提供中であり、TPU v8もAI Hypercomputer経由で「オンデマンド/CUD/DWS」の3形態が中心になると見られます。詳細価格はGoogle Cloud TPU料金ページで随時公開予定です。

顧客事例:Anthropic・Meta・Apple・Citadel

第8世代TPUの大規模需要は、すでにフラッグシップ顧客との長期契約として可視化されています。

- Anthropic(Claude開発元) — 2026年4月にGoogleとBroadcomとの提携を拡大し、2027年以降3.5GW分のTPU容量を確保。さらに同月、Googleは最大400億ドルをAnthropicに投資し、5GW相当のTPU容量を割り当てる契約を発表。Claudeの主要学習・推論プラットフォームとしてTPU採用を拡大しています。

- Meta — 2026年2月に複数年・数十億ドル規模のTPU契約を締結。2027年までに50万〜80万チップ規模と推定。

- Apple — Gemini搭載SiriのワークロードをTPU上で運用、年間約10億ドル規模の契約。

- Citadel Securities — 金融分野のAIワークロードに採用(Google公式事例)。

これらの動きは、「Nvidia GPUを補完/代替する大規模AIインフラとしてTPUが選ばれ始めた」というシグナルです。

TPU v8 が向いている企業・向いていない企業

こんな企業・チームにおすすめです

- Google Cloudをすでに主要クラウドとして使っている組織。AI Hypercomputerの恩恵を素直に受けられる。

- JAXまたはvLLM/SGLangで学習・推論パイプラインを組めるチーム。

- 数十億〜数千億パラメータ規模のLLMを自社で学習・継続学習したい企業。スーパーポッドのスケール優位が活きる。

- 長文コンテキスト・エージェント型推論を低レイテンシで大量に捌きたいサービス。TPU 8iの大HBM+Boardfly設計と相性が良い。

- 電力コスト・ラックスペース制約を強く意識しているデータセンター運用者。1ワットあたり性能のIronwood比2倍が効く。

- TCO重視でNvidia GPUクラスタからの切り替え・併用を検討している企業。

おすすめしない・慎重に検討したいケース

- オンプレミスや特定地域のソブリンクラウドで運用したいユースケース。TPUはGoogle Cloud専用。

- CUDA固有のライブラリ・カーネル(カスタムCUDAカーネル、特定のNvidia最適化フレームワーク)に深く依存している既存資産。

- 小規模推論のみで、CPU・1〜数GPUで十分まかなえる規模感のサービス。スケール優位が活きにくい。

- PyTorch本番運用が前提で移行コストを取れないチーム。PyTorch対応はプレビュー段階であり、JAXへの移植やvLLM/SGLang運用に踏み切れる体制が必要。

- マルチクラウド・冗長性確保が経営上の必須要件で、AIワークロードを単一クラウドに寄せられない場合。

よくある質問(FAQ)

Q1. 「Sunfish」「Zebrafish」と「TPU 8t」「TPU 8i」は同じものですか?

はい、同じです。 Sunfish=TPU 8t(学習用)、Zebrafish=TPU 8i(推論用)の関係で、Sunfish/Zebrafishは社内コードネーム、TPU 8t/8iがGoogle公式名称です。SemiAnalysisなど一部の海外メディアは「TPU v8AX/TPU v8X」という別表記を使う場合もあります。

Q2. 個別チップだけ見るとNvidia GPUに負けているのに、なぜ「対抗」と言われるのですか?

ポッド単位のスケール、TCO、電力効率で勝負しているためです。 ピークFP4性能はNvidia Vera Rubin(35 PFLOPS)やAMD MI455X(40 PFLOPS)が上ですが、TPU 8tは9,600チップを単一ポッドにまとめ、Virgo Networkで100万チップ超までスケールできる点と、Ironwood世代でGB200比TCO約44%減と報告されている経済性で差別化しています。

Q3. 一般提供はいつから始まりますか?

2026年後半(H2)に一般提供開始予定とGoogleが公式発表しています。具体的な日付は未公表で、利用関心はGoogle Cloudのインタレストフォームから事前登録が可能です。

Q4. 個別の時間単価はいくらですか?

現時点で公式単価は未公表です。前世代Ironwoodと同様にAI Hypercomputer経由で「オンデマンド/コミット利用ディスカウント/Dynamic Workload Scheduler」の形で提供される見込みで、東京リージョンでの提供時期も未公表です。

Q5. TSMCのプロセスノードは2nmですか、N3ですか?

Google公式は明示していません。 Tom's HardwareなどはN3ファミリと報じる一方、SemiAnalysisは「Sunfish/ZebrafishのTSMC 2nm版を2027年後半にターゲット」としており、これが現行2026年版なのか次イテレーションなのかは公式確認が出るまで両論併記が妥当です。

Q6. PyTorchで使えますか?

プレビュー段階で対応しています。本番運用に振り切る場合はJAXまたはvLLM/SGLangを推奨。Google公式はJAX/PyTorch(プレビュー)/Keras/vLLM/SGLangを正式サポート対象と明示しています。

Q7. TPU v8のセキュリティはどうなっていますか?

Google CloudのISO 27001、SOC 1/2/3、HIPAA、PCI DSS、FedRAMPなどのコンプライアンス基準下で提供されます。ベアメタルアクセスにより仮想化オーバーヘッドを排除し、TPU 8iは推論時のKVキャッシュをオンチップSRAM 384MBに保持できる点が新しい特徴です。データ漏洩・モデル流出に関する特異な公式リスク開示は現時点でありません。

まとめ:第8世代TPUは「AIインフラの分業化時代」の象徴

TPU v8(Sunfish/Zebrafish)の本質は、単なる性能向上ではなく「AIインフラの設計思想がスケール一辺倒から役割分担型に変わった」という構造変化にあります。

要点を整理すると以下の3点です。

- 学習はTPU 8t(Sunfish/Broadcom共同設計)、推論はTPU 8i(Zebrafish/MediaTek共同設計)に明確分離。 兼用設計の限界を超え、推論専用機の特性が一段と引き出された。

- Nvidia GPUとの個別チップ性能差はポッドスケールとTCOで補う設計思想。 9,600チップポッド/100万超マルチサイト/1W性能2倍が武器。

- Anthropic・Meta・Apple・Citadelなどフラッグシップ顧客が長期契約済みで、需要は既に確定している。 Google Cloudを軸にAIインフラを組み立てる企業にとって、TPU v8は今後数年の重要な選択肢となる。

JAXまたはvLLM/SGLangで開発体制を組める組織、Google Cloudに既に投資している組織にとっては、Ironwoodからの自然な乗り換え対象として強力なオプションです。一方、CUDA資産が深い既存PyTorch本番運用や、オンプレ/マルチクラウド要件が厳しい組織は、移行コストとロックイン度を慎重に見極めましょう。

関連記事

- 生成AIの全体像から押さえたい方は「生成AIとは」「AIエージェントとは」をあわせてご覧ください。

- TPU v8で学習・運用される代表的なモデルは「Geminiとは」「Claudeとは」「Claude 5 とは」で整理しています。

- AIインフラ・大手プレイヤー動向は「Anthropic × NEC 戦略的提携」「Anthropic Project Dealとは」が参考になります。

- AIエージェント基盤を比較検討する場合は「AIエージェント フレームワーク 比較」「Gemini Enterprise Agent Platformとは」もチェックしてください。

- 自社にどの生成AIを導入すべきか整理したい方は「生成AIツールおすすめ比較」「AI検索エンジン 比較」をどうぞ。

主要参考ソース(一次情報)

- Our eighth generation TPUs: two chips for the agentic era — Google Blog

- 第8世代 TPU:エージェンティック時代に向けた 2 つのチップ — Google Cloud Blog (日本語)

- TPU 8t and TPU 8i technical deep dive — Google Cloud Blog

- AI infrastructure at Next '26 — Google Cloud Blog

- Anthropic expands partnership with Google and Broadcom — Anthropic

- With TPU 8, Google Makes GenAI Systems Much Better, Not Just Bigger — The Next Platform

- Inside Google's TPU V8 strategy — Tom's Hardware

この記事の著者

AI革命

編集部

AI革命株式会社の編集部です。最新のAI技術動向から実践的な導入事例まで、企業のデジタル変革に役立つ情報をお届けしています。豊富な経験と専門知識を活かし、読者の皆様にとって価値のあるコンテンツを制作しています。

最新記事

Ineffable Intelligenceとは?David Silver創業・$1.1Bシード・$5.1B評価額・欧州史上最大ラウンドを徹底解説

2026/04/27

Qwen3.6-Max-Previewとは?Alibaba最強フラッグシップ・SWE-bench Pro 1位の全貌を徹底解説

2026/04/27

OpenAI Codex Labs とは|Accenture・PwC・Cognizant・CGI・Infosys・TCS・Capgemini 7大コンサル提携エンタープライズ導入ガイド

2026/04/27

日本AI基盤モデル開発とは?SoftBank・NEC・Honda・Sony 1兆パラメータ物理AIを徹底解説

2026/04/27

Google Workspace Intelligence とは|Drive Projects・Sheets 9倍高速・AI Overviews GAを徹底解説

2026/04/27

Gmail AI Overviewsとは?Workspace Business/Enterprise向けGemini 3メール要約機能を徹底解説

2026/04/27