MCPとは?仕組み・できること・対応ツール・セキュリティを総合解説【2026年版】

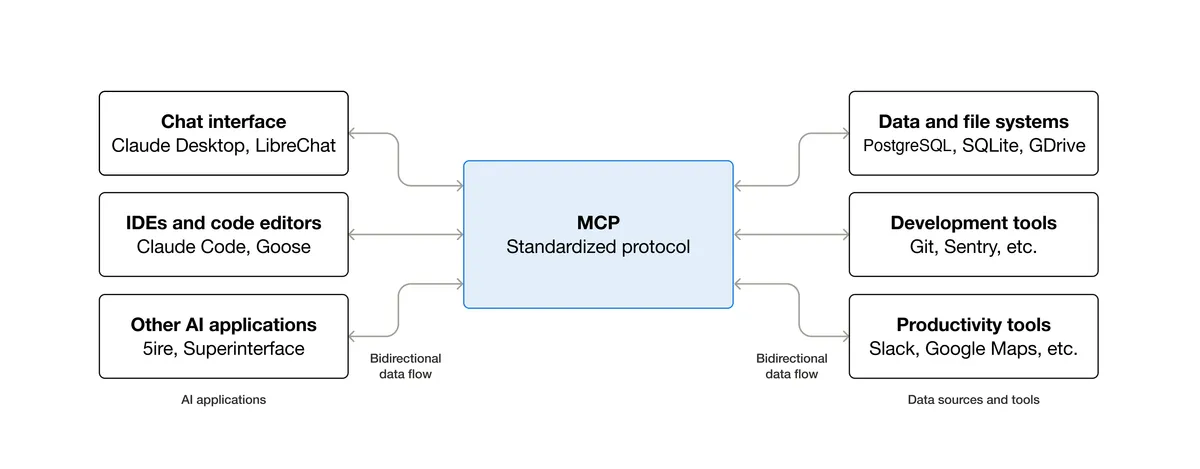

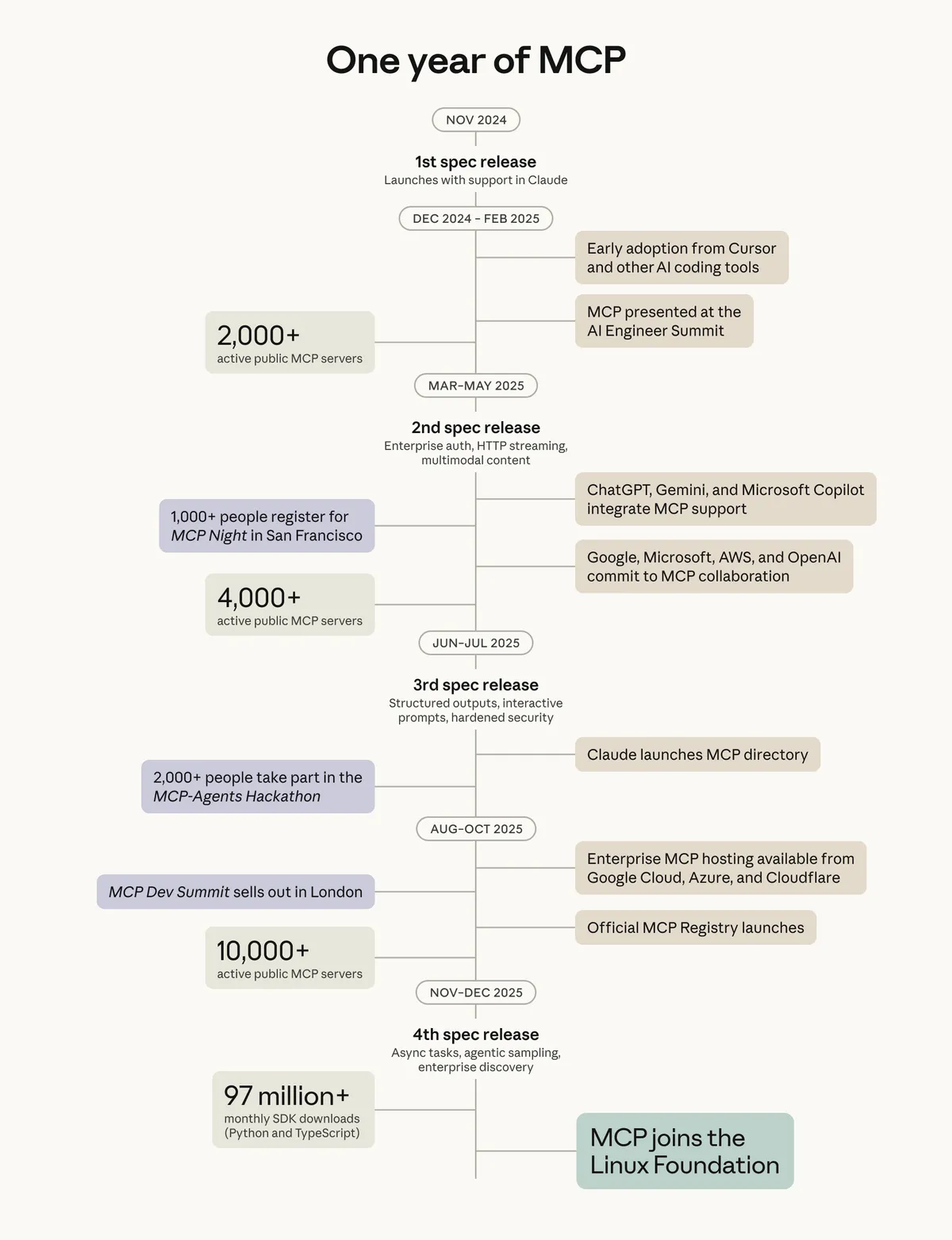

MCP(Model Context Protocol)は、AIアプリケーションと外部のデータソースやツールを標準的な方法で接続するオープンソースプロトコルです。 2024年11月にAnthropicが発表し、2025年12月にLinux Foundation傘下のAgentic AI Foundation(AAIF)へ寄贈されました。現在はOpenAI・Google・Microsoftを含む主要AIベンダーが採用し、月間9,700万以上のSDKダウンロードを記録する業界標準となっています。

この記事では、以下の内容を整理しています。

- MCPの定義と、なぜ必要とされているのか

- 3層アーキテクチャと通信の仕組み

- MCPでできることと具体的な活用事例

- 対応AIツール(Claude・ChatGPT・Cursor等)の比較

- RAG・Function Calling・A2Aプロトコルとの違い

- セキュリティリスクと安全な利用方法

- 利用者タイプ別の始め方

対象読者: 「MCPって何?」と疑問に思った方、AIツールの外部連携に関心のあるエンジニア・ビジネス担当者・個人ユーザーの方。技術的な予備知識がなくても理解できる構成にしています。

MCPとは — AIと外部ツールをつなぐオープン標準プロトコル

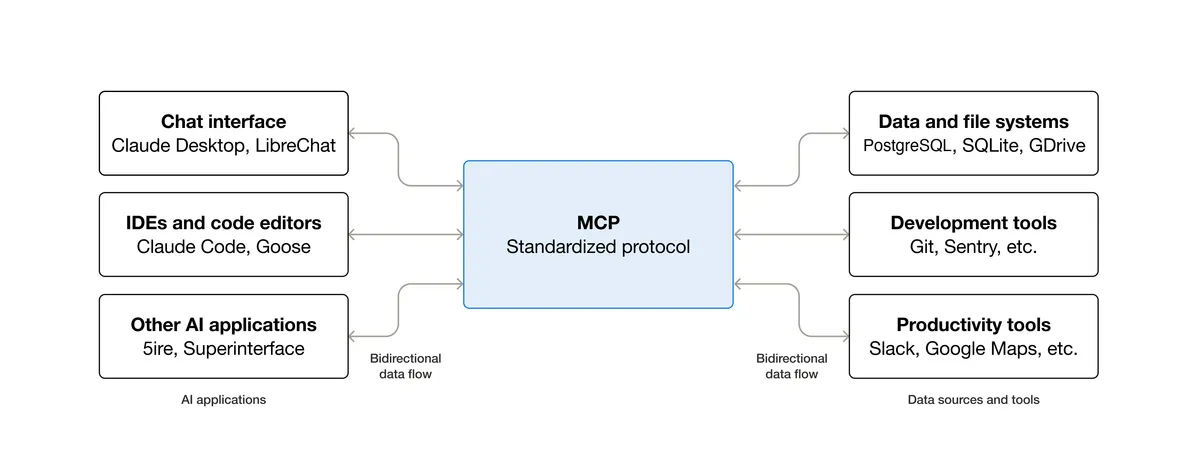

MCP(Model Context Protocol)は、AIアプリケーションが外部のデータやツールにアクセスするための「共通規格」です。公式では「USB-Cポートのようなもの」と例えられています。USB-Cがスマートフォン・PC・周辺機器を1種類のケーブルで接続するように、MCPはAIアプリと外部システムを1つの標準プロトコルで接続します。

開発元とガバナンス

MCPの開発・管理の経緯は以下のとおりです。

項目 | 内容 |

|---|---|

発案・初期開発 | Anthropic(2024年11月発表) |

現在の管理 | Agentic AI Foundation(AAIF)— Linux Foundation傘下 |

共同設立者 | Anthropic、Block(旧Square)、OpenAI |

主な支援企業 | Google、Microsoft、AWS、Cloudflare、Bloomberg |

ライセンス | オープンソース(仕様・SDKともにGitHub上で公開) |

料金 | プロトコル自体は無料 |

2025年12月にAnthropicがMCPをAgentic AI Foundationに寄贈したことで、特定企業に依存しない中立的なガバナンス体制が確立されました。AIの主要4社(Anthropic・OpenAI・Google・Microsoft)すべてが採用または支援を表明しており、事実上の業界標準として機能しています。

MCPの規模感(2026年4月時点)

- SDKダウンロード数: 月間9,700万以上(Python/TypeScript合算)

- 公開MCPサーバー数: 10,000以上

- 公式コネクタ数(Claude): 75以上

- 日経クロステックの「2026年ブレイクスルー技術大賞」 に選出

MCPが解決する課題 — 従来のAPI連携の「N×M問題」

MCPが登場した最大の理由は、AIアプリケーションと外部ツールの接続における「N×M問題」を解消することです。

MCPなし(従来の方法)

従来、AIアプリケーションが外部サービスと連携するには、接続先ごとに個別の実装が必要でした。たとえば、3つのAIアプリ(Claude・ChatGPT・Cursor)がそれぞれ4つの外部ツール(GitHub・Slack・Notion・Google Drive)と連携しようとすると、3×4=12通りの個別実装が必要になります。

MCPあり(標準化された方法)

MCPを使えば、各AIアプリは「MCPクライアント」を1つ実装し、各外部ツール側は「MCPサーバー」を1つ実装するだけで済みます。3+4=7通りの実装で、すべての組み合わせがカバーできます。

これは、USB-C登場前にスマートフォンメーカーごとに充電端子が異なっていた状況と似ています。MCPは「AI連携のUSB-C」として、開発コストと複雑さを大幅に削減します。

MCPの仕組み — 3層アーキテクチャとプリミティブ

MCPの技術的な仕組みを、3つの参加者・2つのレイヤー・3つのプリミティブに分けて説明します。技術的な詳細に関心のない方は、次の「MCPでできること」セクションまで読み飛ばしても問題ありません。

3つの参加者(ホスト・クライアント・サーバー)

MCPはクライアント-サーバーモデルに基づき、以下の3者で構成されます。

参加者 | 役割 | 具体例 |

|---|---|---|

MCPホスト | AIアプリケーション本体。MCPクライアントを管理する | Claude Desktop、VS Code、Cursor |

MCPクライアント | ホスト内部で各MCPサーバーとの接続を維持するコンポーネント | ホスト内で自動的に生成される |

MCPサーバー | 外部データやツールをMCP経由で提供するプログラム | GitHub MCP Server、Slack MCP Server |

たとえば、Claude Desktopを使って「GitHubのイシュー一覧を取得して」と頼んだ場合、Claude Desktop(ホスト)が内部のMCPクライアントを通じてGitHub MCPサーバーに問い合わせ、結果をユーザーに返します。

2つのレイヤー(データ層・トランスポート層)

レイヤー | 役割 | 技術仕様 |

|---|---|---|

データ層 | メッセージの構造と意味を定義 | JSON-RPC 2.0ベースのプロトコル |

トランスポート層 | 通信経路と認証を管理 | stdio(ローカル)/ Streamable HTTP(リモート) |

stdioは同じマシン上のプロセス間通信に使い、低レイテンシで動作します。Streamable HTTPはリモートサーバーとの通信に使い、OAuth認証にも対応しています。

MCPサーバーが提供する3つのプリミティブ

MCPサーバーは、以下の3種類のデータをAIアプリケーションに提供できます。

プリミティブ | 役割 | 具体例 |

|---|---|---|

Tools(ツール) | AIが実行できる関数・操作 | ファイル作成、API呼び出し、DB検索、計算処理 |

Resources(リソース) | 参照用のデータ・コンテキスト | ファイル内容、DBレコード、APIレスポンス |

Prompts(プロンプト) | 再利用可能なテンプレート | システムプロンプト、ワークフロー定義 |

「Tools」はAIが外の世界に対してアクション(操作)を起こすための手段、「Resources」はAIが判断に必要なデータを取得する手段、「Prompts」はやりとりのテンプレートを共有する手段と理解するとわかりやすいでしょう。

ライフサイクル管理

MCP接続は以下の流れで進みます。

- 初期化 — クライアントとサーバーが対応機能(ケイパビリティ)を交換

- メッセージ交換 — ツール呼び出し・リソース取得・通知を実行

- 切断 — 接続を終了

初期化時に「このサーバーはToolsとResourcesを提供できる」「このクライアントはElicitation(ユーザーへの追加質問)に対応している」といった情報を交換することで、接続後のやりとりが効率化されます。

MCPでできること — 個人・開発者・企業の活用事例

MCPによってAIアプリケーションの活用範囲は大きく広がります。ここでは利用者のタイプ別に、具体的な活用事例を紹介します。

個人ユーザーの活用例

MCPの恩恵は、開発者でなくても受けられます。MCPに対応したAIアプリ(Claude Desktop、ChatGPTなど)を使っていれば、以下のようなことが可能です。

- Google CalendarとNotionを連携 — 「来週の予定を確認して、Notionのタスクリストと照合して」とAIに頼む

- ローカルファイルの操作 — 「デスクトップにあるCSVファイルを読み込んで分析して」と依頼

- 複数サービスを横断した情報整理 — メール・カレンダー・タスク管理を1つのAI会話で統合

開発者の活用例

- FigmaデザインからWebアプリを自動生成 — Claude CodeがFigma MCPサーバー経由でデザインを取得し、コードに変換

- GitHub・Slack・データベースとの連携 — コーディング中にIssue確認、Slack通知、DB操作をAIアシスタント経由で実行

- MCPサーバーの自作 — 自社APIをMCPサーバーとして公開し、あらゆるMCP対応AIアプリから利用可能に

企業の活用例

- 社内チャットボット + 複数DB連携 — MCPで社内のデータベース群に接続し、AIチャットボットが部門横断でデータ分析

- 業務システムとAIエージェントの統合 — CRM・ERP・会計ソフトをMCPで繋ぎ、AIが横断的に業務を支援

- セキュアなAI連携基盤 — MCPの権限管理とOAuth認証を活用し、情報漏洩リスクを抑えたAI連携を構築

MCP対応ツール一覧 — 主要AIクライアントの比較

MCPに対応するAIクライアントは50以上ありますが、主要なものを以下にまとめます。

クライアント | 開発元 | 対応プリミティブ | 主な用途 |

|---|---|---|---|

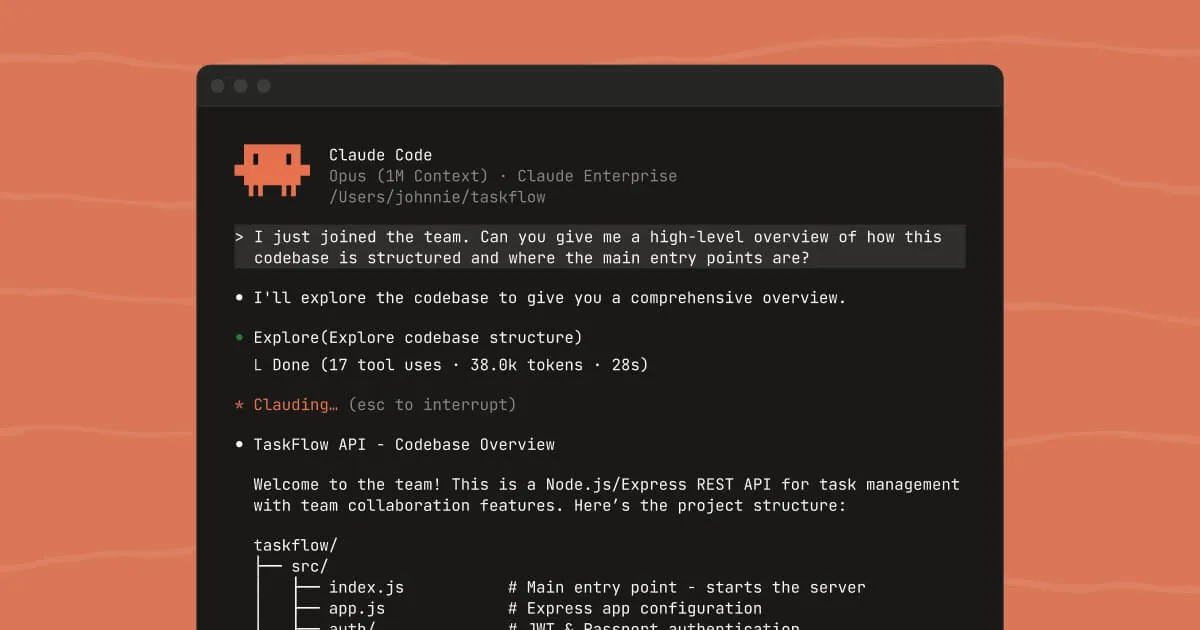

Claude Code | Anthropic | Tools, Resources, Prompts, Roots, Elicitation | AIコーディング |

Claude Desktop | Anthropic | Tools, Resources, Prompts, Sampling, Roots | 汎用AIアシスタント |

Claude.ai | Anthropic | Tools, Resources, Prompts, Apps | Webブラウザ版Claude |

ChatGPT | OpenAI | Tools, Apps | 汎用AIアシスタント |

Cursor | Cursor | Tools, Prompts, Roots, Elicitation | AIコーディング |

VS Code(Copilot) | Microsoft | MCPサーバー接続対応 | コードエディタ |

Gemini CLI | Tools, Prompts | CLIベースのAI | |

Windsurf | Codeium | MCP対応 | AIコーディング |

ポイント: Claude CodeはMCPの対応範囲が最も広く、Elicitation(ユーザーへの確認要求)やRoots(ファイルシステム境界の問い合わせ)にも対応しています。ChatGPTは2025年3月にMCPを統合し、Toolsを中心に対応しています。

公式SDK(10言語対応)

MCPサーバーやクライアントの開発には、以下の言語向けSDKが公式提供されています。

言語 | サポートティア | 備考 |

|---|---|---|

TypeScript | Tier 1(最優先サポート) | 最も成熟。ダウンロード数最大 |

Python | Tier 1 | FastMCPフレームワークが人気 |

C# | Tier 1 | .NET対応 |

Go | Tier 1 | |

Java | Tier 2 | |

Rust | Tier 2 | |

Swift | Tier 3 | |

Ruby | Tier 3 | |

PHP | Tier 3 | |

Kotlin | TBD |

TypeScriptとPythonがTier 1として最も充実しており、MCPサーバーを開発する場合はこの2言語から選ぶのが現時点では実用的です。

AIコーディングツールの全体像を知りたい方は「AIコーディングツール おすすめ比較」もあわせてご覧ください。

MCP vs 関連技術 — RAG・Function Calling・A2Aとの違い

MCPはAI関連の他の技術と混同されやすいため、違いを整理します。

技術比較表

技術 | 目的 | MCPとの関係 |

|---|---|---|

MCP | AIアプリと外部ツール・データの標準接続 | — |

RAG(検索拡張生成) | 外部知識ベースから情報を検索・注入 | 補完関係。RAGが「知識の検索」、MCPが「ツール・データの接続標準」 |

Function Calling | AIモデルが関数を呼び出す仕組み | MCPはFunction Callingを標準化・汎用化するレイヤー。上位互換ではなく「配線の標準化」 |

従来のAPI連携(REST等) | 個別のAPI統合 | MCPは個別API統合を共通プロトコル化。N×M問題を解消 |

iPaaS(Zapier等) | ノーコードのアプリ連携 | MCPはAIネイティブな接続標準。iPaaSは汎用的なノーコード連携 |

MCPとA2Aプロトコルの違い

MCPとよく比較される技術にGoogleが推進するA2A(Agent-to-Agent)プロトコルがあります。

観点 | MCP | A2A |

|---|---|---|

接続対象 | AIアプリ ↔ 外部ツール・データ | AIエージェント ↔ AIエージェント |

目的 | AIが外部リソースにアクセスする | AI同士が連携・協調する |

例え | AIの「手足」を拡張 | AIの「チームメイト」を増やす |

推進元 | Anthropic → AAIF(Linux Foundation傘下) |

簡潔にまとめると、MCPは「AIと外部世界のつなぎ方」の標準であり、A2Aは「AI同士の会話方法」の標準です。両者は競合するものではなく、AIエージェントが高度化するなかで補完的に使われると考えられます。

AIエージェントの概要について詳しくは「AIエージェントとは?仕組み・種類・活用事例を解説」をご覧ください。A2Aプロトコルの詳細は「A2Aプロトコルとは」で解説しています。

MCPのメリット — 立場別に整理

MCPの導入メリットは、利用する立場によって異なります。

開発者にとってのメリット

- 開発工数の大幅削減 — 接続先ごとの個別実装が不要になり、MCPサーバーを1つ作れば全MCPクライアントから利用可能

- エコシステムの活用 — 10,000以上の公開MCPサーバーを自分のアプリから即座に利用できる

- 10言語の公式SDK — TypeScript・Python・Go・C#など、使い慣れた言語でサーバーを開発可能

- プロトコル仕様が公開 — オープンソースのため、ベンダーロックインのリスクが低い

企業にとってのメリット

- AI連携の標準化 — 社内のAIツール導入時に、接続方式を統一できる

- ベンダー非依存 — MCPは特定のAIベンダーに依存しないため、将来のツール変更に柔軟に対応可能

- セキュリティフレームワーク — OAuth認証・権限管理・監査ログなどの仕組みがプロトコルレベルで定義されている

一般ユーザーにとってのメリット

- AIアプリがより便利になる — 使っているAIアプリのMCP対応が進むことで、外部サービスとの連携が自動的に増える

- ツール切り替えが容易 — MCP対応のAIアプリ間であれば、同じMCPサーバー群をそのまま引き継げる

MCPのセキュリティリスクと注意点

MCPは利便性が高い一方で、セキュリティリスクも内包しています。プロトコル自体がセキュリティの4原則を定めていますが、実運用では追加の注意が必要です。

公式が定める4つのセキュリティ原則

- ユーザーの同意と制御 — すべてのデータアクセス・操作に対してユーザーの明示的な同意が必要

- データプライバシー — ユーザーの同意なしにデータを外部に送信してはならない

- ツールの安全性 — ツール実行前にユーザーの承認を取得する必要がある

- LLMサンプリング制御 — サーバーからのサンプリングリクエストはユーザーが承認する

報告されている主なリスク

リスク | 内容 | 深刻度 |

|---|---|---|

ツール汚染攻撃 | 悪意あるMCPサーバーがツール説明に隠し指示を埋め込み、AIの動作を操作する | 高 |

ツール名衝突 | 正規サーバーと同名のツールを悪意あるサーバーが提供し、呼び出しを横取りする | 高 |

コマンドインジェクション | テストされたMCPサーバーの43%で脆弱性が発見されたとの調査結果あり | 高 |

認証情報の漏洩 | 設定ファイルにAPIキーが平文保存される問題 | 中 |

プロンプトインジェクション | MCPサーバー経由でAIに悪意ある指示を注入する攻撃 | 中 |

複数サーバー間の情報漏洩 | 異なる機密レベルのサーバーを同時接続した際の意図しない情報流出 | 中 |

安全に利用するための対策

個人利用の場合:

- 信頼できる公式サーバー、または広く利用されているサーバーのみ接続する

- APIキーは環境変数で管理し、設定ファイルに直書きしない

- 重要な操作の前にはAIからの確認プロンプトに注意を払う

業務利用の場合:

- 最小権限の原則を徹底 — MCPサーバーへのアクセス権限は必要最低限に設定

- OAuth認証を活用 — 短命アクセストークンを使い、長期トークンの露出を回避

- コンテナ隔離 — DockerコンテナでMCPサーバーを実行し、ホスト環境への影響を遮断

- 監査ログの記録 — すべてのツール実行を記録・監視

- サーバーの事前検証 — 導入前にソースコードやセキュリティレビューを実施

AIに関するセキュリティリスクの全体像は「生成AIのセキュリティリスクと対策」、AIエージェント固有のセキュリティ課題は「AIエージェントのセキュリティ対策ガイド」で詳しく解説しています。

MCPの始め方 — 利用者タイプ別ガイド

MCPの利用方法は、利用者のタイプによって大きく異なります。

一般ユーザー(非エンジニア)

MCPに対応したAIアプリを使うだけで、MCPの恩恵を受けられます。

- Claude DesktopまたはChatGPTデスクトップアプリをインストール

- 設定画面からMCPサーバーを追加 — 公式コネクタ(Google Drive、Notion等)を選択

- AIとの会話で外部ツールを活用 — 「Notionの今日のタスクを教えて」のように自然言語で依頼

開発者(MCPサーバーを利用する)

既存のMCPサーバーをプロジェクトに導入する場合は、以下の流れです。

- 使いたいMCPサーバーをGitHubや公式ディレクトリで検索

- AIアプリの設定ファイルにサーバー情報を記述(JSON形式で指定)

- APIキー等の認証情報を環境変数に設定

- AIアプリを再起動して接続確認

開発者(MCPサーバーを自作する)

自社サービスやAPIをMCPサーバーとして公開したい場合は、以下の手順です。

- 公式SDK(TypeScriptまたはPython推奨)をインストール

- ツール・リソース・プロンプトを定義 — SDKのAPIに従い、提供する機能を実装

- トランスポート方式を選択 — ローカル利用ならstdio、リモート公開ならStreamable HTTP

- MCP Inspectorでテスト — 公式の開発ツールで動作確認

- セキュリティ対策を実装 — 認証・権限管理・入力バリデーション

TypeScript SDKを使えば、最小限のMCPサーバーは数十行のコードで構築できます。

企業(MCPを組織的に導入する)

- POC(概念実証) — 1つの業務システムとAIアプリをMCPで接続し、効果を検証

- セキュリティ基盤の構築 — OAuth認証・コンテナ隔離・監査ログの仕組みを整備

- 段階的な展開 — 接続先を順次追加し、社内のAI活用範囲を拡大

- 運用体制の確立 — MCPサーバーの更新・監視・インシデント対応の体制を構築

こんな方にMCPはおすすめ / おすすめしない方

MCPの活用がおすすめな方

タイプ | 理由 |

|---|---|

AIツールの外部連携を強化したい開発者 | 個別API実装の工数を削減でき、エコシステムの既存サーバーを即座に利用可能 |

複数のAIツールを使い分けている方 | MCP対応サーバーはどのAIアプリからも共通で利用でき、ツール切り替え時のコストが低い |

社内業務システムとAIを連携させたい企業 | 標準化されたプロトコルで、ベンダーロックインを避けながらAI連携基盤を構築できる |

Claude DesktopやChatGPTをもっと便利に使いたい個人ユーザー | Google Drive・Notion・GitHub等と連携させることで、AIアシスタントの実用性が大幅に向上 |

MCPをおすすめしない方

タイプ | 理由 |

|---|---|

AI自体をまだ使い始めていない方 | まずはAIアプリ単体の基本操作に慣れてからMCP連携に進む方が効率的 |

セキュリティ要件が極めて厳しい環境で即座に本番導入したい方 | MCPの認証フレームワークは発展途上であり、高度なセキュリティ要件には追加の対策が必要 |

外部ツール連携のニーズがない方 | AIアプリ単体で十分に目的を達成できるなら、MCP導入の優先度は低い |

プロトコルの仕様変動に対応できないプロジェクト | MCPはまだ活発に進化中であり、破壊的変更の可能性がある点に留意が必要 |

よくある質問(FAQ)

Q1. MCPは無料で使えますか?

MCPのプロトコル仕様とSDKはオープンソースで無料です。ただし、MCPクライアント側のAIサービス利用料(Claude Pro/Maxの月額料金等)や、リモートMCPサーバーのホスティング費用は別途かかります。ローカルで動作するMCPサーバーを利用する場合、追加のインフラ費用は発生しません。

Q2. MCPを使うにはプログラミングスキルが必要ですか?

既存のMCPサーバーを利用するだけなら不要です。 Claude DesktopやChatGPTの設定画面からMCPサーバーを追加するだけで、多くの外部連携が可能です。一方、MCPサーバーを自作する場合はTypeScriptやPython等のプログラミング知識が必要になります。

Q3. MCPとFunction Callingの違いは何ですか?

Function CallingはAIモデルが関数を呼び出すための仕組みで、モデルごと・プラットフォームごとに実装が異なります。MCPはその「呼び出し方」をプラットフォーム横断で標準化するレイヤーです。MCPはFunction Callingの上位互換ではなく、複数のAIアプリ間で同じツール定義を共有するための「共通規格」と理解するのが正確です。

Q4. MCPは安全ですか?

プロトコル仕様でセキュリティの4原則が定められていますが、「安全かどうか」はMCPサーバーの実装品質と利用者の運用方法に依存します。信頼できるサーバーのみを接続し、APIキーの管理を適切に行い、重要な操作前にはAIの確認に注意を払うことが重要です。

Q5. MCPサーバーは10,000以上あるそうですが、どう選べばよいですか?

以下の基準で選ぶことを推奨します。

- 公式またはベンダー公式が提供するサーバー を優先(例: GitHub公式、Sentry公式)

- GitHubのスター数やメンテナンス頻度 を確認

- セキュリティレビュー — ソースコードが公開されており、定期的に更新されているか

- MCP公式クライアントページ に掲載されているサーバーを参考にする

Q6. MCPはいつから業界標準になったのですか?

2024年11月のAnthropic発表後、2025年3月にOpenAIが採用、同年4月にGoogleが採用を表明し、主要AI企業が揃って支持する形になりました。2025年12月にLinux Foundation傘下のAAIFに移管されたことで、名実ともに業界標準としての地位が確立されています。

MCPの最新動向タイムライン

時期 | 出来事 |

|---|---|

2024年11月 | Anthropicが MCP を発表。仕様・SDK・Claude Desktopでのサポートを公開 |

2025年3月 | OpenAIがChatGPTデスクトップアプリにMCPを統合 |

2025年4月 | Google DeepMindがMCP採用を発表。セキュリティ脆弱性が複数報告される |

2025年11月 | 仕様バージョン2025-11-25リリース。非同期操作、ステートレスモード等を追加 |

2025年12月 | AnthropicがMCPをAAIFに寄贈。Linux Foundation傘下の中立ガバナンスへ |

2026年3月 | SDKダウンロード数が月間9,700万を突破。ブレイクスルー技術大賞に選出 |

MCPは活発に進化を続けているプロトコルです。仕様の更新や新機能の追加が頻繁に行われるため、最新情報はMCP公式サイトで確認することを推奨します。

まとめ

MCP(Model Context Protocol)は、AIアプリケーションと外部ツール・データソースを標準的に接続するオープンプロトコルです。

- 何をするものか: AIアプリと外部ツールの接続を「USB-C」のように標準化し、N×M問題を解消する

- 誰が管理しているか: Anthropicが開発し、現在はLinux Foundation傘下のAAIFが中立的に管理

- どれくらい普及しているか: 月間9,700万DL、10,000以上のサーバー、主要AI4社すべてが採用

- リスクはあるか: ツール汚染攻撃やコマンドインジェクション等のリスクがあり、適切なセキュリティ対策が必要

MCPは「AIがもっと便利になるための配線規格」です。個人ユーザーならMCP対応AIアプリの設定を確認するだけで恩恵を受けられ、開発者なら自社ツールをMCPサーバーとして公開することでAIエコシステムへの接続が容易になります。

関連記事

この記事の著者

AI革命

編集部

AI革命株式会社の編集部です。最新のAI技術動向から実践的な導入事例まで、企業のデジタル変革に役立つ情報をお届けしています。豊富な経験と専門知識を活かし、読者の皆様にとって価値のあるコンテンツを制作しています。