Claude Opus 4.7 vs GPT-5.5(Spud)徹底比較|料金・性能・用途別おすすめを完全整理【2026年4月最新】

この記事のポイント

Claude Opus 4.7とGPT-5.5(Spud)を料金・ベンチマーク・用途別に徹底比較。コーディングはOpus 4.7、ターミナル自動化・長コンテキストはGPT-5.5が優位。APIコスト・セキュリティ・移行時の注意点まで、実務判断に必要な情報をすべて整理します。

コーディングはClaude Opus 4.7、ターミナル自動化・長コンテキスト・数学推論はGPT-5.5(Spud)が現時点では優位です。 どちらかが「全面的に上」という関係ではなく、得意領域が明確に異なるため、用途に応じた使い分けが最も合理的な結論です。

この記事では、2026年4月にそれぞれリリースされた両モデルを、API料金・ベンチマーク10指標・10の業務シーン・セキュリティ対応という4つの軸で比較します。API移行コストや既存ユーザーへの影響も含めて整理しているため、個人利用から企業導入まで、意思決定に必要な情報をひとつの記事で把握できます。

出典: Anthropic 公式サイト

Claude Opus 4.7 vs GPT-5.5 Spud — 結論を先に言う

結論を3点でまとめます。

- コーディング・エージェント開発ならOpus 4.7:SWE-bench Pro(実世界コード修正)でOpus 4.7は64.3%、GPT-5.5は58.6%。難しいPR作成・バグ修正・リポジトリリファクタリングで5.7ポイント差がある

- ターミナル・CLI自動化・長コンテキスト・数学推論ならGPT-5.5:Terminal-Bench 2.0(82.7% vs 69.4%)、超長距離情報検索(MRCR v2: 74.0% vs 32.2%)、抽象推論(ARC-AGI-2: 85.0% vs 75.83%)でGPT-5.5が大差をつける

- APIコストはほぼ同水準だが出力量が多い用途はOpus 4.7が有利:入力は同価格($5/1M tokens)。出力はOpus 4.7が$25、GPT-5.5が$30(約20%差)。さらにGPT-5.5は272,000トークン超のセッション全体が2倍課金になるため、超長コンテキスト利用では見かけ以上に高くなる

2モデルの基本情報と位置づけ

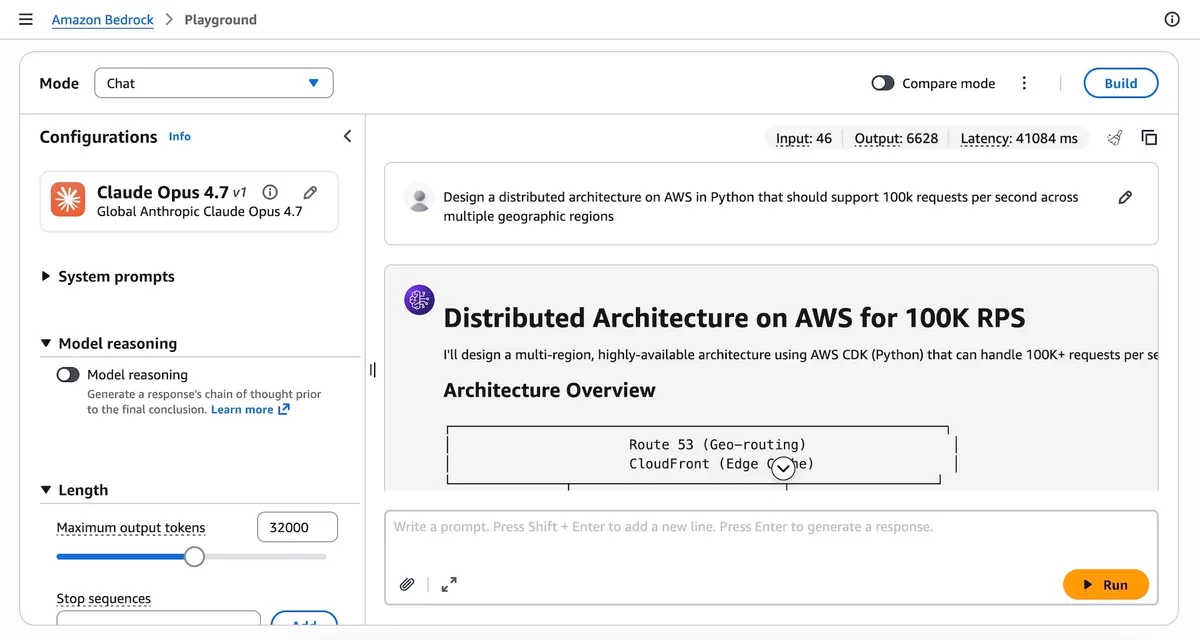

Claude Opus 4.7とは

Claude Opus 4.7は、Anthropicが2026年4月16日に一般公開した現行最高性能モデルです。エージェント型コーディング・長時間自律タスク・高解像度ビジョン・知識労働を主な設計ターゲットとしています。

公式が強調する新要素は以下の3点です。

- SWE-bench Pro 64.3%:前モデルOpus 4.6(53.4%)から10.9ポイント向上。実世界のコード修正能力でGPT-5.5(58.6%)に5.7ポイント差をつける

- 高解像度ビジョン:対応解像度が最大2,576px / 3.75MPへ拡張(従来比約3.3倍)。CAD図・回路図・UIスクリーンショットの解析精度が向上

- Task Budgets(ベータ):エージェントループ全体へのトークン予算設定が可能になり、コスト管理と推論品質のバランスを取りやすくなった

コンテキストウィンドウは100万トークンで、長コンテキストの追加料金はありません。提供形態はclaude.ai(Professional/Teamプラン以上)、Messages API、Amazon Bedrock、Google Cloud Vertex AI、Microsoft Foundryです。

GPT-5.5(Spud)とは

GPT-5.5(開発コードネーム「Spud」)は、OpenAIが2026年4月23日に公開した現行フロンティアモデルです。GPT-4.5以来の完全再学習ベースモデルで、テキスト・画像・音声・動画を単一アーキテクチャで処理する「ネイティブオムニモーダル」が最大の特徴です。

公式が強調する新要素は以下の3点です。

- Terminal-Bench 2.0の世界記録:82.7%を達成し、CLIエージェント・複雑なコマンドライン自動化での能力がGPT-4.5比で大幅向上

- コンテキストウィンドウ105万トークン:長距離情報検索ベンチマーク(MRCR v2)でOpus 4.7の2.3倍のスコア(74.0% vs 32.2%)を記録

- Workspace Agents:ChatGPT Business/Enterprise向けに、ユーザーがオフラインでもクラウド上で自律動作を継続するエージェント機能が追加された

知識カットオフは2025年12月1日。提供形態はChatGPT(Plus/Pro/Business/Enterprise/Edu)、Responses API、Chat Completions API、Codexです。

項目 | Claude Opus 4.7 | GPT-5.5(Spud) |

|---|---|---|

開発元 | Anthropic | OpenAI |

リリース日 | 2026年4月16日 | 2026年4月23日 |

コンテキストウィンドウ | 100万トークン | 105万トークン |

最大出力トークン | 128,000 | 128,000 |

ネイティブオムニモーダル | 非対応(テキスト・画像) | 対応(テキスト・画像・音声・動画) |

日本語公式ベンチマーク | 非公開 | 非公開 |

提供プラットフォーム | claude.ai / API / Bedrock / Vertex | ChatGPT / API / Codex |

料金比較 — 実コストはOpus 4.7が有利な場面も

API料金一覧

項目 | Claude Opus 4.7 | GPT-5.5(標準) | GPT-5.5 Pro |

|---|---|---|---|

入力(1Mトークン) | $5.00 | $5.00 | $30.00 |

出力(1Mトークン) | $25.00 | $30.00 | $180.00 |

キャッシュ入力 | 未確認 | $0.50 | — |

Batch処理 | 未確認 | $2.50入力(50%割引) | — |

Priority処理 | — | 標準の2.5倍 | — |

長コンテキスト割増 | なし | 272K超で入力2倍・出力1.5倍 | 同左 |

入力料金は同価格($5/1Mトークン)ですが、出力料金でOpus 4.7が約20%安いという構図です。エージェントループや長文生成のように出力トークンが多い用途では、この差が大きく効いてきます。

月間利用コスト試算

Build This Nowの調査(2026年4月時点)に基づく試算です。

利用シナリオ | Claude Opus 4.7 | GPT-5.5 |

|---|---|---|

標準コーディングセッション | $1.70 | $2.00 |

長時間エージェント実行 | $9.25 | $10.75 |

月間大規模自動化 | $185 | $215 |

出力トークンが多い用途ではOpus 4.7が約15〜17%コスト有利という結果です。

GPT-5.5の272Kトークン課金ルールに注意

GPT-5.5には見落としやすい料金ルールがあります。入力が272,000トークン(約20万字程度)を超えるセッションでは、そのセッション全体の入力が標準の2倍、出力が1.5倍の料金に切り替わります。

具体的には:

- 272K超のセッション:入力$10/1Mトークン、出力$45/1Mトークン

- Opus 4.7の場合:100万トークンまで入力$5・出力$25(割増なし)

大規模なコードベース(数百万行規模)や長大なドキュメントの一括処理では、GPT-5.5の「コンテキストウィンドウが広い」というメリットが料金で相殺されるケースがあります。272Kを超える大量バッチ処理はコスト計算を必ず事前に行うことを推奨します。

なお、Opus 4.7では新しいトークナイザーによりOpus 4.6比で最大35%トークン消費が増加する場合があります。既存のコスト計算をそのまま流用すると想定より費用がかかることがあるため、移行後は実際の消費量を再測定してください。

性能比較 — ベンチマーク10指標で判定

コーディング・開発支援

ベンチマーク | Claude Opus 4.7 | GPT-5.5 | 優位 |

|---|---|---|---|

SWE-bench Pro(実世界コード修正) | 64.3% | 58.6% | Opus 4.7 |

SWE-bench Verified(検証済みIssue解決) | 87.6% | 88.7% | GPT-5.5(僅差) |

実世界のコード修正能力(SWE-bench Pro)ではOpus 4.7がリードしています。 SWE-bench Verifiedは88.7% vs 87.6%とGPT-5.5がわずかに上回りますが、ほぼ同等と見てよい差です。難しいPR作成・マルチファイルリファクタリング・バグ修正の自動化ではOpus 4.7を選ぶ理由が明確にあります。

ターミナル・CLI自動化

ベンチマーク | Claude Opus 4.7 | GPT-5.5 | 優位 |

|---|---|---|---|

Terminal-Bench 2.0(CLIエージェント) | 69.4% | 82.7% | GPT-5.5 |

GPT-5.5が13ポイント以上の差をつけており、ターミナル作業・シェルスクリプト生成・CLI自動化では明確にGPT-5.5が優れています。 DevOpsの自動化や複雑なコマンドライン処理にはGPT-5.5を選ぶべき理由がここにあります。

長コンテキスト処理

ベンチマーク | Claude Opus 4.7 | GPT-5.5 | 優位 |

|---|---|---|---|

MRCR v2(512K〜1M長距離情報検索) | 32.2% | 74.0% | GPT-5.5 |

超長コンテキストでの情報検索ではGPT-5.5が2倍以上のスコア差をつけています。 大規模コードリポジトリの全読み込みや、数百ページのドキュメントから特定情報を抽出する用途ではGPT-5.5が大きく有利です。ただし、前述の272K超課金ルールとのトレードオフを考慮する必要があります。

数学・推論・抽象思考

ベンチマーク | Claude Opus 4.7 | GPT-5.5 | 優位 |

|---|---|---|---|

FrontierMath Tier 4(競技数学) | 22.9% | 35.4% | GPT-5.5 |

ARC-AGI-2(抽象推論) | 75.83% | 85.0% | GPT-5.5 |

GPQA Diamond(博士レベル質問) | 94.2% | 93.6% | Opus 4.7(僅差) |

HLE(学術推論) | 46.9% | 41.4% | Opus 4.7 |

数学・抽象推論ではGPT-5.5が優位ですが、博士レベルの質問(GPQA Diamond)や学術推論(HLE)ではOpus 4.7がわずかにリードしています。研究・論文支援・専門文書執筆ではOpus 4.7が健闘しています。

Webリサーチ・情報収集

ベンチマーク | Claude Opus 4.7 | GPT-5.5 | 優位 |

|---|---|---|---|

BrowseComp(Webリサーチ) | 79.3% | 84.4% | GPT-5.5 |

Webリサーチ・競合分析・情報収集用途ではGPT-5.5が5ポイント差でリードしています。ただし、どちらも80%前後と高水準であり、日常的なリサーチ用途では大きな差を感じにくいでしょう。

マルチツール・エージェント

ベンチマーク | Claude Opus 4.7 | GPT-5.5 | 優位 |

|---|---|---|---|

MCP-Atlas(マルチツール連携) | 77.3〜79.1% | 75.3% | Opus 4.7 |

CyberGym(セキュリティ) | ≈74% | 81.8% | GPT-5.5 |

MCP(Model Context Protocol)を使ったマルチツール連携ではOpus 4.7が優位です。MCPサーバーと複数のツールを組み合わせたエージェント開発にはOpus 4.7を選ぶメリットがあります。

金融・法律・知識労働

ベンチマーク | Claude Opus 4.7 | GPT-5.5 | 優位 |

|---|---|---|---|

Finance Agent v1.1(金融分析) | 64.4% | 60.0% | Opus 4.7 |

BigLaw Bench(法律文書) | 90.9% | — | Opus 4.7 |

CharXiv(高精度チャート分析) | 82.1% | — | Opus 4.7 |

財務分析・法律文書・チャート解析ではOpus 4.7が強みを持ちます。.docxのレッドライニングや.pptxの追跡変更自動生成など、ビジネス文書のエージェント処理でも実績があります。

総合スコア

指標 | Claude Opus 4.7 | GPT-5.5 | 優位 |

|---|---|---|---|

Intelligence Index v4.0(総合) | 57点 | 60点 | GPT-5.5(僅差) |

MMLU(汎用知識) | — | 92.4% | GPT-5.5 |

総合スコアではGPT-5.5がわずかに上ですが、3点差は誤差範囲に近く、「どちらが全体的に優れているか」は用途次第です。

用途別おすすめ — 10シーンで判定

用途シーン | 推奨モデル | 理由(ベンチマーク根拠) |

|---|---|---|

コーディング・PR作成・バグ修正 | Opus 4.7 | SWE-bench Pro 64.3% vs 58.6%(5.7ポイント差) |

ターミナル・CLI・シェルスクリプト自動化 | GPT-5.5 | Terminal-Bench 2.0: 82.7% vs 69.4%(13ポイント差) |

大規模コードベースの全体分析 | GPT-5.5 | MRCR v2 74.0% vs 32.2%(2倍以上の差) |

財務・会計・金融レポート分析 | Opus 4.7 | Finance Agent 64.4% vs 60.0% |

競合調査・Webリサーチ | GPT-5.5 | BrowseComp 84.4% vs 79.3% |

高解像度資料・図面・CAD解析 | Opus 4.7 | 3.75MP対応(GPT-5.5の仕様は未公開) |

プレゼン資料・Word文書の自動編集 | Opus 4.7 | .pptxレイアウト自動検証・BigLaw Bench 90.9% |

論文・専門技術文書の執筆支援 | Opus 4.7 | GPQA Diamond 94.2%・HLE 46.9% |

カスタマーサポートのレスポンス自動化 | GPT-5.5 | 処理速度(50トークン/秒 vs 42トークン/秒) |

競技数学・アルゴリズム設計 | GPT-5.5 | FrontierMath Tier 4: 35.4% vs 22.9% |

Opus 4.7が向いている人・GPT-5.5が向いている人

Opus 4.7が向いている場合

以下の条件に当てはまるなら、Claude Opus 4.7を主軸にすることを推奨します。

- ソフトウェア開発チームで実際のコードリポジトリへの変更・PR作成を自動化したい

- MCPを使った複数ツール連携のエージェントを構築している

- 財務レポート・法律文書・学術論文など、高精度な知識作業が中心

- CAD図・回路図・UI設計書など、高解像度の技術資料を読み取らせたい

- エージェントループの出力が多く、APIコストを抑えたい(出力トークンの単価差が効く)

- 既にAmazon BedrockやGoogle Cloud Vertex AIに投資しており、インフラを変えたくない

GPT-5.5が向いている場合

以下の条件に当てはまるなら、GPT-5.5を主軸にすることを推奨します。

- DevOpsやインフラ管理でターミナル・CLIの自動化が業務の中心

- 巨大なコードベースやドキュメント群を丸ごと読み込ませて分析する用途がある(272K以内に収まる場合)

- 数学・統計・アルゴリズムの高度な推論処理が必要

- 音声・動画を含むマルチモーダルな入出力を単一モデルで扱いたい

- ChatGPT Workspace Agentsを活用した企業内の自律エージェント運用を検討している

- GPT系モデルへの既存投資(プロンプト・インフラ)を活かして最新モデルに乗り換えたい

両方使う「マルチモデル戦略」が現実解

実際のところ、API料金はほぼ同水準であることを考えると、タスクの種類に応じて自動的にモデルを振り分ける設計が最もコスパが高いです。

典型的な振り分け例:

コーディング・PR作成 → claude-opus-4-7

ターミナル・CLI自動化 → gpt-5.5

Webリサーチ・情報収集 → gpt-5.5

財務・法律文書作成 → claude-opus-4-7

汎用テキスト生成(安価) → claude-haiku / gpt-4o-miniOpenAIのResponses APIとAnthropicのMessages APIはいずれもStreaming・関数呼び出し・構造化出力に対応しているため、抽象化レイヤーを1枚挟めば実装コストは低く抑えられます。

ハルシネーションと信頼性について

第三者評価(公式非確認)では、Opus 4.7のハルシネーション率が約36%、GPT-5.5が約86%と報告されています。ただし、この数値は公式発表値ではなく、測定方法・対象ドメインによって大きく変わるため、そのまま意思決定の根拠にするのは避けるべきです。

公式が明示しているファクト:

- Opus 4.7:.docxレッドライニングでの文書エラーを21%削減

- GPT-5.5:知識正答率57%(GPT系で過去最高)、事実誤認を含む応答を3%削減

医療・法務・金融など事実の正確性が重要な用途では、どちらのモデルを使う場合でも出力の人間によるファクトチェックを省くことはできません。「ハルシネーション率が低い方が良い」という前提は正しいですが、現時点では第三者評価の数値を過信せず、本番稼働前に自社ユースケースでの評価を行うことを推奨します。

セキュリティ・企業利用での注意点

Anthropic(Opus 4.7)のセキュリティ対応

Opus 4.7にはProject Glasswingと呼ばれるリアルタイムサイバーセキュリティセーフガードが搭載されています。禁止または高リスクのサイバーセキュリティ関連リクエストを自動検出・ブロックする機能です。

正規のペネトレーションテスター・脆弱性研究者・レッドチームには、別途アクセス申請プログラム(Cyber Verification Program、https://claude.com/form/cyber-use-case)が用意されています。

また、Anthropicは同時期に開発した次世代モデル「Mythos」の一般公開をリスク評価上の懸念から見送り、Opus 4.7を代わりに公開した経緯があります。セキュリティを優先した選択であり、Opus 4.7がより保守的な安全基準で運用されているモデルであることを示しています。

OpenAI(GPT-5.5)のセキュリティ対応

GPT-5.5には公式のSystem Cardが公開されており、Preparedness Frameworkに基づく高度なサイバーセキュリティ・生物学的能力のレッドチームテストが実施済みです。また、Bio Bug Bounty(生物学的リスクに関するバグバウンティプログラム)を公開しています。

一般公開前に約200社の早期アクセスパートナーからフィードバックを収集したとされており、企業導入における信頼性の担保に取り組んでいます。

企業利用でのデータ保護

現時点での一般的な方針として:

- Anthropic:API経由のリクエストはデフォルトでトレーニングに使用しない

- OpenAI:APIリクエストはデフォルトでトレーニングに使用しない(Enterprise/Businessプランは契約上の保証付き)

どちらも機密情報を含むプロンプトを送信する前に、最新の利用規約・DPA(データ処理契約)の確認を推奨します。

Opus 4.6からの移行に必要な変更点(API利用者向け)

Opus 4.6からOpus 4.7へ移行する際、そのまま使うと400エラーが出る破壊的変更が複数あります。既存のAnthropicユーザーは必ず確認してください。

変更点 | Opus 4.6での挙動 | Opus 4.7での挙動 |

|---|---|---|

| 動作する | 400エラー |

拡張思考の固定予算指定( | 動作する | 400エラー(Adaptive Thinkingに一本化) |

思考コンテンツの表示 | デフォルトで返される | デフォルトで省略( |

Task Budgets | 非対応 | Messages APIでベータ提供 |

|

|

|

特にサンプリングパラメータ(temperature等)をカスタム設定していたプロンプトは、Opus 4.7では動作しません。エージェントループでOpus 4.7を使う場合は effort: "xhigh" の設定と、新しいトークナイザーによるコスト再計算(最大35%増)の両方を考慮した設計が必要です。

よくある質問

Q. Claude Opus 4.7とGPT-5.5、日本語性能はどちらが高いですか?

現時点では、両モデルとも日本語専用のベンチマークを公式には公開していません。Opus 4.7の新トークナイザーは日本語を含む非英語テキストでトークン消費量が変わる可能性があります。日本語業務への実導入前は、実際のプロンプトを使ったA/Bテストを推奨します。

Q. 無料で使えますか?

Claude Opus 4.7はclaude.aiの無料プランでの利用可否が現時点では未確認です(Professional/Teamプランでの利用は確認済み)。GPT-5.5はFreeプランでは利用不可で、Plus(月$20)以上のプランが必要です。

Q. APIはいつから使えますか?

Claude Opus 4.7は2026年4月16日のリリース時点ですべてのプラットフォームでAPI利用可能です。GPT-5.5のAPIは2026年4月24日から提供開始が確認されています。

Q. コーディングに使うならどちらを選ぶべきですか?

実世界のコード修正(SWE-bench Pro)ではOpus 4.7が優位です。ただし、ターミナル操作・シェルスクリプト・CLIエージェントにはGPT-5.5が向いています。「コーディング」の内容によって答えが変わるため、この記事の「用途別おすすめ」表を参考にしてください。

Q. 長文処理(100Kトークン以上)にはどちらを選ぶべきですか?

272,000トークン以内に収まるなら、GPT-5.5の方が長距離情報検索の精度が高く(MRCR v2: 74.0% vs 32.2%)、Batch処理での50%割引も使えるためコスト優位です。ただし、272K超のセッションではGPT-5.5の料金が2倍になるため、コスト計算が必要です。100万トークン近い超長コンテキストで追加料金を避けたい場合はOpus 4.7が選択肢になります。

Q. GPT-5.5 ProはいつGPT-5.5 Standardより必要になりますか?

GPT-5.5 Proは入力$30・出力$180と標準の6倍の料金です。より高い知能・推論品質が求められる高付加価値な自動化タスク(複雑な法律分析・医薬品研究支援など)や、処理をPriority(優先処理)で確実に高速化する必要がある場面を想定して設計されています。一般的なビジネス用途では標準モデルで十分です。

まとめ

Claude Opus 4.7とGPT-5.5(Spud)は、2026年4月時点における2大フロンティアモデルですが、それぞれ得意領域が明確に異なります。

比較軸 | Claude Opus 4.7 | GPT-5.5(Spud) |

|---|---|---|

コーディング(実世界PR作成) | 優 | 良 |

ターミナル・CLI自動化 | 良 | 優 |

長コンテキスト情報検索 | 可 | 優 |

数学・抽象推論 | 良 | 優 |

財務・法律・知識作業 | 優 | 良 |

高解像度ビジョン | 優 | 未公表 |

マルチツール連携(MCP) | 優 | 良 |

Webリサーチ | 良 | 優 |

APIコスト(出力多い用途) | 有利 | やや高い |

長コンテキストAPIコスト | 追加料金なし | 272K超で2倍 |

セキュリティ姿勢 | 保守的(Mythos非公開) | System Card公開・BugBounty |

現実的な使い方としては、コーディングや知識作業はOpus 4.7、ターミナル自動化・大規模ドキュメント処理・数学推論はGPT-5.5と振り分けるマルチモデル戦略が最もパフォーマンスとコストのバランスが取れます。

どちらのモデルも2026年4月にリリースされたばかりであり、第三者評価・ユーザーレポートは今後更新されます。最新の料金や仕様は各社公式サイトで確認することを推奨します。

関連記事:

この記事の著者

AI革命

編集部

AI革命株式会社の編集部です。最新のAI技術動向から実践的な導入事例まで、企業のデジタル変革に役立つ情報をお届けしています。豊富な経験と専門知識を活かし、読者の皆様にとって価値のあるコンテンツを制作しています。

最新記事

OpenAI × AWSパートナーシップ徹底解説|GPT-5.5 on Bedrock・Codex・Managed Agents・AI覇権移行

2026/04/29

楽天 Rakuten AI 3.0 = DeepSeek V3 リブランド炎上まとめ|GENIAC補助金・国産LLMの定義を揺るがした大事件徹底解説

2026/04/28

OpenAI × Microsoft 新パートナーシップ完全解説|マルチクラウド解禁・収益分配の真相・非独占ライセンスをわかりやすく整理

2026/04/28

Google × Anthropic 400億ドル投資パートナーシップ徹底解説|100億ドル即時+300億ドル条件達成・5GW TPU・3,500億ドル評価額の意味

2026/04/28

Claudeコネクタの使い方|Spotify・Uber Eats・TurboTax・Booking.com連携の完全ガイド

2026/04/28

ChatGPT for Cliniciansとは?米国医師・NP・PA・薬剤師向け無料医療AIとHealthBench Professionalを徹底解説

2026/04/28