Mistral Medium 3.5とは?128B統合モデルの機能・料金・SWE-bench 77.6%を徹底解説【2026年4月最新】

この記事のポイント

Mistral AIが2026年4月リリースした128B Dense型統合モデル。SWE-bench 77.6%・APIはClaude Sonnet比約50%安・Modified MITでセルフホスト可能。Le Chat Work Mode・Vibe CLI・競合比較まで日本語で網羅解説。

Mistral Medium 3.5は、フランスのMistral AIが2026年4月29日にリリースした128Bパラメータの大規模言語モデルです。チャット・推論(Reasoning)・コーディングの3つの能力を単一の重みセットに統合した「初のフラッグシップ統合モデル」と位置付けられており、Modified MITライセンスでオープンウェイト公開されています。

SWE-bench Verified(コーディングエージェント精度)で77.6%を記録し、API料金はClaude Sonnet 4.6の約半額。開発者・企業向けの有力な選択肢として急速に注目を集めています。

この記事でわかること:

- Mistral Medium 3.5の基本スペックと他モデルとの違い

- Le Chat Work Mode(アジェンティックモード)でできること・できないこと

- Mistral Vibe CLIの機能とリモートエージェント(GitHub PR自動生成)の使い方

- API料金の詳細とClaude Sonnet 4.6との具体的コスト比較

- Modified MITライセンスの企業導入時の注意点

- こんな人におすすめ / おすすめしない人の整理

AIコーディングツールや低コストLLM APIを検討している開発者・エンジニア、EU/GDPRデータ主権を重視する企業担当者に向けた記事です。

Mistral Medium 3.5とは — 3機能を統合した128B Dense型モデル

Mistral Medium 3.5は、これまで「コーディングモデル」「チャットモデル」「推論モデル」と別々に提供されてきた機能を単一の重みセットに統合したモデルです。

項目 | 仕様 |

|---|---|

開発元 | Mistral AI(フランス・パリ、2023年創業) |

リリース日 | 2026年4月29日 |

パラメータ数 | 128B(Dense型 — 全パラメータが常に活性化) |

アーキテクチャ | Dense Transformer(MoEではない) |

コンテキスト長 | 256,000トークン |

入力モダリティ | テキスト+画像(マルチモーダル) |

出力モダリティ | テキストのみ(画像生成不可) |

対応言語 | 日本語・英語・フランス語・中国語・韓国語・アラビア語ほか30言語以上 |

ライセンス | Modified MIT License |

API モデルID |

|

Mistral AIはフランス・パリに本社を置く2023年創業のAI企業。ヨーロッパを代表するAIスタートアップとして、オープンウェイトモデルの積極公開で知られています。Mistral AI全体の概要については「Mistral AIとは」をあわせて参照してください。

Dense型アーキテクチャの特徴

競合のDeepSeek V4-Pro(1.6Tパラメータ・MoE)やQwen3が採用するMoE(Mixture of Experts)とは異なり、Mistral Medium 3.5はすべてのパラメータが常に活性化するDense(密集)型を採用しています。

MoEは推論時に一部のエキスパートだけを起動するため効率的ですが、実装の複雑さがあります。Denseは設計がシンプルで、reasoning_effortパラメータで推論モードを切り替えることで速度と精度のバランスを取る設計です。

Mistral Medium 3.5でできること

1. 統合型チャット・推論・コーディング

リクエスト時に reasoning_effort を指定するだけで、同一モデルで3つのモードを切り替えられます。

| 用途 | 特徴 |

|---|---|---|

| 日常チャット・簡単なタスク | 高速応答、低コスト |

| 複雑な論理・コーディングエージェント | 推論トークンを活用、高精度 |

従来は「速いが精度が低いモデル」と「遅いが精度が高いモデル」を使い分ける必要がありましたが、Medium 3.5では単一モデルで対応できます。

2. マルチモーダル(画像入力)

可変サイズ・アスペクト比に対応したビジョンエンコーダーをスクラッチから学習しており、以下の画像分析が可能です。

- 図表・グラフの読み取りと解説

- UIスクリーンショットの分析

- 書類・請求書のOCR的処理

- ドキュメント画像へのQnA

ただし、出力はテキストのみです。画像生成には対応していません。

3. エージェント機能(関数呼び出し)

- ネイティブ関数呼び出し(Function Calling)対応

- 構造化JSON出力

- マルチターン会話でのツール統合

- OCR・ドキュメントQnA

4. Le Chat Work Mode(アジェンティックモード)

メール・カレンダー・Notionなどのツールを横断して自律的にタスクを実行するエージェントモード。詳細は次のセクションで解説します。

5. Mistral Vibe CLI(コーディングエージェント)

コマンドラインでコードベースと自然言語で対話し、ファイル操作・テスト実行・GitHub PR作成まで自律的に処理するCLIツール。詳細は後述。

6. Ollama・セルフホスティング

ollama.com/library/mistral-medium-3.5 から Ollama 経由でローカル実行可能。Hugging Face上のオープンウェイトモデルとしてもダウンロード可能です(ただし128B規模のため高スペックGPUが必要)。

Le Chat Work Mode — アジェンティック業務支援の詳細

Le Chat Work Mode は、Mistral Medium 3.5 を使ったLe ChatのマルチステップタスクエージェントModeです。2026年4月29日にPreviewとして段階的ロールアウトが開始されました。

Work Modeでできること

Work Mode は以下のような複合的な業務タスクに対応します。

ワークフロー自動化

- メール・Slack・カレンダーを1つの指示で横断操作

- 受信箱のトリアージ・返信草案作成・チームへのサマリー送付

- 定期レポートの自動生成(週次プロジェクトステータス、競合分析など)

リサーチ&ドキュメント生成

- Webおよび接続ツール・内部ドキュメントから構造化レポートを生成

- Canvas(ドキュメント形式)への出力 — 編集可能なブリーフ・スライドアウトライン

データ処理

- 請求書処理・異常フラグ付け・例外レポートの自動作成

- 複数ソースのデータ統合と分析

Work Mode で使えるツール

ツール | 説明 |

|---|---|

Bash サンドボックス | コマンド実行・スクリプト処理 |

Web 検索 | リアルタイム情報取得 |

Canvas | ドキュメント・レポート・スライドアウトラインの生成 |

ライブラリ&ファイルアップロード | 独自ドキュメントの参照 |

Connectors(MCP対応) | Email・Calendar・Notion・Linear・Slack・GitHubなど |

Connectors は Model Context Protocol(MCP) に対応しており、拡張性があります。MCP対応ツールの詳細は「Mistral Studio Workflowsとは」も参照してください。

Work Modeのセーフガード

機密性の高い操作(メール送信・Slack投稿・レコード作成・削除)には承認ゲートが設けられており、実行前にユーザーへの確認を挟む仕組みになっています。意図しない操作を防ぐ重要な設計です。

Work Modeの現時点の制約(2026年5月時点)

制約 | 詳細 |

|---|---|

Memories 非対応 | プレビュー段階のため未実装 |

Code Interpreter 非対応 | 現時点で利用不可 |

途中でのモード変更不可 | Fast/Thinkモードへの途中切り替えができない(新規チャットが必要) |

Le Chat エージェント・Studio Workflowsと併用不可 | |

Free プランでの即日利用 | 段階的ロールアウト中のため要確認(公式ページ参照) |

⚠️ Work Modeは現在プレビュー段階です。機能・制限は今後変更される可能性があります。

Mistral Vibe CLI — GitHub PRを自動生成するコーディングエージェント

Mistral Vibe は、コマンドラインでコードベースを操作する自律型コーディングエージェントです。2026年4月29日のアップデートで、デフォルトモデルがDevstral 2からMistral Medium 3.5に変更されました。

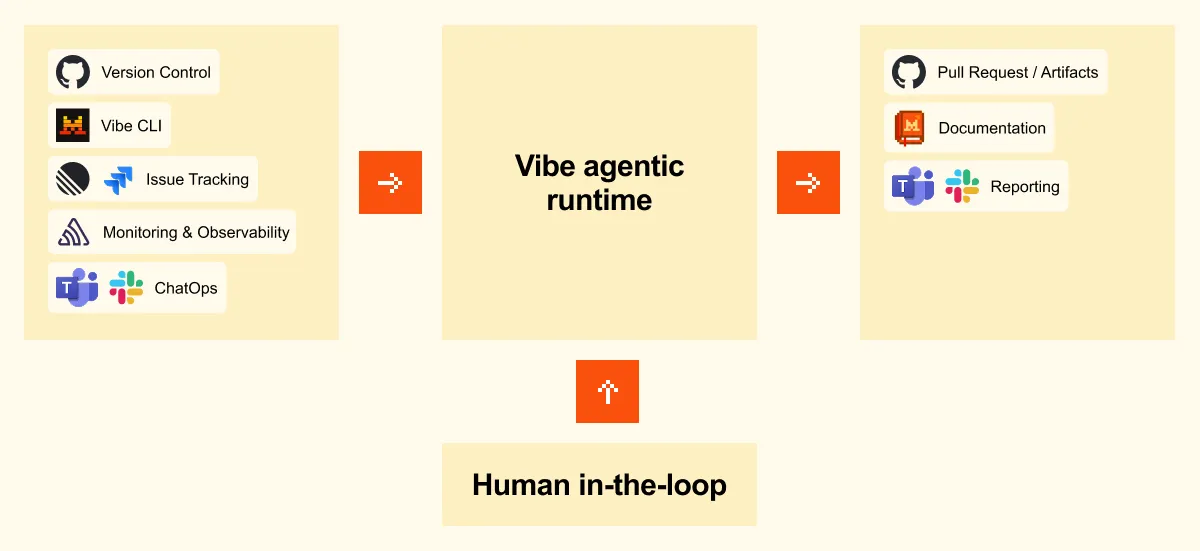

出典: Mistral AI 公式ドキュメント(Vibe CLI)

Vibe CLIの主な機能

機能 | 説明 |

|---|---|

ファイルの読み書き・パッチ適用 | 自然言語の指示でコードを編集 |

シェルコマンド実行(ステートフル) | 状態を保持したまま連続実行 |

Grep による再帰的コード検索 | コードベース全体を横断して検索 |

To-doリスト管理 | エージェントが自分の作業を追跡・管理 |

リモートエージェント | ローカルセッションをクラウドサンドボックスに転送 |

リモートエージェント(注目機能)

Vibe CLIの最大の新機能がリモートエージェントです。通常のローカルCLI操作をクラウドサンドボックスに転送し、以下を自律的に実行します。

- 広範囲なコード編集・依存関係のインストール・テスト実行を非同期で処理

- 処理完了後にGitHub プルリクエスト(PR)を自動作成(差分説明付き)

- ローカル端末を閉じても処理が継続し、完了後にブランチを受け取れる

大規模なリファクタリングや長時間のバッチ処理に向いており、「作業を投げて離席できる」エージェント型の開発体験を提供します。

インストール方法

# インストール・アップグレード

pip install mistral-vibe --upgrade

# 起動(起動後にモデルとして "mistral-medium-3.5" を選択)

vibeMistral Medium 3.5の強み

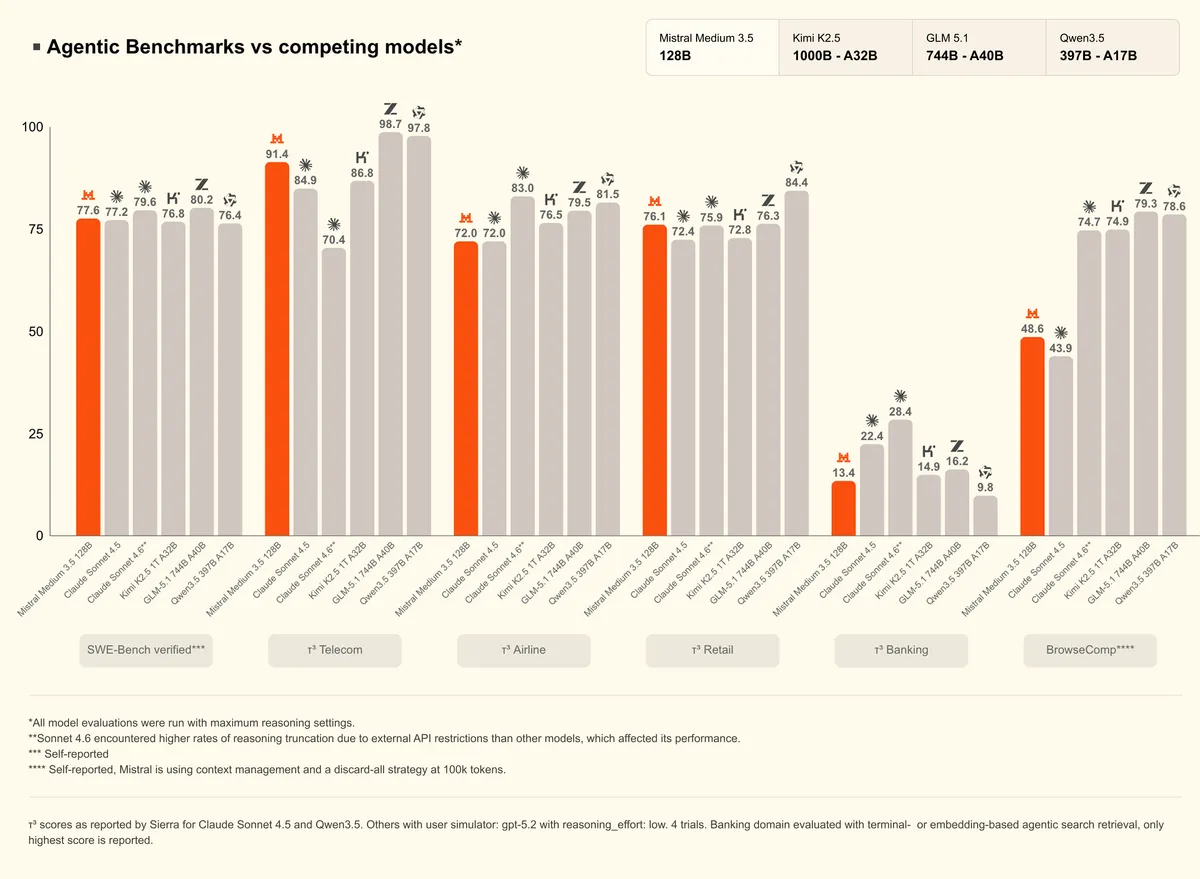

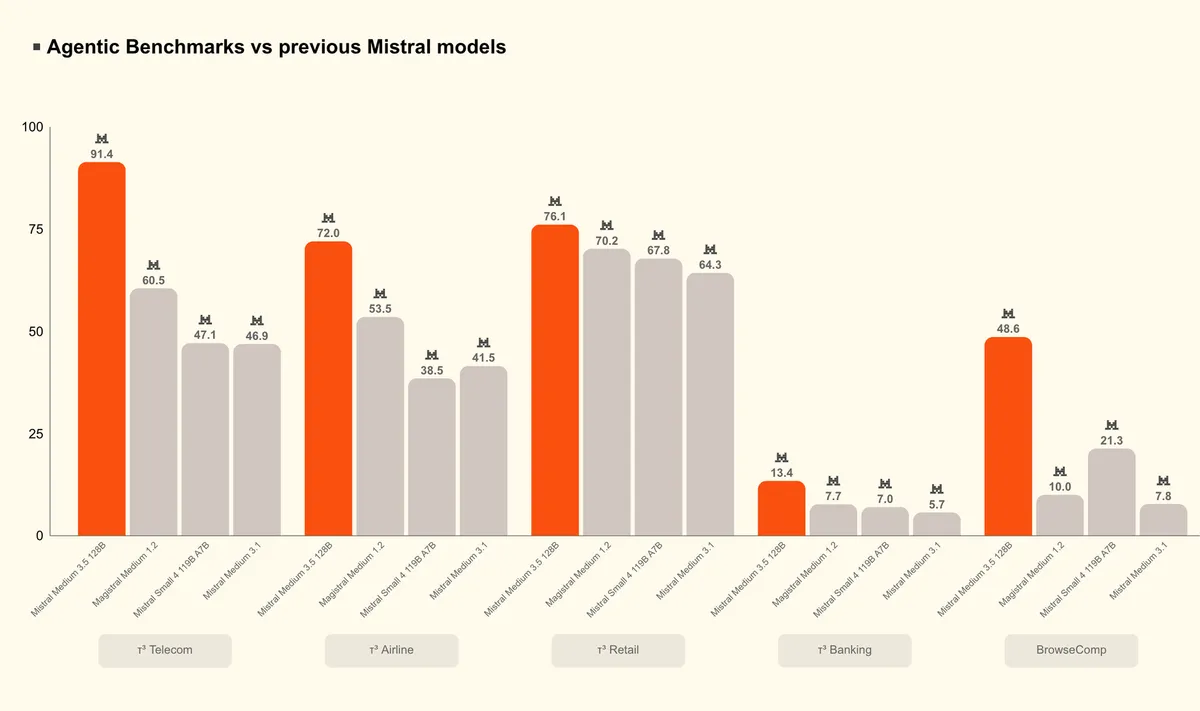

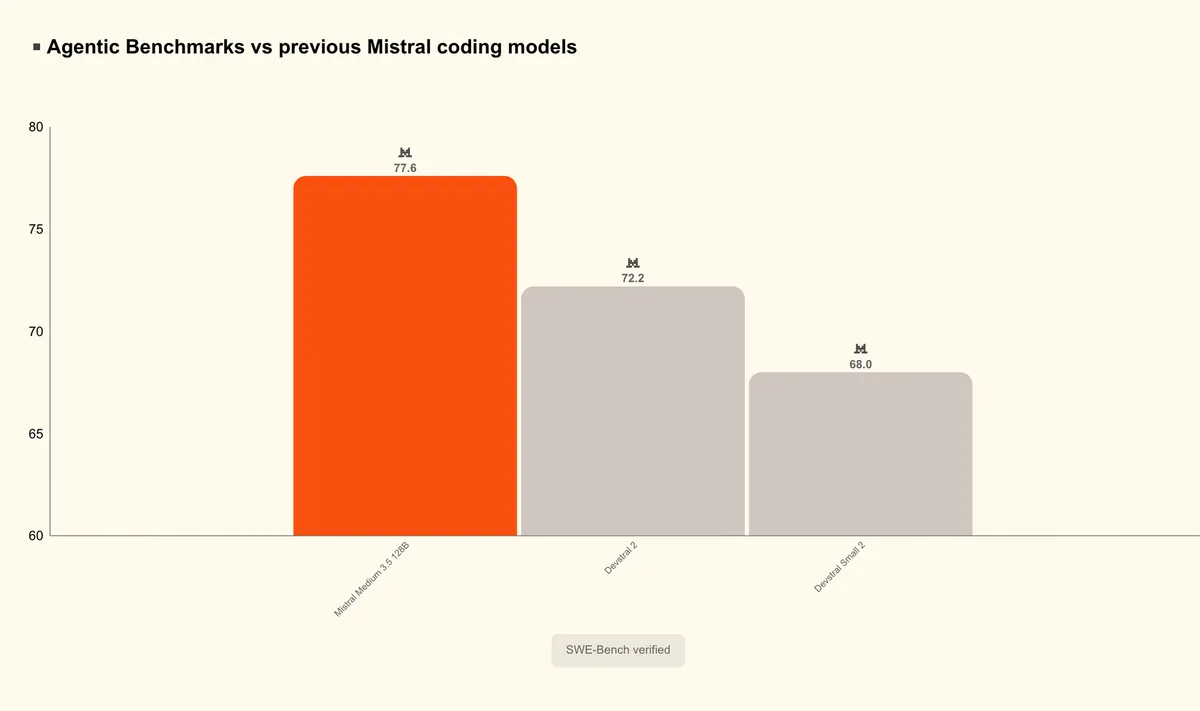

1. SWE-bench 77.6% — Claude Sonnet 4.5を超える

コーディングエージェント精度の業界標準指標である SWE-bench Verified で 77.6% を記録しています。前世代のDevstral 2が72.2%だったことと比較すると、5ポイント以上の大幅な改善です。

Claude Sonnet 4.5(77.2%)をわずかに上回り、Claude Sonnet 4.6(79.6%)とは約2ポイント差です。

2. API料金はClaude Sonnet 4.6の約半額

モデル | 入力($/1Mトークン) | 出力($/1Mトークン) |

|---|---|---|

Mistral Medium 3.5 | $1.50 | $7.50 |

Claude Sonnet 4.6 | $3.00 | $15.00 |

DeepSeek V4-Pro | $1.74 | $3.48 |

Claude Sonnet 4.6と比較すると入力・出力ともに約50%のコスト削減。月間100万トークンを処理する場合、年間換算で数十万円規模の差が生じる可能性があります。

3. Modified MITでセルフホスティング可能

Hugging Faceで公開されており、GPU 4台(FP8量子化適用時) から自社環境での実行が可能。Claude・GPT-4など主要クローズドモデルには不可能な「完全オンプレミス運用」を実現できます。

- FP8量子化:

mistralai/Mistral-Medium-3.5-128B - GGUF版:

unsloth/Mistral-Medium-3.5-128B-GGUF - 投機的デコーディング:

mistralai/Mistral-Medium-3.5-128B-EAGLE - Ollama:

ollama.com/library/mistral-medium-3.5 - ファインチューニング: Axolotl・Unsloth で対応

4. EU/GDPR準拠インフラ

Mistral AIはEU(フランス)本拠地のため、GDPR設計基準を採用しています。デフォルトでチャット内容がモデル学習に使用されない(データミニマイゼーション)設計で、EU顧客を持つ企業や規制業界での導入に強みがあります。NTTデータとのプライベートAI展開に向けた提携も確認されています。

5. τ³-Telecom 91.4% — エージェンティック能力

エージェント能力評価ベンチマーク τ³-Telecom で 91.4% を記録。複数ツールを横断した複雑なタスク実行能力の高さを示しています(Claude Sonnet 4.6のτ³-Telecomスコアは未公表)。

現時点での制約・できないこと

制約 | 詳細 |

|---|---|

画像生成不可 | 出力はテキストのみ。画像生成には別途ツールが必要 |

コンテキスト長がClaude Sonnet 4.6に劣後 | 256k vs 1Mトークン(Claude Sonnet 4.6)。極長文書処理には不利 |

SWE-benchでDeepSeek V4-Proに劣後 | 77.6% vs 80.6%(DeepSeek V4-Pro)。最高精度では2.5ポイント差 |

MMLU・GPQA・HumanEvalは未公表 | 公式から標準ベンチマークが非公開のため、汎用能力の客観比較が困難 |

大企業向けのModified MIT制限 | 高収益企業には追加の商用契約が必要な場合あり(閾値は未公表) |

セルフホストに高スペックGPUが必要 | 128B規模のためコンシューマGPUでの動作は困難。最低GPU 4台(FP8時) |

Le Chat日本語UI対応は未確認 | UI対応状況は公式情報がなく未確認(2026年5月時点) |

API料金・Le Chatプラン

API料金(2026年4月時点・公式発表)

区分 | 料金 |

|---|---|

入力トークン | $1.50 / 100万トークン |

出力トークン | $7.50 / 100万トークン |

バッチ処理や長期契約割引については公式から未発表。最新料金はMistral AI公式サイトで確認してください。

Le Chatプラン(Medium 3.5使用)

プラン | 月額 | Work Mode | 備考 |

|---|---|---|---|

Free | 無料 | Preview(段階的ロールアウト) | 基本機能 |

Pro | 要確認(公式ページ参照) | 利用可(Preview) | Medium 3.5 をデフォルト利用 |

Team | 要確認(公式ページ参照) | 利用可(Preview) | 組織向け機能 |

Enterprise | カスタム | 利用可(Preview) | カスタム契約 |

⚠️ Pro/Team/Enterpriseの月額料金は、2026年5月時点で公式から確認できていません。最新情報はchat.mistral.aiの料金ページで確認してください。

セルフホスティングのコスト感

GPU 4台(FP8量子化時)が最小要件。実際の運用では3レプリカ+EAGLEパイプライン構成が推奨されることもあり、初期インフラコストは高くなります。クラウドAPIとのコスト比較は月間処理量によって変わります。

使い方 — 3つのアクセス方法

方法1: Le Chat Web(最も手軽)

- chat.mistral.ai にアクセス

- アカウント作成・ログイン

- モデルに「Mistral Medium 3.5」を選択(デフォルトモデルとして採用済み)

- Work Modeを使う場合は、左側のモードセレクタから「Work」を選択

日常的なチャットや文書生成・分析はWebから無料で開始できます。

方法2: API利用(開発者向け)

APIはOpenAI互換形式のため、OpenAI SDKをそのまま利用できます。

import openai

client = openai.OpenAI(

api_key="your-mistral-api-key",

base_url="https://api.mistral.ai/v1"

)

response = client.chat.completions.create(

model="mistral-medium-3.5",

messages=[{"role": "user", "content": "コードレビューをしてください"}],

extra_body={"reasoning_effort": "high"} # 推論モード有効化

)

print(response.choices[0].message.content)APIキーはconsole.mistral.aiで取得できます。

方法3: Ollama経由でローカル実行

# Ollamaインストール後

ollama pull mistral-medium-3.5

ollama run mistral-medium-3.5⚠️ 128Bパラメータのため、コンシューマGPUでの動作は困難。実行には大容量のGPUメモリが必要です。

他モデルとの比較

項目 | Mistral Medium 3.5 | Claude Sonnet 4.6 | DeepSeek V4-Pro | Devstral 2(旧) |

|---|---|---|---|---|

SWE-Bench Verified | 77.6% | 79.6% | 80.6% | 72.2% |

τ³-Telecom | 91.4% | 未公表 | 未公表 | 未公表 |

コンテキスト長 | 256k | 1M | 未確認 | 未確認 |

入力料金($/1Mトークン) | $1.50 | $3.00 | $1.74 | 未確認 |

出力料金($/1Mトークン) | $7.50 | $15.00 | $3.48 | 未確認 |

アーキテクチャ | Dense 128B | 非公開 | MoE 1.6T | 非公開 |

セルフホスト | ✅(GPU 4台〜) | ❌ | 制限付き | 未確認 |

オープンウェイト | ✅(Modified MIT) | ❌ | 制限付き | ✅ |

画像入力 | ✅ | ✅ | ❌ | ❌ |

GDPR/EU拠点 | ✅ | ❌(米国) | ❌(中国) | ✅ |

用途別の推奨モデル

優先事項 | 推奨モデル | 理由 |

|---|---|---|

コーディング最高精度 | DeepSeek V4-Pro | SWE-bench 80.6% |

コスト効率(中〜大規模API) | Mistral Medium 3.5 | Sonnet比約半額でSonnet 4.5超え |

超長文書処理(1M+ トークン) | Claude Sonnet 4.6 | 1Mコンテキスト対応 |

セルフホスティング(現実的なGPU台数) | Mistral Medium 3.5 | GPU 4台〜で動作 |

GDPR / EU データ主権 | Mistral Medium 3.5 | EU本拠地、GDPRネイティブ設計 |

エンタープライズ統合(Work Mode等) | Mistral Medium 3.5 | MCP対応コネクター多数 |

こんな人におすすめ / おすすめしない人

Mistral Medium 3.5がおすすめの人

- コスト重視のAPIユーザー: Claude Sonnet 4.6と近い精度を約半額で使いたい開発者

- コーディングエージェントを試したい人: SWE-bench 77.6%・Vibe CLIのPR自動生成など実務用途に

- セルフホストが必要な組織: 社内データをクラウドに送れない企業(GPU 4台〜で現実的)

- EU・欧州顧客向けサービスを提供する企業: GDPR準拠インフラが必要な場面

- Work Modeで業務自動化を試したい人: メール・カレンダー・Slackを横断したタスク自動化

- マルチモーダルが必要な開発者: 画像入力+テキスト出力を安価なAPIで使いたい人

Mistral Medium 3.5がおすすめしない人

- コーディング精度を最大化したい人: DeepSeek V4-Pro(80.6%)やClaude Sonnet 4.6(79.6%)の方が精度面で上

- 1Mトークン超えの超長文処理が必要な人: 256kコンテキストでは足りない(Claude Sonnet 4.6が1M)

- 日本語UIで直感的に使いたい人: Le ChatのUI日本語対応が未確認のため他ツールの方が使いやすい可能性あり

- 無料枠で大量処理したい人: Free プランの利用制限・Work Mode即日利用可否が未確認

- 大企業での商用利用を即時開始したい人: Modified MITの高収益企業向け制限を法務確認してから導入を推奨

セキュリティ・ライセンスの注意点

Modified MIT Licenseの企業導入時の注意

Mistral Medium 3.5 のライセンスはModified MITです。通常の MIT や Apache 2.0(Mistral Large 3・Small 4が採用)とは異なる条件が含まれており、高収益を上げている大企業での使用には追加の商用契約が必要な場合があります。

具体的な収益閾値は未公表のため、導入前に必ず法務部門で原文を確認することを推奨します。スタートアップや個人開発者のケースでは通常の MIT に近い自由度がありますが、大規模な商用展開では確認が必要です。

リモートエージェント(Vibe)利用時のデータ取り扱い

Vibe CLI のリモートエージェントはMistral AIのクラウドインフラ上でコードを処理します。機密ソースコード・顧客データを含むコードベースを使用する場合は、以下を確認してください。

- 自社のデータ管理ポリシーとの整合性

- 規制業界(金融・医療など)での利用時はコンプライアンス審査を先行させる

- Work Modeの承認ゲートを必ず有効に保ち、意図しない操作を防ぐ

GDPR・欧州データ主権の観点

Mistral AIはEU本拠地(フランス)のため、GDPRの設計基準を採用しています。デフォルトでチャット履歴がモデルの再学習に使用されない設計(データミニマイゼーション)。OpenAI・Anthropicなど米国系プロバイダーとは法域が異なるため、EU顧客への製品提供・GDPR準拠が求められる環境でのアドバンテージがあります。

セルフホスト時の注意

- GGUFの旧バージョン(修正前)に長いコンテキストでの性能低下問題が確認されています。常に最新版を使用してください

- Hugging Face でのオープンウェイト公開のため、ダウンロード自体は誰でも可能ですが、商用利用時はライセンスの確認が必要

よくある質問(FAQ)

Q: Mistral Medium 3.5は日本語で使えますか?

公式情報では日本語を含む30言語以上に対応しています(2026年4月時点)。ただし、Le ChatのWebインターフェースの日本語UI対応については公式情報が未確認のため、APIベースでの日本語処理利用を推奨します。

Q: Le Chat Work ModeはFreeプランでも使えますか?

2026年4月29日時点で「段階的ロールアウト中(Preview)」とされており、Freeプランでの即日利用可否は公式から未確認です。最新状況はchat.mistral.aiで確認してください。

Q: ChatGPT・Claude・Geminiと比べてどれがいいですか?

コスト効率を重視するAPIユーザーにはMistral Medium 3.5が有力な選択肢です。ただし極長コンテキスト(1M+)が必要ならClaude Sonnet 4.6、コーディング最高精度ならDeepSeek V4-Proと用途で使い分けることを推奨します。

Q: セルフホストするのに最低限何が必要ですか?

FP8量子化を適用した場合でGPU 4台が最小要件とされています。ただし128Bパラメータの規模のため、実用的な推論速度を出すにはそれ以上のリソースが必要な場合があります。一般的なコンシューマGPU(RTX 4090単体など)では動作困難です。

Q: DeepSeek V4-ProよりSWE-benchスコアが低いのはなぜですか?

DeepSeek V4-Proは1.6Tパラメータ(MoE構造)で実行時には約37Bのアクティブパラメータが動作するアーキテクチャです。Medium 3.5はDense 128Bであり、性質が異なります。DeepSeek V4-ProはH100 GPU 8台以上が必要で、セルフホストの現実的なハードルが高い点も考慮が必要です。

Q: Mistral Vibeのリモートエージェントは安全ですか?

リモートエージェントはMistral AIのインフラ上で動作するため、機密コードを送信する場合はリスクがあります。オープンソースコードや非機密プロジェクトでの利用が推奨されます。規制業界での利用は事前にコンプライアンス審査が必要です。

まとめ

Mistral Medium 3.5は、コーディング・推論・チャットを128Bパラメータの単一モデルに統合した、2026年4月時点で最も注目度の高いオープンウェイトLLMの一つです。

Mistral Medium 3.5が提供する核心的な価値は3点です:

- コスト効率: Claude Sonnet 4.6比約50%安のAPIでSWE-bench 77.6%の精度(Sonnet 4.5超え)

- オープン性: Modified MITでGPU 4台〜のセルフホストが可能。データを外部に出せない環境での運用に対応

- EU/GDPR対応: フランス拠点のGDPRネイティブ設計。欧州データ主権が求められる環境に強い

一方で、コンテキスト長(256k)・画像生成非対応・Le Chat日本語UI未確認などの制約もあります。用途と要件を整理した上で、他モデルとのコスト比較を行ってから導入判断することを推奨します。

Mistral AI全体のモデルラインナップについては「Mistral AIとは」を、エンタープライズ向けのMCPオーケストレーション機能については「Mistral Studio Workflowsとは」もあわせてご覧ください。

この記事の著者

AI革命

編集部

AI革命株式会社の編集部です。最新のAI技術動向から実践的な導入事例まで、企業のデジタル変革に役立つ情報をお届けしています。豊富な経験と専門知識を活かし、読者の皆様にとって価値のあるコンテンツを制作しています。

最新記事

AIエージェントとは?仕組み・種類・活用事例・代表ツールをわかりやすく解説【2026年版】

2026/03/26

ChatGPT vs Gemini 比較|2026年版・機能/料金/日本語/セキュリティで違いを整理

2026/04/18

XChatとは?E2E暗号化+Grok内蔵AIメッセンジャーの機能・料金・安全性を徹底解説

2026/04/20

Meta Llama 4 Maverickとは?17B active/400B total・128エキスパートMoEを徹底解説

2026/04/22

Claudeとは?機能・料金・使い方・ChatGPTとの違いをわかりやすく解説

2026/03/26

Grokとは?Agent Mode・Grok Imagine使い方・料金【xAI最新】

2026/04/18