AIエージェントフレームワーク比較12選|用途・言語・料金別の選び方【2026年最新】

AIエージェントフレームワークは、LLMを活用した自律型AIエージェントを効率的に開発するためのソフトウェア基盤です。2026年4月時点で主要なフレームワークは12種以上あり、開発言語・ユースケース・チーム体制によって最適な選択肢は大きく異なります。

この記事でわかること:

- 主要12フレームワークの機能・料金・対応言語の横並び比較

- 用途別・言語別の選び方フローチャート

- MCP対応状況やセキュリティ観点の比較

- フレームワークごとの向き不向き

こんな方に向けた記事です:

- AIエージェント開発のフレームワーク選定で迷っている開発者・技術リーダー

- Python/TypeScript/.NETのどれで開発すべきか判断したい方

- プロトタイプから本番運用への移行を見据えてフレームワークを評価中の方

迷ったらまず「AIエージェントとは?」で基礎を押さえてから、この記事で具体的なフレームワーク選定に進むのがおすすめです。

AIエージェントフレームワークとは?なぜ必要なのか

AIエージェントフレームワークとは、LLM(大規模言語モデル)を使って自律的に判断・行動するAIエージェントを構築するための開発基盤です。ツール呼び出し、メモリ管理、マルチエージェント協調、ワークフロー制御など、ゼロから実装すると膨大な工数がかかる機能をあらかじめ提供しています。

フレームワークなしでもLLM APIを直接叩いてエージェントを作ることは可能ですが、以下の課題に直面します。

- ツール連携の実装: 外部API・データベース・ファイル操作との接続をすべて自前で実装する必要がある

- 状態管理: 複数ステップにまたがるタスクの状態保持・復元を自前で設計する必要がある

- エラーハンドリング: LLMの応答失敗・ツール実行失敗時のリトライ・フォールバック処理

- オブザーバビリティ: エージェントの行動ログ・コスト追跡・品質評価の仕組み

フレームワークを使うことで、これらの共通課題を解決済みの基盤の上にエージェントロジックだけを実装でき、開発速度と品質の両方が向上します。

主要12フレームワークの総合比較表

2026年4月時点の主要フレームワークを一覧で比較します。まずは全体像を把握し、その後で個別の詳細を確認してください。

基本情報・対応言語・料金の比較

フレームワーク | 開発元 | 対応言語 | GitHub Stars | OSS | クラウド版料金 |

|---|---|---|---|---|---|

LangChain / LangGraph | LangChain, Inc. | Python, TypeScript | 132k / 28.1k | MIT | LangSmith Plus: $39/席/月〜 |

CrewAI | CrewAI, Inc. | Python | 46.9k | MIT | Cloud: 無料〜$25/月〜 |

AutoGen / MS Agent Framework | Microsoft | Python, .NET | 54.7k / 27.5k | MIT | 無料(Azure利用料は別) |

OpenAI Agents SDK | OpenAI | Python, TypeScript | 20.5k | MIT | 無料(API利用料は別) |

Claude Agent SDK | Anthropic | Python, TypeScript | — | OSS | 無料(API利用料は別) |

Google ADK | Python, TS, Java, Go | 約17k | Apache 2.0 | 無料(Vertex AI利用料は別) | |

Dify | LangGenius | ノーコード(GUI) | 134k | Apache 2.0 | Cloud: 無料〜$59/月〜 |

Mastra | Mastra AI | TypeScript | 22.5k | MIT | 無料 |

Vercel AI SDK | Vercel | TypeScript | 23.2k | Apache 2.0 | AI Gateway: $5無料枠あり |

PydanticAI | Pydantic | Python | 16k | MIT | 無料 |

LlamaIndex | LlamaIndex | Python, TypeScript | 48.2k | OSS | LlamaCloud: 有料 |

Amazon Bedrock Agents | AWS | Python, TS(SDK経由) | — | マネージド | 従量課金 |

※ GitHub Stars数は2026年4月時点の概算値です。急速に変動するため参考値としてご覧ください。

機能の比較

機能 | LangGraph | CrewAI | AutoGen | OpenAI SDK | Claude SDK | Google ADK | Dify | Mastra | Vercel AI SDK | PydanticAI | LlamaIndex | Bedrock |

|---|---|---|---|---|---|---|---|---|---|---|---|---|

マルチエージェント | ◎ | ◎ | ◎ | ○ | △ | ◎ | ○ | ○ | ○ | △ | ○ | ◎ |

ワークフロー制御 | ◎ | ○ | ○ | △ | △ | ○ | ◎(GUI) | ○ | △ | △ | ○ | ○ |

RAG | ○ | ○ | ○ | ○ | △ | ○ | ◎ | ○ | ○ | ○ | ◎ | ◎ |

MCP対応 | ○ | ○ | — | ◎ | ◎ | ○ | ○ | ◎ | ◎ | ◎ | — | — |

Human-in-the-Loop | ◎ | ○ | ◎ | ○ | ○ | ◎ | ○ | ◎ | ○ | ○ | ○ | ○ |

LLM切替 | ◎ | ◎ | ◎ | △ | △ | △ | ◎ | ◎ | ◎ | ◎ | ◎ | ◎ |

ノーコード | × | ○ | ○ | × | × | × | ◎ | × | × | × | × | △ |

音声エージェント | △ | × | × | ◎ | × | ◎ | × | × | ○ | × | × | × |

オブザーバビリティ | ◎ | ○ | ◎ | ○ | ○ | ◎ | ○ | ○ | ○ | ◎ | ○ | ◎ |

(◎=非常に強い ○=対応 △=限定的 ×=非対応 —=未確認)

用途別おすすめフレームワークの選び方

フレームワーク選定で最も重要なのは「何を作るか」と「チームの技術スタック」です。以下の判断フローで絞り込んでいきましょう。

判断フロー: あなたに合うフレームワークは?

Step 1: チームの主要言語は?

- Python → Step 2へ

- TypeScript/JavaScript → Mastra・Vercel AI SDK・OpenAI Agents SDK から選択

- .NET(C#) → Microsoft Agent Framework(AutoGen)

- Java / Go → Google ADK(4言語対応で唯一Java/Goをサポート)

- ノーコードで作りたい → Dify

Step 2(Python): エージェントの複雑さは?

- 複雑なマルチエージェント・状態管理が必要 → LangGraph

- ロールベースのチーム協調・プロトタイプ重視 → CrewAI

- RAG・文書検索が中心 → LlamaIndex

- 型安全・テスタブルな設計を重視 → PydanticAI

- 特定LLMプロバイダーに集中 → OpenAI Agents SDK / Claude Agent SDK / Google ADK

Step 3: クラウド環境は?

- AWS中心 → Amazon Bedrock Agents

- Azure/.NET中心 → Microsoft Agent Framework

- Google Cloud中心 → Google ADK

用途別おすすめ一覧

用途 | おすすめフレームワーク | 理由 |

|---|---|---|

本番運用レベルの複雑なワークフロー | LangGraph | グラフベース制御・チェックポイント・永続化が最も充実 |

マルチエージェントのプロトタイプ | CrewAI | ロールベース設計で数行のコードから開始できる |

Next.js/Reactアプリへの統合 | Vercel AI SDK | ストリーミングUI・React Hooks対応で最も相性が良い |

TypeScriptのバックエンド開発 | Mastra | Server Adapters対応、認証・権限管理も標準搭載 |

RAG・社内ナレッジ検索 | LlamaIndex | 90+ファイル形式対応、マルチソース検索に特化 |

非エンジニアのAI活用 | Dify | ビジュアルUI、ドラッグ&ドロップでワークフロー構築 |

OpenAIモデル中心+音声対応 | OpenAI Agents SDK | Realtime Agents対応、学習コストが最低レベル |

Claudeモデル中心の自動化 | Claude Agent SDK | Claude Codeの能力をプログラマティックに利用 |

多言語チーム(Java/Go含む) | Google ADK | Python/TS/Java/Goの4言語で唯一の選択肢 |

インフラ管理を最小化したい企業 | Amazon Bedrock Agents | フルマネージド、ガードレール標準搭載 |

型安全・テスト重視のPython開発 | PydanticAI | DIパターンでテスタブル、Pydanticベース |

Microsoftエコシステムの企業 | AutoGen / MS Agent Framework | .NET対応、Semantic Kernel統合 |

各フレームワークの詳細解説

LangChain / LangGraph — エコシステム最大の定番

LangChainはLLMアプリ開発の事実上の標準であり、プラグインとインテグレーションが最も豊富です。LangGraphはその上位レイヤーとして、グラフ構造(ノード+エッジ)でエージェントワークフローを精密制御できるフレームワークです。

強み:

- チェックポイント、タイムトラベルデバッグ、Human-in-the-Loop対応

- LangSmithによるトレース・評価・モニタリングが充実

- v1.1で型安全ストリーミング・Pydantic自動変換を追加

- MCP対応済み、Deploy CLIでワンステップデプロイ

弱み:

- 抽象化が多層で学習コストが高い

- 小規模タスクにはオーバーエンジニアリングになりがち

- LangChain本体の頻繁なAPI変更(v1.0で安定化したものの、過去の印象が残る)

料金: OSS無料。LangSmith Developer: 無料(5,000トレース/月)、Plus: $39/席/月、Enterprise: 要問合せ。LangGraph Platform: Plus $0.001/ノード実行 + スタンバイ時間課金

CrewAI — マルチエージェントの手軽さNo.1

CrewAIは「ロール(役割)ベース」のマルチエージェント設計が特徴で、プロトタイピングの速さは業界トップクラスです。

強み:

- 順次型・階層型のプロセス制御をコード数行で実装可能

- CrewAI Studioでノーコードビルダーも提供

- 認定開発者10万人超のコミュニティ

弱み:

- 条件分岐・ループなど細かいワークフロー制御はLangGraphに劣る

- Pythonのみ対応

- クラウド版は実行数制限があり、大規模利用時にコストが増大しやすい

料金: OSS無料。Cloud: Basic無料(50実行/月)、Professional $25/月(100実行/月)、Enterprise: 要問合せ

AutoGen / Microsoft Agent Framework — エンタープライズ向け統合基盤

Microsoftが開発するAutoGenは、非同期メッセージベースのエージェント間通信が特徴です。現在、Semantic Kernelと統合した「Microsoft Agent Framework」への移行が進行中です。

強み:

- Python/.NET間のインターオペラビリティ

- OpenTelemetry対応のメトリクス追跡

- AutoGen Studio(ローコードUI)でプロトタイピング可能

- GitHub Copilot SDK統合(2026年1月〜)

弱み:

- AutoGen → Microsoft Agent Frameworkへの移行期でドキュメントが分散気味

- 0.2 → 0.4 での大幅API変更があった

- Microsoft Agent FrameworkはまだRC段階(2026年2月時点)

料金: 完全無料(OSS)。Azure利用料は別途。

OpenAI Agents SDK — 軽量・学習コスト最低

OpenAI Agents SDKは、旧Swarmの後継として本番運用に対応した軽量フレームワークです。極めて少ない抽象化で、すぐにエージェント開発を始められます。

強み:

- Handoffs(エージェント間委譲)が簡潔

- ガードレール(安全性チェック)組み込み

- Realtime Agents(音声エージェント、gpt-realtime-1.5対応)

- any-llm adapterで他社モデルも利用可能(ただし最適化はOpenAI向け)

弱み:

- OpenAIモデルに最適化されており、他社モデルはアダプター経由

- グラフベースの複雑なワークフロー制御には非対応

- 状態永続化はLangGraphほど充実していない

料金: SDK無料。OpenAI APIの利用料は別途。

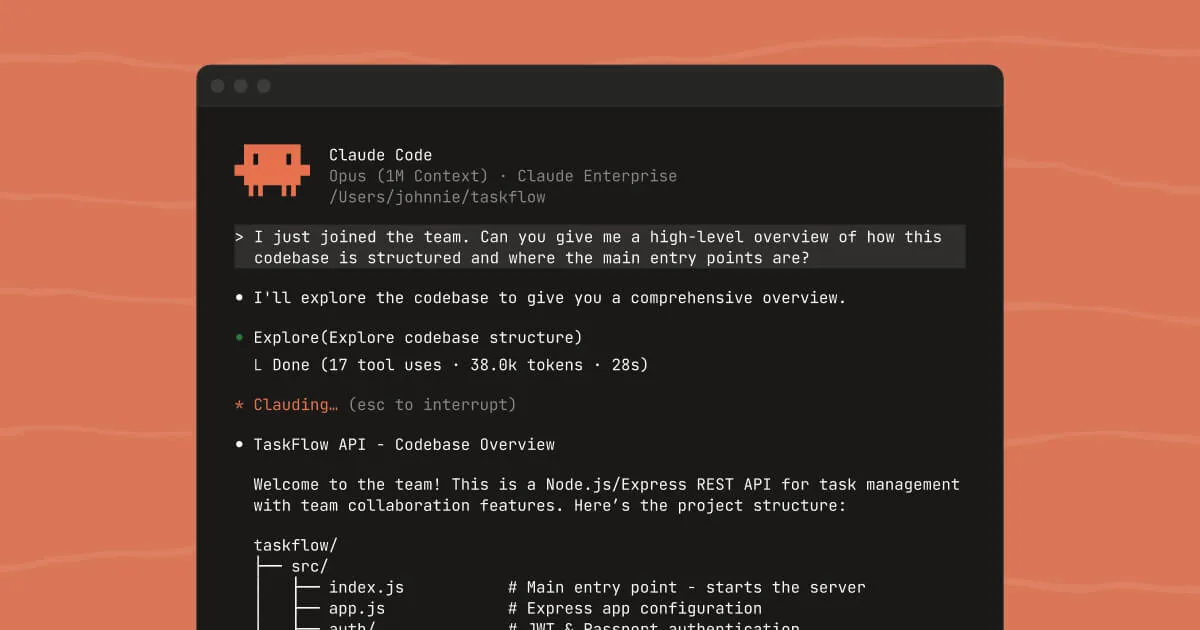

Claude Agent SDK — コーディングエージェント特化

Anthropicが提供するClaude Agent SDKは、Claude Codeの能力をプログラマティックに利用できるフレームワークです。

強み:

- コードベース理解、ファイル編集、コマンド実行に強い

- カスタムツール(インプロセスMCPサーバー)対応

- AWS Bedrock・Google Vertex AI・Azure経由でも利用可能

- task_progressイベントでリアルタイム進捗通知

弱み:

- Claudeモデル専用

- 汎用マルチエージェントフレームワークとしてはまだ発展途上

- 2026年登場でコミュニティ規模は小さい

料金: SDK無料。Anthropic APIの利用料は別途。

Google ADK — 最多4言語対応のマルチプラットフォーム

Google ADK(Agent Development Kit)は、Python・TypeScript・Java・Goの4言語に対応する唯一のフレームワークです。A2A(Agent-to-Agent)プロトコルのネイティブサポートも注目ポイントです。

強み:

- 4言語対応で多言語チームに最適

- Gemini Live APIとのリアルタイム双方向ストリーミング

- A2Aプロトコル対応(エージェント間通信の標準化)

- OpenTelemetry統合、エージェント評価ツール内蔵

弱み:

- Geminiモデルに最適化(他モデルは限定的)

- Google Cloudへのロックインリスク

- LangChain等と比べコミュニティ規模がまだ発展途上

料金: SDK無料。Google Cloud / Vertex AIの利用料は別途。

Dify — ノーコードで最も完成度が高い

Difyは、ノーコードのビジュアルワークフロービルダーで、非エンジニアでもAIエージェントやRAGアプリを構築できるプラットフォームです。GitHub Stars 134kはこの領域で最大級です。

強み:

- ドラッグ&ドロップでワークフロー設計

- RAGパイプライン・エージェント・モデル管理を統合した「オールインワン」

- プラグインマーケットプレイスで拡張可能

- セルフホスト可能(Docker Compose対応)

- 学生・教育者は無料

弱み:

- コードレベルの細かい制御は限定的

- 大規模・複雑なエージェントロジックには不向き

- セルフホスト運用にはインフラ知識が必要

料金: セルフホスト無料。Cloud: Sandbox無料、Professional $59/月、Team $159/月、Enterprise: 要問合せ。

Mastra — TypeScriptファーストの新鋭

Mastraは、Gatsbyチーム出身の開発者がY Combinator W25で立ち上げた、TypeScriptファーストのAIエージェントフレームワークです。2026年1月のv1.0 GAリリース以降、急成長中です。

強み:

- 40+プロバイダーを統一インターフェースで接続

- Server Adapters(Express/Hono/Fastify/Koa)でHTTPエンドポイント自動公開

- Okta統合、RBAC、エンタープライズ認証に対応

- Human-in-the-Loop、ワークフロー中断・再開

- 週30万npm DL

弱み:

- TypeScriptのみ(Python非対応)

- 2026年登場で歴史が浅い

- 安定性・長期サポートの実績がまだ少ない

料金: 完全無料(OSS)。

Vercel AI SDK — フロントエンド統合の決定版

Vercel AI SDKは、TypeScriptのAIツールキットとして最も広く使われており、React/Next.js/Svelte/Vue/Solidに対応しています。AI SDK v6でAgent抽象化が導入されました。

強み:

- Agent抽象化(v6)でモデル・指示・ツールを定義して再利用可能

- AI Gateway: 100+モデルに統一APIでアクセス(ゼロマークアップ)

- 型安全なUIストリーミング、構造化出力

- MCP対応、ツール実行承認、DevTools

- 月間2,000万DL、Fortune 500企業採用

弱み:

- フロントエンド/Webアプリ寄りの設計

- バックエンド専用の重いエージェントワークフローにはLangGraphほど向かない

- Vercelプラットフォームとの結合度がやや高い

料金: SDK無料。AI Gateway: $5/月の無料クレジット付き。

PydanticAI — 型安全のPythonエージェント

PydanticAIは、FastAPIのバリデーションライブラリと同じチームが開発する「FastAPIのようなAIエージェント開発」がコンセプトのフレームワークです。

強み:

- Pydanticベースの型安全な構造化出力

- 依存性注入(DI)パターンでテスタブルな設計

- 全主要LLMプロバイダー対応(15+)

- Logfire連携によるオブザーバビリティ

- pydantic-evalsでオンライン評価基盤

弱み:

- マルチエージェント協調はCrewAI/AutoGenほど充実していない

- ワークフロー制御はLangGraphに劣る

- 比較的新しいため情報・事例がまだ少ない

料金: 完全無料(OSS)。

LlamaIndex — RAG・文書処理に特化

LlamaIndexは、RAG(検索拡張生成)とドキュメント処理に特化したフレームワークです。300+のインテグレーションと90+のファイル形式対応は業界随一です。

強み:

- 画像・表・手書きを含む90+ファイル形式に対応した文書パース

- Workflowsで非同期イベント駆動型エージェント構築

- マルチドキュメントエージェント(ベクターDB + SQL + API横断)

弱み:

- RAG/検索に特化しており、汎用エージェントフレームワークとしての機能は限定的

- 複雑なマルチエージェント協調はCrewAI/AutoGenの方が得意

料金: OSS無料。LlamaCloud(マネージドRAG)は別途料金。

Amazon Bedrock Agents — AWSマネージドの安心感

Amazon Bedrock Agentsは、AWSのマネージドサービスとしてインフラ管理不要でエージェントを構築・運用できます。

強み:

- Bedrock Guardrailsで安全性を組み込み

- マルチエージェント協調(Supervisor Agent)

- AgentCore: 品質評価・ポリシー制御(2026年3月GA)

- 動的コード生成・実行(セキュア環境)

弱み:

- AWS環境専用(ベンダーロックイン)

- OSSではなく、カスタマイズの自由度が限定的

- 料金体系が複雑(モデル利用料 + 各サービス料金の合算)

料金: 従量課金。エージェント自体は無料、基盤モデル利用料 + オプション機能は別途。

2026年の注目トレンド

AIエージェントフレームワークの選定において、2026年に押さえておくべきトレンドを整理します。

MCP(Model Context Protocol)が事実上の標準に

Anthropicが策定したオープン標準「MCP」は、エージェントとツール・データソースの接続を標準化するプロトコルです。「AIのUSB-C」とも呼ばれ、2026年時点でLangGraph、OpenAI Agents SDK、Mastra、Vercel AI SDK、PydanticAIなど主要フレームワークが対応済みです。

MCP対応フレームワークを選べば、ツール連携の実装コストが大幅に下がります。フレームワーク選定時にはMCP対応状況を確認しておくのが現時点では賢明です。

プロバイダー固有SDK vs 汎用フレームワークの二極化

OpenAI Agents SDK、Claude Agent SDK、Google ADKといったLLMプロバイダー自身が提供するSDKが相次いで成熟しています。これらは特定モデルへの最適化が強みですが、モデル切替の柔軟性は低くなります。

一方、LangGraph、CrewAI、PydanticAIなどの汎用フレームワークはマルチプロバイダー対応が強みです。将来的にLLMプロバイダーを切り替える可能性がある場合は、汎用フレームワークが安全です。

TypeScriptエコシステムの急成長

これまでAIエージェント開発はPython一強でしたが、2026年はMastra(22.5k stars)やVercel AI SDK(23.2k stars)がTypeScript/Node.js開発者向けに急成長しています。Next.jsやReactとの統合が求められるWebアプリケーション開発では、TypeScriptフレームワークが第一選択肢になりつつあります。

A2A(Agent-to-Agent)プロトコルの登場

Google ADKがネイティブサポートするA2Aプロトコルは、異なるフレームワーク間でのエージェント通信を標準化する動きです。現時点ではまだ普及途上ですが、マルチフレームワーク環境でのエージェント連携が将来的に容易になる可能性があります。

セキュリティ・ガバナンス観点の比較

エンタープライズ環境でのフレームワーク選定では、機能面だけでなくセキュリティ・ガバナンス観点の比較も重要です。

観点 | 対応が充実しているフレームワーク | 備考 |

|---|---|---|

ガードレール(安全性チェック) | OpenAI Agents SDK、Amazon Bedrock | 標準搭載。他はカスタム実装が必要 |

SOC2 / HIPAA対応 | CrewAI Enterprise、Amazon Bedrock | 認証を明示しているのはこの2つ |

データプライバシー(セルフホスト) | LangGraph、CrewAI、Dify、Mastra | OSSのためオンプレミス/自社クラウドで運用可能 |

サンドボックス実行 | Amazon Bedrock、AutoGen | エージェントのコード実行をセキュアな環境で隔離 |

認証・権限管理 | Mastra(Okta/RBAC)、Bedrock(IAM) | フレームワークレベルで認証を統合 |

共通のセキュリティ注意事項

どのフレームワークを選んでも、以下のリスクへの対策は必須です。

- ツール実行のリスク: エージェントにBash実行・ファイル操作権限を与える場合、サンドボックス環境での実行が推奨される

- プロンプトインジェクション: エージェントが外部データを読み取る場合、悪意あるプロンプト注入への対策が必要

- データプライバシー: クラウドサービス利用時はデータの送信先・保存先を確認し、機密データはセルフホスト版を検討する

セキュリティ全般については「生成AIのセキュリティリスクと対策」も参照してください。

フレームワーク乗り換えのコストと注意点

フレームワーク選定で見落としがちなのが、乗り換えコストです。一度選んだフレームワークからの移行は以下の理由で困難になります。

- ツール定義の形式が異なる: 各フレームワーク固有のツール定義形式で実装するため、そのまま別フレームワークに持ち込めない

- メモリ・状態管理の実装が異なる: チェックポイントや永続化の仕組みがフレームワーク固有

- デプロイパターンが異なる: LangGraph PlatformとDify Cloudでは運用方法がまったく違う

そのため、プロトタイプ段階から本番運用を見据えたフレームワーク選定が重要です。「まずCrewAIでPoCを作り、本番はLangGraphで」という戦略はコストが高くなりがちです。

こんな方におすすめ / おすすめしないケース

こんな方におすすめ

状況 | おすすめのフレームワーク |

|---|---|

Pythonチームで複雑なワークフローを本番運用したい | LangGraph |

まずはマルチエージェントの動作を素早く試したい | CrewAI |

TypeScript/Next.jsのWebアプリにAIエージェントを組み込みたい | Vercel AI SDK / Mastra |

非エンジニアがAI活用の仕組みを作りたい | Dify |

OpenAIのAPIだけで手軽にエージェントを作りたい | OpenAI Agents SDK |

RAG・社内文書検索に特化したい | LlamaIndex |

AWS環境でインフラ管理なしにエージェントを運用したい | Amazon Bedrock Agents |

型安全・テスト容易性を重視するPython開発者 | PydanticAI |

Java/Goチームでエージェント開発したい | Google ADK |

おすすめしないケース

状況 | 避けた方が良いフレームワーク | 理由 |

|---|---|---|

小規模タスクを手軽に自動化したいだけ | LangGraph | 過剰な複雑さ。OpenAI Agents SDKの方が手軽 |

Pythonが必須の環境 | Mastra | TypeScript専用 |

LLMプロバイダーを頻繁に切り替えたい | OpenAI SDK / Claude SDK / Google ADK | プロバイダーロックイン |

コードを一切書きたくない | LangGraph / PydanticAI / Mastra | コードファーストの設計 |

AWS以外のクラウドを使いたい | Amazon Bedrock Agents | AWSロックイン |

長期安定運用の実績を重視する | Mastra / Claude Agent SDK | 2026年登場で実績が浅い |

よくある質問(FAQ)

Q1. フレームワークを使わずにLLM APIを直接叩くのと何が違う?

直接APIを叩く場合、ツール連携・状態管理・エラーハンドリング・オブザーバビリティをすべて自前で実装する必要があります。単発の質問応答であればAPI直接利用で十分ですが、複数ステップのタスク実行やツール連携が必要なエージェント開発では、フレームワークの利用が開発効率を大幅に向上させます。

Q2. MCP対応のフレームワークを選ぶべき?

現時点では、MCP対応を選定の決定的な基準にする必要はありませんが、今後のツール連携の標準化を考えると対応済みフレームワークを選ぶメリットは大きいです。主要フレームワーク(LangGraph、OpenAI Agents SDK、Mastra、Vercel AI SDK、PydanticAI)は対応済みです。

Q3. OSS版とクラウド版のどちらを使うべき?

チーム規模と運用負荷で判断します。個人開発や小規模チームならOSS版で十分です。本番運用でオブザーバビリティ・モニタリング・デプロイ管理が必要な場合はクラウド版(LangSmith、CrewAI Cloud、Dify Cloud等)の導入を検討してください。

Q4. TypeScriptとPython、どちらのフレームワークを選ぶべき?

バックエンド中心・データサイエンス寄りの開発ならPython(LangGraph、CrewAI、PydanticAI)、Webアプリ・フロントエンド統合ならTypeScript(Mastra、Vercel AI SDK)が適しています。既存チームの技術スタックに合わせるのが最も合理的です。

Q5. 初心者が最初に触るならどれがよい?

エージェント開発の概念を学ぶ目的であれば、CrewAI(少ないコードでマルチエージェントを体験)かOpenAI Agents SDK(最小限の抽象化で直感的)がおすすめです。コードを書かずに試したい場合はDifyが最適です。

Q6. エンタープライズ向けに最も安全な選択肢は?

自社のクラウド環境に合わせて選ぶのが基本です。AWS環境ならAmazon Bedrock Agents、Azure/.NETならMicrosoft Agent Framework、Google CloudならGoogle ADKが最もスムーズに統合できます。クラウド非依存を重視するなら、LangGraph + LangSmithの組み合わせが実績豊富です。

まとめ

AIエージェントフレームワークの選定は、「チームの主要言語」「エージェントの複雑さ」「LLMプロバイダー戦略」「クラウド環境」の4つの軸で絞り込むのが効率的です。

2026年4月時点の全体像を改めて整理すると、以下のようになります。

- Python × 複雑なワークフロー → LangGraph

- Python × 手軽なマルチエージェント → CrewAI

- Python × 型安全・テスト重視 → PydanticAI

- TypeScript × Webアプリ統合 → Vercel AI SDK / Mastra

- ノーコード → Dify

- 特定プロバイダー最適化 → OpenAI Agents SDK / Claude Agent SDK / Google ADK

- エンタープライズ(AWS) → Amazon Bedrock Agents

- エンタープライズ(Azure) → Microsoft Agent Framework

フレームワークの乗り換えコストは高いため、プロトタイプ段階から本番運用を見据えた選定をおすすめします。各フレームワークの公式ドキュメントで最新情報を確認した上で、小さなPoCから始めてみてください。

AIエージェントの基礎知識については「AIエージェントとは?」、具体的なAIエージェント製品の比較は「AIエージェントおすすめ比較」もあわせてご覧ください。AIコーディングツールの比較は「AIコーディングツールおすすめ比較」で詳しく解説しています。

この記事の著者

AI革命

編集部

AI革命株式会社の編集部です。最新のAI技術動向から実践的な導入事例まで、企業のデジタル変革に役立つ情報をお届けしています。豊富な経験と専門知識を活かし、読者の皆様にとって価値のあるコンテンツを制作しています。