DeepSeek V4とは?性能・料金・V3との違い・セキュリティリスクを整理【2026年最新】

DeepSeek V4は、中国のAI企業DeepSeek(杭州深度求索)が開発中の次世代大規模言語モデルです。約1兆パラメータのMixture-of-Experts(MoE)アーキテクチャを採用し、100万トークンのコンテキストウィンドウに対応するとされています。

ただし、2026年4月時点でDeepSeek V4は正式リリースされていません。 現行のフラッグシップはDeepSeek V3.2であり、V4に関する情報の多くはリーク・報道に基づくものです。本記事では、公式確認済みの情報とリーク情報を明確に区別しながら、DeepSeek V4について現時点でわかっていることを整理します。

この記事でわかること:

- DeepSeek V4の基本スペックと3つの核心技術

- 現行モデルV3.2からの進化ポイント

- API料金とChatGPT・Claudeとのコスト比較

- データプライバシー・セキュリティ上のリスクと対策

- DeepSeekが向いている人・向いていない人

AIモデルのコスト効率を重視する開発者や、オープンウェイトモデルの活用を検討している方に向けた記事です。

DeepSeek V4の基本情報と開発元

DeepSeek V4は、中国・杭州に本社を置くDeepSeek社が開発する大規模言語モデルです。

項目 | 内容 |

|---|---|

開発元 | DeepSeek(杭州深度求索人工智能基础技术研究有限公司) |

創業者/CEO | 梁文峰(Liang Wenfeng) |

設立 | 2023年7月 |

本社 | 中国・浙江省杭州市 |

従業員数 | 約160名(2025年時点) |

出資元 | High-Flyer(幻方量化)— 中国の量的ヘッジファンド |

モデルサイズ | 約1兆(1T)パラメータ(MoE)、推論時アクティブ約37B |

ライセンス | Apache 2.0でのオープンウェイト公開を予定 |

現在のステータス | 未リリース(2026年4月時点) |

DeepSeek社は、量的ヘッジファンドHigh-Flyerの創業者である梁文峰が設立したAI研究企業です。約160名という比較的小規模なチームながら、2024年12月のV3リリースでGPT-4クラスの性能を低コストで実現し、業界に衝撃を与えました。2025年1月にリリースした推論特化モデル「DeepSeek R1」も大きな注目を集めています。

V4 Liteの登場

2026年3月9日に、DeepSeek公式Webサイト上で「V4 Lite」(約200Bパラメータ)が一時的に表示されました。V4アーキテクチャの検証版とみられますが、フルスペックのV4がいつ公開されるかは公式発表がありません。複数の報道機関が2026年Q1〜Q2のリリースを見込んでいますが、これまでも予想されたリリースウィンドウ(2月中旬、旧正月後、3月初旬)はいずれも通過しています。

DeepSeek V4の3つの核心技術

注意: 以下はリーク・報道情報に基づく内容です。独立した第三者による検証はまだ行われていません。

DeepSeek V4には、従来のTransformerアーキテクチャを大幅に改良する3つの技術革新が含まれるとされています。

Engram(条件付きメモリ)

Engramは、ハッシュベースのルックアップテーブルをDRAM上に配置し、静的な知識をO(1)時間(一定時間)で検索する仕組みです。

従来のLLMではすべての知識をGPU上のVRAMに保持する必要がありましたが、Engramでは頻繁にアクセスされない知識をDRAMに退避させることで、GPU負荷を大幅に軽減します。公開されたリーク情報では、100万トークン規模のNeedle-in-a-Haystack(大量テキストから特定情報を探す検索テスト)で97%の精度を達成したとされています。

mHC(多様体制約付きハイパー接続)

mHC(Manifold-Constrained Hyper-Connections)は、1兆パラメータ規模のモデルで発生しやすい学習の不安定性を解決する技術です。深い層で信号が劣化する問題を、双確率行列への射影によって解決するとされています。

これにより、超大規模モデルでもスケーリングの安定性を確保でき、パラメータ数の増加に対して性能が安定的に向上する基盤を提供します。

DeepSeek Sparse Attention(DSA)

DSAは、Attention計算のコストを約50%削減する技術です。すべてのトークン間の関係を計算する従来のFull Attentionに対し、重要な部分だけを選択的に処理することで、品質を維持しつつ推論速度を大幅に向上させます。

この技術により、100万トークンという長大なコンテキストウィンドウが実用的なコストで実現可能になるとみられています。

DeepSeek V4でできること(予想)

リーク情報や報道に基づくと、DeepSeek V4では以下のようなことが可能になると予想されています。

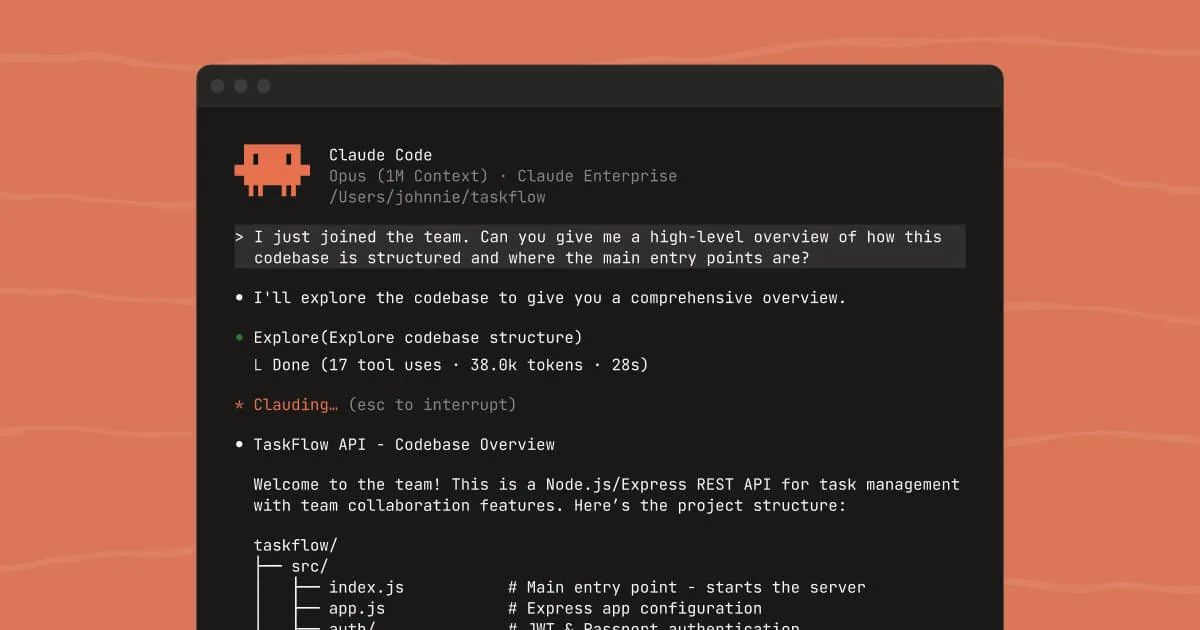

- 大規模コード解析: コードベース全体を1パスで処理し、複数ファイルにまたがるリファクタリングやバグの追跡・修正提案が可能に

- 長文ドキュメント分析: 100万トークン超の契約書・技術文書を一括で処理・要約

- マルチモーダル生成: テキスト・画像・動画をネイティブに生成(事前学習段階で統合)

- コスト効率の高い大量処理: 顧客フィードバックの分類、翻訳・要約パイプラインなどのバッチ処理

- コンシューマGPUでの実行: RTX 4090×2枚、またはRTX 5090×1枚程度で動作可能との情報

ただし、これらはいずれも独立した検証がなされていない点に注意が必要です。

V3.2(現行)とV4の違い

現行フラッグシップのDeepSeek V3.2と、V4の予想スペックを比較します。

比較項目 | DeepSeek V3.2(現行) | DeepSeek V4(予想) |

|---|---|---|

ステータス | 提供中 | 未リリース |

総パラメータ数 | 6,710億(671B) | 約1兆(1T) |

アクティブパラメータ | 約37B | 約37B |

コンテキストウィンドウ | 12.8万トークン | 100万トークン |

マルチモーダル | テキスト中心 | テキスト・画像・動画(予想) |

主要アーキテクチャ革新 | MLA + DeepSeekMoE | Engram + mHC + DSA |

API入力単価 | $0.28 / 100万トークン | $0.30 / 100万トークン(予想) |

API出力単価 | $0.42 / 100万トークン | $0.50 / 100万トークン(予想) |

ライセンス | MIT | Apache 2.0(予定) |

最大の進化ポイントは、コンテキストウィンドウが12.8万トークンから100万トークンへ約8倍に拡大される点です。これにより、大規模なコードベースや長大な文書を一度に処理できるようになります。

DeepSeek V4の料金

現行モデル(V3.2)の公式料金

DeepSeek V4は未リリースのため、まず現在利用できるV3.2の料金を整理します。

利用形態 | 料金 |

|---|---|

Web版チャット | 無料 |

API入力(キャッシュミス) | $0.28 / 100万トークン |

API入力(キャッシュヒット) | $0.028 / 100万トークン(90%割引) |

API出力 | $0.42 / 100万トークン |

新規登録ボーナス | 500万トークン無料(30日間有効) |

さらに、オフピーク時間帯(16:30〜00:30 GMT)には最大50〜75%の割引が適用されます。

他モデルとの料金比較

DeepSeekの最大の特徴は、西側フロンティアモデルと比較して圧倒的に安い料金設定です。

モデル | 入力単価(100万トークン) | 出力単価(100万トークン) | DeepSeek V3.2比 |

|---|---|---|---|

DeepSeek V3.2(現行) | $0.28 | $0.42 | — |

DeepSeek V4(予想) | $0.30 | $0.50 | 約1.1〜1.2倍 |

GPT-4o | 約$5〜10 | 約$15〜30 | 約18〜36倍 |

Claude Opus | 約$15 | 約$75 | 約54〜179倍 |

V4の予想料金はV3.2からやや値上げされますが、GPT-4oやClaude Opusと比較すると依然として1/20〜1/50程度のコストです。大量のAPIコールが発生するバッチ処理や、コスト制約の厳しいプロジェクトでは大きなアドバンテージになります。

DeepSeek V4の強み

圧倒的なコストパフォーマンス

DeepSeekの最大の強みは、フロンティアモデルに近い性能を桁違いに安い料金で提供している点です。V4でもこの方針は維持される見込みで、大量処理や個人開発者にとって非常に魅力的な選択肢です。

オープンウェイト公開

V4はApache 2.0ライセンスでのオープンウェイト公開が予定されています。これにより、自社サーバーでの運用(セルフホスト)が可能になり、データを外部に送信せずにLLMを活用できます。中国サーバーへのデータ送信リスクを回避したい企業にとって、重要なオプションです。

100万トークンの長大コンテキスト

100万トークンのコンテキストウィンドウが実現すれば、大規模コードベースの一括解析や、数百ページにわたる技術文書の処理が1回のリクエストで可能になります。

コンシューマGPUでの実行可能性

RTX 4090×2枚程度で動作可能とされており、高額なデータセンターGPUを必要としないローカル実行が現実的な選択肢になります。

DeepSeek V4の弱み・注意点

日本語の品質

現行のDeepSeek V3.2の時点で、日本語のクリエイティブ文章や敬語処理においてClaude・GPTと比較するとやや劣ります。V4でどの程度改善されるかは未知数です。日本語の品質を最優先する用途(マーケティング文章、顧客対応テンプレート等)では、Claude・GPTを優先した方が無難です。

中国規制に関わるトピックへの対応

天安門事件、台湾の政治的地位など、中国政府の規制に関わるトピックについては、回答を回避する傾向があります。教育・研究目的でこれらのトピックを扱う場合は制約になります。

長い会話での文脈維持

複数ステップの複雑な指示を出した場合、途中で方向がずれる「ドリフト」が報告されています。長い対話形式での利用よりも、明確な1回の指示での利用に向いています。

ハードウェア制約

米国の輸出規制により、DeepSeek社はNVIDIAの最高性能GPUへのアクセスが制限されています。Huawei Ascendチップでの訓練には不安定さが報告されており、V4の学習プロセスにも影響している可能性があります。

DeepSeek V4のセキュリティリスクと対策

DeepSeekを利用する際に最も注意すべきなのがセキュリティとデータプライバシーの問題です。生成AI全般のセキュリティリスクについては「生成AI セキュリティリスク対策ガイド」でも詳しく解説しています。

データの保管先と法的リスク

DeepSeekのプライバシーポリシーでは、ユーザーデータを「中国の安全なサーバに保管する」と明記されています。これは以下のリスクを意味します。

- 中国データ安全法・サイバーセキュリティ法の適用: 中国政府からのデータ開示要求に応じる法的義務がある

- 日本のデジタル庁の注意喚起: 2025年2月に「DeepSeek等の生成AIの業務利用に関する注意喚起」が公表されている

- 各国の制限措置: 12カ国以上の政府機関・軍事組織でDeepSeekの使用が制限されている

ジェイルブレイク脆弱性

CISCOの調査では、不正なプロンプトに対する「攻撃成功率100%」という報告があります。他のフロンティアモデル(GPT-4、Claude等)と比較して、セーフティガードが弱い点は認識しておく必要があります。

利用形態別のリスクレベルと対策

利用形態 | リスクレベル | 概要 |

|---|---|---|

Web版チャット | 高 | 入力データが中国サーバーに送信・保存される |

API利用 | 中 | データポリシーの確認が必要。入力データの取り扱いに注意 |

セルフホスト(オンプレミス) | 低 | データが外部に送信されない。推奨される運用方法 |

推奨対策:

- 機密情報・個人情報はWeb版に入力しない

- 業務利用する場合はAPI利用でデータポリシーを確認するか、セルフホストを検討

- V4のオープンウェイト版(Apache 2.0予定)をローカル実行すれば、データ流出リスクを大幅に軽減できる

- 社内でDeepSeekを利用する場合は、利用ガイドラインを策定する

DeepSeek V4の使い方(現時点で利用可能な方法)

V4は未リリースのため、現時点では現行のDeepSeek V3.2を利用できます。V4リリース後も基本的な利用方法は同じになると予想されます。

Web版(無料)

- chat.deepseek.com にアクセス

- アカウントを作成(メールアドレスまたはGoogle認証)

- チャット画面で質問を入力

Web版は無料で利用できますが、入力データが中国サーバーに送信される点を理解した上で利用してください。

API利用

- platform.deepseek.com でAPIキーを取得

- OpenAI互換のAPIフォーマットでリクエストを送信

- 新規登録で500万トークンの無料クレジットが付与される

DeepSeekのAPIはOpenAI互換のため、既存のOpenAI SDKやツールからエンドポイントを変更するだけで利用できます。

セルフホスト(オープンウェイト版)

V4はApache 2.0ライセンスでの公開が予定されており、リリース後はHugging Face等からモデルウェイトをダウンロードしてローカル実行が可能になる見込みです。RTX 4090×2枚程度のGPU環境で動作可能とされています(量子化レベル等の詳細条件は未確認)。

ChatGPT・Claudeとの比較

DeepSeek V4を他の主要モデルと比較します。

比較項目 | DeepSeek V4(予想) | GPT-4o | Claude Opus |

|---|---|---|---|

API入力単価 | $0.30 / 100万トークン | 約$5〜10 | 約$15 |

API出力単価 | $0.50 / 100万トークン | 約$15〜30 | 約$75 |

コンテキスト長 | 100万トークン | 12.8万トークン | 20万トークン |

日本語品質 | やや劣る | 高い | 非常に高い |

オープンウェイト | Apache 2.0(予定) | 非公開 | 非公開 |

セルフホスト | 可能(予定) | 不可 | 不可 |

データ保管先 | 中国サーバー(API/Web版) | 米国 | 米国 |

セーフティガード | 弱い | 強い | 強い |

コスト重視で大量処理をするなら → DeepSeek

日本語品質やセーフティを重視するなら → Claude / GPT

データを外部に出したくないが低コストで使いたいなら → DeepSeekのセルフホスト版

生成AIツール全体の比較は「生成AIツールおすすめ比較」で詳しく解説しています。

こんな方におすすめ

DeepSeek V4が向いているケース

- API利用コストを最小限に抑えたい開発者・スタートアップ: 西側モデルの1/20〜1/50の料金で同等クラスの性能を活用できる

- 大量のバッチ処理が必要な業務: 翻訳、要約、分類などの大量処理でコスト差が大きく出る

- オープンウェイトモデルをセルフホストで運用したい企業: データを外部に送信せずにLLMを活用できる

- 長大なコードベースや文書を一括処理したいエンジニア: 100万トークンのコンテキスト長が活きる

- ローカルGPU環境でLLMを試したい個人開発者: RTX 4090×2枚程度で動作可能

おすすめしないケース

- 機密データをWeb版で扱いたい場合: 中国サーバーへのデータ送信リスクがある

- 日本語のクリエイティブ文章の品質を最優先する場合: Claude・GPTの方が日本語は自然

- 中国の検閲対象トピックを扱う研究・教育: 回答回避が発生する可能性がある

- 企業のコンプライアンス要件が厳しい場合: デジタル庁の注意喚起を踏まえた社内検討が必要

- セーフティガードの強さを重視するサービス開発: ジェイルブレイク耐性が他モデルより低い

よくある質問(FAQ)

Q1. DeepSeek V4はいつリリースされますか?

2026年4月時点で正式リリース日は未発表です。複数の報道機関が2026年Q1〜Q2のリリースを見込んでいましたが、これまで予想されたリリース時期はいずれも通過しています。2026年3月にV4 Lite(約200Bパラメータの検証版)が一時公開されたことから、フルV4のリリースも近い可能性がありますが、確定情報ではありません。

Q2. DeepSeek V4は無料で使えますか?

現行のDeepSeek V3.2はWeb版チャットが無料で利用できます。V4も同様にWeb版は無料、APIは従量課金の形式が予想されます。API利用については新規登録で500万トークンの無料クレジットが付与される制度があります。

Q3. DeepSeekを業務で使っても大丈夫ですか?

Web版やAPI版は入力データが中国サーバーに送信されるため、機密情報の取り扱いには注意が必要です。デジタル庁も業務利用に関する注意喚起を出しています。業務利用する場合は、オープンウェイト版をセルフホストで運用するか、機密情報を含まない範囲で利用することを推奨します。

Q4. DeepSeekとChatGPTの最大の違いは何ですか?

最大の違いはコストとデータの取り扱いです。DeepSeekはChatGPT(GPT-4o)の約1/20〜1/50のAPI料金で利用でき、オープンウェイトでセルフホストも可能です。一方、データが中国サーバーに保管される点と、日本語品質・セーフティガードではChatGPTが優位です。

Q5. V4 LiteとフルV4の違いは何ですか?

V4 Liteは約200Bパラメータの小規模版で、V4アーキテクチャの検証を目的とした限定公開モデルとみられます。フルV4は約1兆(1T)パラメータで、100万トークンのコンテキストウィンドウやマルチモーダル対応など、すべての新技術が搭載される見込みです。

Q6. 日本語で使えますか?

現行のDeepSeek V3.2でも日本語での質問・回答は可能です。ただし、Claude・GPTと比較すると日本語の自然さ・敬語処理にやや劣る傾向があります。技術的な質問やコーディング支援では十分実用的ですが、日本語のクリエイティブ文章生成にはClaude・GPTの方が向いています。

まとめ

DeepSeek V4は、圧倒的なコストパフォーマンスと100万トークンの長大コンテキスト、オープンウェイト公開を特徴とする次世代AIモデルです。正式リリースは2026年4月時点でまだ行われていませんが、V4 Liteの限定公開やリーク情報から、フルV4の登場も近いとみられています。

DeepSeek V4を検討する際の判断ポイント:

- コスト重視・大量処理 → DeepSeekを第一候補に

- 日本語品質・セーフティ重視 → Claude・GPTを優先

- データを外部に出したくない → セルフホスト版を待つ

- 業務で使いたい → セキュリティポリシーを確認の上、利用形態を選定

リリース後は性能や料金が変更される可能性があるため、公式サイト(deepseek.com)で最新情報を確認してください。

DeepSeekを含むAIモデルの比較は「生成AIツールおすすめ比較」、AIエージェント全般については「AIエージェントとは」もあわせてご覧ください。

この記事の著者

AI革命

編集部

AI革命株式会社の編集部です。最新のAI技術動向から実践的な導入事例まで、企業のデジタル変革に役立つ情報をお届けしています。豊富な経験と専門知識を活かし、読者の皆様にとって価値のあるコンテンツを制作しています。