AIコーディングのセキュリティリスクとは?脆弱性・情報漏洩・最新事例と対策を徹底解説

AIコーディングツールは開発効率を大幅に高める一方、AI生成コードの40〜62%に何らかのセキュリティ上の欠陥が含まれるという調査結果が複数報告されています。IPAの「情報セキュリティ10大脅威 2026」でも「AIの利用をめぐるサイバーリスク」が初選出で3位にランクインしており、AIコーディングのセキュリティ対策は開発者・企業にとって避けて通れないテーマです。

この記事では、GitHub Copilot・Claude Code・Cursor・Devinなど主要AIコーディングツールのセキュリティリスクを6つのカテゴリに体系化し、2026年の最新インシデント事例、ツール別・モデル別の脆弱性データ、そして今日からできる具体的な対策まで整理します。

この記事でわかること:

- AIコーディングツールで起こりうる6種類のセキュリティリスク

- AI生成コードの脆弱性率に関する最新の調査データ

- 2025〜2026年に実際に起きたインシデント事例

- ツール別・モデル別のセキュリティ比較

- 個人利用と企業利用でのリスクの違い

- 今日から実践できるセキュリティ対策チェックリスト

想定読者: AIコーディングツールを業務で使っている、またはこれから導入を検討しているエンジニア・開発チームリーダー・情報システム部門の方。

AIコーディングのセキュリティリスクが注目される背景

AIコーディングツールの普及速度に対して、セキュリティ対策の整備が追いついていないことが、リスク顕在化の最大の要因です。

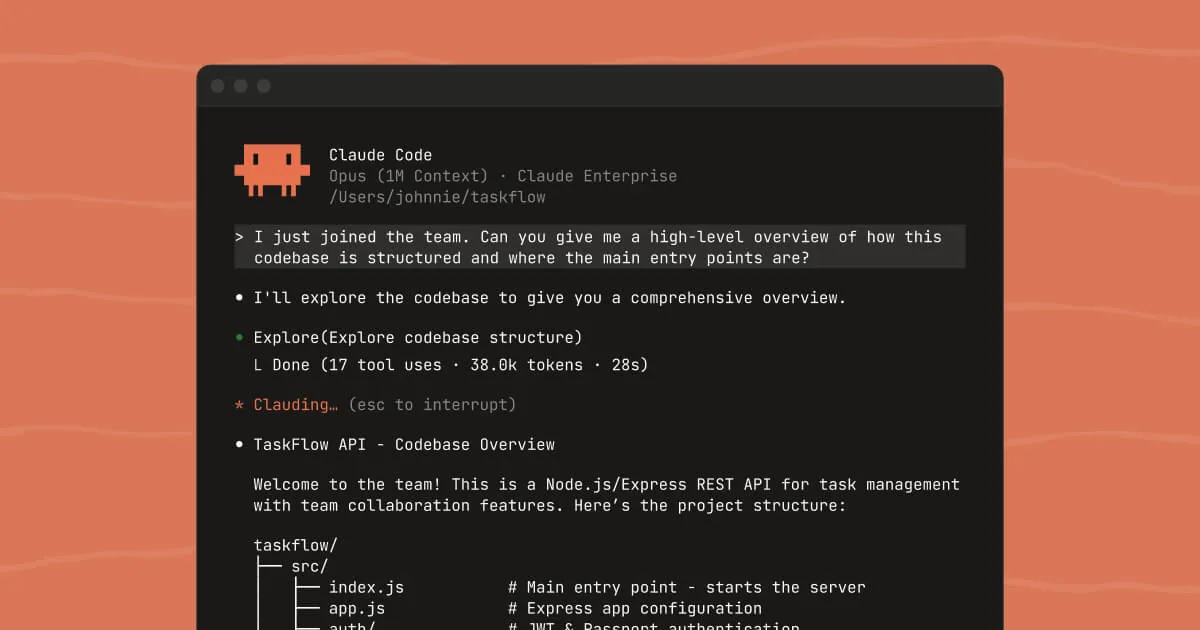

CodeSignalの調査によると、開発者の81%がAIを開発に活用しており、エンタープライズ開発者の約97%がAIコーディングツールを使用しています。GitHub Copilot、Claude Code、Cursor、Devinといったツールは、もはや「試しに使う」段階を超え、日常的な開発ワークフローに組み込まれています。

こうした状況の中、2026年1月にIPAが発表した「情報セキュリティ10大脅威 2026」では、「AIの利用をめぐるサイバーリスク」が初選出で組織向け脅威の3位に入りました。IPAはリスクを3つの側面で整理しています。

側面 | 内容 | AIコーディングとの関連 |

|---|---|---|

AIを利用する際のリスク | 意図しない情報漏洩、生成結果の検証不足 | プロンプトへの機密コード入力、生成コードの脆弱性 |

AIそのものへの攻撃 | 敵対的攻撃、データポイズニング | ルールファイル経由の攻撃、学習データの汚染 |

AIを悪用した攻撃の高度化 | フィッシング自動化、マルウェア生成 | AIを使ったマルウェアコーディングの事例 |

さらに、OWASPも2025〜2026年にかけて関連ガイドラインを相次いで公開しています。

- OWASP Top 10 for LLM Applications(2025年版): プロンプトインジェクション、機密情報漏洩、サプライチェーン脆弱性など

- OWASP Top 10 for Agentic Applications(2026年): AIエージェント型ツール向けのリスクフレームワーク

- OWASP GenAI Data Security Risks & Mitigations(2026年3月公開): GenAIのデータ層に焦点を当てたセキュリティフレームワーク

AIコーディングのリスクは「理論上の話」ではなく、すでに公的機関が対策を求めるレベルの現実的な脅威になっています。

AIコーディングの主なセキュリティリスク6つ

AIコーディングツールのセキュリティリスクは、大きく6つのカテゴリに分けられます。「なんとなく危険」ではなく、どのカテゴリに該当するリスクなのかを把握することが、的確な対策の第一歩です。

1. 脆弱なコードの生成

AIコーディングツールが最も頻繁に引き起こすリスクです。SQLインジェクション、XSS(クロスサイトスクリプティング)、認証バイパス、バッファオーバーフローなど、古典的な脆弱性を含むコードを生成することがあります。

具体的な問題点は以下の通りです。

- プロンプトにセキュリティ指示がなければ、対策を省略する傾向がある — 「ログイン機能を作って」と指示すると、入力バリデーションやCSRF対策が抜けがちになる

- 学習データに含まれる脆弱なコードパターンを再現する — Stack Overflowの回答や古いチュートリアルに含まれていた不適切なパターンがそのまま出力される

- アプリ固有の仕様や既存のセキュリティポリシーを考慮できない — 社内で定めたコーディング規約やセキュリティ要件をAIは知らない

GMO Flatt Securityの分析では、AIが生成した脆弱コードのパターンとして「セキュリティ無視の実装(XSS等)」「既存の潜在脆弱性が新機能追加で顕在化」「アプリ固有知識の欠落による仕様漏れ」の3つを指摘しています。

2. 機密情報の漏洩

AIコーディングツールにソースコードやAPI鍵、顧客データを含むプロンプトを送信することで、意図せず機密情報が外部に流出するリスクがあります。

- プロンプト経由の情報流出: 社内のソースコードや設定ファイルをそのままコピーしてAIに送信するケース

- 生成コード内のハードコード: AIが生成したコードに、APIキーやデータベース接続文字列がハードコードされるケース

- モデルの学習データ再利用リスク: ツールによって、入力データがモデル改善に使われるかどうかのポリシーが異なる

2023年に韓国Samsung社で発生した機密ソースコード流出事例は、社員がAIツールに社内コードをそのまま入力したことが原因でした。この事例は、ツール側のセキュリティだけでなく、利用者側のリテラシーがリスクの大きさを左右することを示しています。

3. サプライチェーン攻撃(パッケージハルシネーション)

AIが存在しないパッケージ名を推奨する「パッケージハルシネーション」は、サプライチェーン攻撃の新たな入口になっています。

仕組みはこうです。AIが実在しないライブラリ名を出力する(例: flask-security-utils)→ 攻撃者がその名前で悪意あるパッケージをnpmやPyPIに登録する → 別の開発者がAIの推奨に従ってインストールする → マルウェアが混入する。

この手法は「スロップスクワッティング」とも呼ばれ、調査によるとAIが33〜48%の確率で存在しないライブラリを推奨するケースが報告されています。

4. 設定ファイル経由の攻撃(Rules File Backdoor)

2025年にPillar Security社が発見した比較的新しい攻撃手法です。GitHub CopilotやCursorが参照する設定ファイル(ルールファイル)に、ユニコード難読化で隠蔽された悪意ある指令を埋め込むことで、AIのコード生成を操作します。

攻撃の流れは以下の通りです。

- 攻撃者が悪意ある指令を含むルールファイルを作成(人間には見えないユニコード文字で隠蔽)

- 開発者フォーラムやスターターキットテンプレートとして公開・拡散

- 開発者がそのテンプレートをプロジェクトに取り込む

- AIが隠蔽された指令に従い、バックドアやデータ流出コードを正常なコードに紛れ込ませて生成する

見た目は完全に正常なルールファイルであるため、通常のコードレビューでは発見が極めて困難です。

5. AIエージェントの過剰権限

Claude CodeやDevinのようなAIエージェント型ツールは、ファイルの読み書き、コマンドの実行、外部APIへのアクセスなど広範な権限を持ちます。この権限が適切に制限されていない場合、以下のようなリスクが発生します。

- 本番環境のデータベースを誤って削除する

- 意図しない設定変更によりサービスが外部に公開される

- 間接的プロンプトインジェクションにより、外部からAIエージェントが操作される

OWASPは2026年版の「Top 10 for Agentic Applications」で、「最小エージェンシー(Least Agency)」の原則を提唱しています。エージェントには、タスク遂行に必要な最小限の権限のみを付与すべきという考え方です。

6. プロンプトインジェクション攻撃

OWASP LLM Top 10で1位に位置づけられているリスクです。本番環境で稼働するAIの73%にプロンプトインジェクションの脆弱性が存在すると報告されています。

AIコーディングの文脈では、GitHub IssuesやプルリクエストのコメントにAIへの悪意ある指令を紛れ込ませ、Copilotにリポジトリの乗っ取り指示を注入するといった攻撃手法が2026年に報告されています。

リスクカテゴリ | 影響度 | 発生頻度 | 主な対策 |

|---|---|---|---|

脆弱なコード生成 | 高 | 非常に高い | コードレビュー、SAST |

機密情報の漏洩 | 非常に高 | 高い | 入力制限、プライバシーモード |

サプライチェーン攻撃 | 高 | 中程度 | パッケージ検証、SCA |

設定ファイル攻撃 | 高 | 低い(増加傾向) | ルールファイルの検証 |

エージェント過剰権限 | 非常に高 | 中程度 | 最小権限設定 |

プロンプトインジェクション | 非常に高 | 高い | 入力サニタイズ、権限分離 |

AI生成コードの脆弱性に関する最新データ

「AIが書いたコードはどれくらい危険なのか」を判断するには、感覚ではなくデータが必要です。複数の調査機関が発表している数値を整理します。

主要な調査データ一覧

調査元 | 対象 | 主要データ |

|---|---|---|

Veracode(2025年) | AI生成コード全般 | 45%にセキュリティ欠陥 |

AppSec Santa | 534サンプル | 25.1%にOWASP Top 10脆弱性 |

NYU研究 | GitHub Copilot | 約40%の確率で問題のあるコード生成 |

CodeRabbit | AI生成 vs 人間 | AI生成は人間の2.74倍の脆弱性率、1.7倍の重大問題 |

ACM論文 | Copilot生成コード | Pythonの29.5%、JavaScriptの24.2%にセキュリティ弱点 |

Aikido Security | 企業調査 | AI生成コードが企業セキュリティ侵害の5件に1件の原因 |

Black Duck OSSRA | コードベース全体 | 脆弱性数が前年比107%増 |

調査主体や方法論、対象言語によって数値にばらつきがありますが、少なくとも生成コードの4分の1以上に何らかのセキュリティ上の問題があるという傾向は共通しています。

脆弱性タイプ別の分布

AppSec Santaの調査では、AI生成コードに含まれる脆弱性の内訳は以下のようになっています。

脆弱性タイプ | 割合・件数 | 深刻度 |

|---|---|---|

SSRF(サーバーサイドリクエストフォージェリ) | 最多の32件 | 高 |

インジェクション系(SQL/コマンド/コード) | 全体の33.1% | 非常に高 |

ハードコードされた認証情報・APIキー | 多数 | 高 |

XSS(クロスサイトスクリプティング) | CWE-80で86%の失敗率 | 中〜高 |

特にXSS対策については、テストしたAIモデルの86%が適切な対策コードを生成できなかった(CWE-80基準)という結果が出ています。AIは機能的に動くコードは生成できても、セキュリティ面での考慮が体系的に不足しています。

SAST(静的解析)ツール単体では検出しきれない

もう一つ重要なデータがあります。AppSec Santaの調査で、確認されたAI生成コードの脆弱性の78.3%は、5つのSASTツールのうち1つしか検出できなかったことがわかっています。単一のSASTツールでの検出率は22%未満です。

つまり、「SASTツールを1つ入れているから安心」という判断は危険であり、複数のセキュリティツールを組み合わせる多層防御が不可欠です。

2025〜2026年に起きた主なインシデント事例

セキュリティリスクが「理論上の懸念」ではないことを示す、実際のインシデント事例を時系列で整理します。

時期 | インシデント | 概要・影響 |

|---|---|---|

2025年7〜8月 | AI駆動型マルウェア「LAMEHUG」「PromptLock」 | APTグループがバイブコーディングを悪用してマルウェアを生成した事例 |

2025年 | GitHub MCP Server脆弱性 | プライベートリポジトリの情報が外部から読み出し可能に |

2025年 | Salesforce Einstein脆弱性 | 質問を送るだけで顧客データを上書きできる状態だった |

2026年2月 | RoguePilot(GitHub Codespaces) | GitHub CopilotがGITHUB_TOKENを外部に漏洩する脆弱性 |

2026年3月 | Claude Codeソースコード流出 | Bunランタイムのソースマップ設定不備で約51万2,000行が流出 |

2026年3月 | Amazon 6時間障害 | AI生成コードに起因し、630万件の注文に影響 |

2026年3月 | CVE月間35件(Georgia Tech調べ) | AI生成コード起因のCVEが月間最多を更新(1月の6件から5.8倍に増加) |

注目すべきポイント

Amazon障害(2026年3月) は、AI生成コードが大規模な本番障害を引き起こした代表的な事例です。AI生成コードが原因の一つとされ、6時間にわたるサービス停止で630万件の注文に影響しました。AIコーディングの品質問題が、直接的なビジネス損失につながることを示しています。

RoguePilot脆弱性(2026年2月) は、GitHub Codespaces環境でCopilotがGITHUB_TOKENを外部に漏洩するという深刻なセキュリティ問題でした。開発環境そのものがAIによって攻撃対象になりうることを示した事例です。

CVEの急増(Georgia Tech調べ) も見過ごせません。2026年1月のAI生成コード起因のCVEは6件でしたが、3月には35件と5.8倍に急増しています。累計74件のうち、ツール別ではClaude Codeが27件、GitHub Copilotが4件、Devinが2件となっています。ただし、この数値はツールの利用者数や用途の違いも影響するため、単純な「危険度ランキング」としては解釈できない点に注意が必要です。

ツール別・モデル別のセキュリティ比較

AIコーディングツールやモデルによって、セキュリティリスクの度合いは異なります。ツール選定の参考として、現時点で公開されているデータを整理します。

主要ツールのセキュリティ機能比較

ツール | セキュリティ関連機能 | プライバシー設定 | 権限制御 |

|---|---|---|---|

GitHub Copilot | コードフィルタリング、脆弱性パターン検出、公開コード一致検出 | Business/Enterpriseでデータ保護 | IDE拡張の範囲内 |

Claude Code | .claudecodeignoreでファイル除外、権限制御(Allow/Deny)、脆弱性スキャン | 設定によりデータの学習利用を制限可能 | コマンド実行の許可/拒否設定 |

Cursor | ルールファイル設定、プライバシーモード | プライバシーモードでコード送信を制限 | IDE内の操作範囲 |

Devin | サンドボックス実行環境 | サンドボックスで外部影響を限定 | タスク単位の制限 |

各ツールの詳しい特徴については、「Claude Codeとは?できること・料金・使い方を解説」もあわせてご確認ください。

モデル別の脆弱性率(AppSec Santa調べ)

AppSec Santaの534サンプルを用いた調査では、モデルごとにセキュリティ性能に差があることがわかっています。

モデル | OWASP Top 10脆弱性率 | 評価 |

|---|---|---|

GPT-5.2 | 19.1% | 最良 |

その他中間モデル群 | 20〜28% | 中間 |

DeepSeek V3 | 29.2% | 最悪(同率) |

Claude Opus 4.6 | 29.2% | 最悪(同率) |

Llama 4 Maverick | 29.2% | 最悪(同率) |

ただし、この結果はテスト条件やプロンプトの違いにより変動しうるため、あくまで参考値として捉えてください。重要なのは、どのモデルを使っても20〜30%程度の脆弱性率があり、AIの出力を無検証で使うことは危険という点です。

ツール別CVE数(Georgia Tech Vibe Security Radar、2026年3月時点)

ツール | CVE累計件数 |

|---|---|

Claude Code | 27件 |

GitHub Copilot | 4件 |

Devin | 2件 |

Aether | 1件 |

Cursor | 1件 |

Claude Codeが突出して多く見えますが、これはClaude Codeがエージェント型でファイル操作やコマンド実行など広範な操作を行うため、脆弱性が顕在化しやすいという側面もあります。利用者数や利用用途の違いを考慮する必要があります。

バイブコーディング(Vibe Coding)の落とし穴

バイブコーディング(Vibe Coding)とは、AIに自然言語で指示してコードを生成し、コードの中身を詳しく確認せずにそのまま本番環境にデプロイする開発スタイルのことです。2025年後半から2026年にかけて急速に広がっており、セキュリティリスクの増幅要因として注目されています。

従来の開発とバイブコーディングの違いを整理すると、問題の本質が見えてきます。

項目 | 従来の開発 | バイブコーディング |

|---|---|---|

コードレビュー | 人間が実施(必須) | 省略されがち |

セキュリティテスト | CI/CDパイプラインに組み込み | 省略されがち |

コードの理解度 | 開発者が内容を把握 | 動けばOKの傾向 |

依存パッケージの確認 | 既知の信頼できるパッケージを使用 | AIの推奨をそのまま採用 |

デプロイまでの速度 | 数時間〜数日 | 数分〜数十分 |

バイブコーディングアプリの実態調査

Aikido Securityなどの調査では、5,600個のバイブコーディングアプリに対する分析で以下の結果が報告されています。

- 2,000件以上の脆弱性を発見

- 400件以上のシークレット情報(APIキー等)が露出

- 175件のPII(個人識別情報)が露出

- Lovable生成アプリの10.3%にSupabase RLS(行レベルセキュリティ)の重大な欠陥

バイブコーディング自体が悪いのではなく、人間によるレビューレイヤーが意図的に除去されることが問題です。AIが生成したコードを「速い」という理由だけで無検証のまま本番環境に出すことは、セキュリティの観点では極めてリスクが高い行為です。

個人利用と企業利用でリスクはどう変わるか

AIコーディングのセキュリティリスクは、個人で趣味のプロジェクトに使う場合と、企業の業務システム開発で使う場合とでは、深刻度が大きく異なります。

観点 | 個人利用 | 企業利用 |

|---|---|---|

情報漏洩の影響 | 個人の学習コードが漏洩(影響は限定的) | 顧客データ・営業秘密・ソースコードの流出(法的責任あり) |

脆弱性の影響 | 個人サイトやポートフォリオ | 業務システム・顧客向けサービス(実害・信用失墜) |

コンプライアンス | 個人の判断 | 社内セキュリティポリシー・業界規制への準拠が必要 |

ライセンスリスク | 個人の責任範囲 | AI生成コードの著作権・ライセンス問題が企業リスクに |

対策コスト | 無料ツールで対応可能 | SAST/DAST/SCAなどの有料ツール導入が必要 |

個人利用の場合

個人の学習やポートフォリオ開発であれば、AIコーディングツールのリスクは比較的低いです。ただし、以下の点は意識すべきです。

- 公開するアプリには最低限のセキュリティ対策を施す(特にAPIキーのハードコード防止)

- 個人情報を扱うアプリの場合は企業利用に準じた対策が必要

- OSS貢献時はAI生成コードのライセンス問題に注意

企業利用の場合

企業でAIコーディングツールを導入する場合は、組織的なセキュリティ体制が不可欠です。

- AIコーディングツールの利用ガイドラインを策定する

- 機密情報をプロンプトに入力しないルールを徹底する

- CI/CDパイプラインにSAST・DAST・SCAを組み込む

- AIエージェント型ツールには最小権限の原則を適用する

- 定期的なセキュリティ研修を実施する

IPA・経済産業省・総務省が共同で策定した「AI事業者ガイドライン」や、日本ディープラーニング協会の生成AI利用指針も参考にしてください。

今日からできるセキュリティ対策

AIコーディングツールのセキュリティリスクに対しては、完全な排除は困難でも、多層的な対策で大幅にリスクを低減できます。対策を「今日からできること」「中期的に取り組むこと」「長期的に整備すること」の3段階で整理します。

今日からできること(即日対応)

1. プロンプトにセキュリティ指示を含める

GMO Flatt Securityの知見によると、プロンプトに「脆弱性を発生させないよう注意してください」と一文追加するだけでも、生成コードのセキュリティ品質が向上します。以下のような指示を習慣化しましょう。

- 「入力バリデーションを必ず含めてください」

- 「SQLインジェクション対策を施してください」

- 「APIキーはハードコードせず環境変数から読み込んでください」

- 「OWASP Top 10の脆弱性に対する防御を考慮してください」

2. AI生成コードを必ず人間がレビューする

AIが生成したコードをそのまま本番に出さないことが最も基本的な対策です。特に以下の点を確認します。

- 入力バリデーションの有無

- 認証・認可の適切な実装

- APIキーやパスワードのハードコード

- 外部からの入力をそのまま使っていないか(SQLインジェクション、XSS)

3. 機密情報をプロンプトに入力しない

社内のソースコード全体、APIキー、データベースの認証情報、顧客データをそのままAIに送信しないようにしましょう。必要な場合はダミーデータに置き換えてから送信します。

4. AIエージェントの権限を最小化する

Claude Codeなどのエージェント型ツールを使う場合、.claudecodeignoreでアクセスさせないファイルを指定し、コマンド実行の許可/拒否を適切に設定します。本番環境への直接アクセスは禁止が原則です。

中期的に取り組むこと(1〜3か月)

5. 複数のセキュリティツールを導入する

単一のSASTツールでは脆弱性の22%未満しか検出できないため、複数ツールの組み合わせが必須です。

ツール種別 | 役割 | 代表的なツール |

|---|---|---|

SAST(静的解析) | コード内の脆弱性パターンを検出 | SonarQube、Semgrep、CodeQL |

DAST(動的解析) | 実行中のアプリの脆弱性を検出 | Burp Suite、OWASP ZAP |

SCA(ソフトウェア構成分析) | 依存パッケージの脆弱性を検出 | Snyk、Trivy、OWASP Dependency-Check |

シークレット検出 | ハードコードされた認証情報を検出 | GitLeaks、TruffleHog |

6. CI/CDパイプラインにセキュリティチェックを組み込む

プルリクエスト時やデプロイ前に自動でセキュリティスキャンが実行される仕組みを整えます。手動レビューに頼りすぎると、見落としが増えます。

7. AIコーディングツールの利用ガイドラインを策定する

情報システム部門・法務・開発チームの横断チームで、以下の項目を定めたガイドラインを策定します。

- 利用を許可するツール・モデルの一覧

- 機密情報の入力禁止ルール

- コードレビューの必須化

- インシデント発生時の報告フロー

長期的に整備すること(3か月以上)

8. セキュリティ研修の定期実施

AIコーディングツールのリスクを理解した上で安全に使うための研修を、年次または半年ごとに実施します。Tenableのガイドでも、ガバナンスフレームワークとして年次セキュリティ研修を推奨しています。

9. AI生成コードの監視体制の構築

CoWorker AIDRのように、AIエージェントのツール呼び出しをリアルタイムで監視し、汚染パッケージの取り込みや不正コード注入を自動検知・ブロックするツールも登場しています。

10. セキュリティテストの自動化と継続的実施

Checkmarxが提唱する「継続的保証(Continuous Assurance)」モデルのように、開発ライフサイクル全体にセキュリティテストを統合し、事後レビュー型から予防型へ移行することが理想です。

AIコーディングツール導入時のセキュリティチェックリスト

企業でAIコーディングツールを導入する際の判断材料として、以下のチェックリストを活用してください。

ツール選定時のチェック項目

- [ ] データの取り扱いポリシー(入力データがモデル改善に使われるか)

- [ ] 権限制御の細かさ(ファイルアクセス制限、コマンド実行制限)

- [ ] プライバシーモード・オプトアウトの有無

- [ ] SOC 2やISO 27001などのセキュリティ認証取得状況

- [ ] オンプレミス/VPC内でのデプロイオプションの有無

- [ ] 監査ログの取得・出力機能

運用時のチェック項目

- [ ] AI生成コードのレビュー体制が整っているか

- [ ] SAST/DAST/SCAが複数導入されているか

- [ ] 機密情報の入力を防ぐルールが周知されているか

- [ ] AIエージェントの権限が最小化されているか

- [ ] インシデント発生時の対応フローが決まっているか

- [ ] 定期的なセキュリティ研修が計画されているか

こんな方にはAIコーディングの利用に注意が必要

AIコーディングツールは強力ですが、以下に該当する場合は慎重な検討が必要です。

利用に特に注意すべきケース:

- セキュリティの基礎知識がない状態で本番コードを書く場合 — AI生成コードの脆弱性を見抜けないまま本番環境に出すリスクが高い

- コードレビュー体制がないチームで使う場合 — 脆弱なコードがそのまま本番に入る確率が大幅に上がる

- 医療・金融・インフラなど高セキュリティ要件の開発 — AI生成コードの脆弱性率を考慮すると、追加の検証コストが大きくなる

- 機密性の高いソースコードを扱うプロジェクト — 外部AIサービスへのコード送信がポリシー違反になる可能性がある

安心して活用できるケース:

- セキュリティの基礎知識を持つエンジニアが、AI生成コードをレビューした上で使う場合

- CI/CDにセキュリティスキャンが組み込まれている環境で使う場合

- 学習・プロトタイピングなど、本番環境に直接影響しない用途で使う場合

- 企業のセキュリティガイドラインに沿って、許可されたツール・設定で使う場合

AIコーディングツール全般については「生成AIツールおすすめ比較」で各ツールの特徴を整理しています。また、AIエージェント型ツールの仕組みを知りたい方は「AIエージェントとは?」もあわせてご覧ください。

よくある質問(FAQ)

Q1. AI生成コードは人間が書いたコードより危険ですか?

一概に「AIの方が危険」とは言い切れませんが、CodeRabbitの分析ではAI生成コードは人間が書いたコードの2.74倍の脆弱性率という結果が出ています。人間もセキュリティミスは犯しますが、AIはプロンプトで明示しない限りセキュリティ対策を省略する傾向があり、系統的な脆弱性が生まれやすい点が特徴です。

Q2. どのAIコーディングツールが一番安全ですか?

現時点で「絶対に安全なツール」は存在しません。各ツールにはセキュリティ機能の違い(権限制御、プライバシーモード、コードフィルタリングなど)がありますが、ツールの安全性よりも使い方と運用体制の方がリスクへの影響は大きいです。どのツールを選んでも、コードレビューとセキュリティスキャンの併用が前提です。

Q3. バイブコーディングは禁止すべきですか?

一律に禁止するのは非現実的です。ただし、本番環境に出すコードについては人間のレビューを必須とするルールを設けるべきです。プロトタイピングや学習目的のバイブコーディングまで禁止する必要はありませんが、その成果物をそのまま本番に出すワークフローは避けましょう。

Q4. SASTツールを入れていれば安全ですか?

1つのSASTツールだけでは不十分です。調査データによると、AI生成コードの脆弱性の78.3%は単一のSASTツールでは検出できません。SAST・DAST・SCA・シークレット検出の複数ツールを組み合わせる多層防御が必要です。

Q5. 社内のソースコードをAIに送信してはいけませんか?

ツールごとのデータポリシーを確認した上で判断してください。GitHub Copilot BusinessやCopilot Enterpriseではデータが学習に使われないことが保証されていますが、無料版や個人プランではポリシーが異なる場合があります。機密性の高いコードを扱う場合は、プライバシーモードの利用やオンプレミスデプロイの検討をおすすめします。

Q6. 日本語で指示してもセキュリティ品質に影響しますか?

プロンプトの言語よりも、セキュリティ要件を明示しているかどうかの方が影響は大きいです。日本語でも英語でも、「入力バリデーションを含めてください」「OWASP Top 10に対応してください」のような具体的な指示を加えることで、生成コードのセキュリティ品質は向上します。

まとめ

AIコーディングツールのセキュリティリスクは、「使わない」ことで回避するのではなく、リスクを正しく理解した上で適切に管理することが現実的な対応です。

押さえるべきポイント:

- AI生成コードの25〜45%に何らかのセキュリティ上の問題がある(複数調査の中央値)

- リスクは6カテゴリ(脆弱コード生成、情報漏洩、サプライチェーン攻撃、設定ファイル攻撃、エージェント過剰権限、プロンプトインジェクション)に体系化できる

- 2026年に入りCVEの急増やAmazon障害など、リスクが現実のインシデントとして顕在化している

- 単一のツールでは検出しきれないため、複数のセキュリティツールの組み合わせが不可欠

- 最も効果的な対策は「AIの出力を人間がレビューする」というシンプルなプロセス

AIコーディング全般のツール選びについては「生成AIツールおすすめ比較」を、AIエージェントのリスク管理については「AIエージェントとは?仕組み・種類・活用事例を解説」をあわせてご覧ください。

この記事の著者

AI革命

編集部

AI革命株式会社の編集部です。最新のAI技術動向から実践的な導入事例まで、企業のデジタル変革に役立つ情報をお届けしています。豊富な経験と専門知識を活かし、読者の皆様にとって価値のあるコンテンツを制作しています。